Durante el último año, muchos equipos han descubierto la parte menos glamourosa de desplegar agentes: no fallan “bonito”. Fallan en cadena, con tool calls erróneas, decisiones inconsistentes y prompt spaghetti que crece a base de parches. En ese contexto, Microsoft ha publicado Agent Lightning, un framework open source que propone cambiar el ciclo de trabajo: en vez de retocar prompts a mano cada vez que algo sale mal, instrumentas el agente, capturas trazas (prompts, llamadas a herramientas, resultados y recompensas) y dejas que el sistema optimice automáticamente el comportamiento del siguiente “run”, incluyendo técnicas de Automatic Prompt Optimization y Reinforcement Learning (RL).

La idea es ambiciosa: tratar a los agentes como software que se puede entrenar de forma continua, no solo “promptar”.

Qué es exactamente Agent Lightning (y por qué importa)

En términos prácticos, Agent Lightning se presenta como “the absolute trainer to light up AI agents”: una capa que puedes acoplar a tu agente actual (incluso si está hecho con frameworks distintos) para convertir ejecuciones en datos de entrenamiento, y datos de entrenamiento en mejoras desplegables (prompts refinados, políticas/weights, recursos actualizados).

Lo relevante aquí no es solo “usar RL”, sino industrializar un bucle que muchos ya hacen a mano:

- Ejecutas tarea (el agente actúa).

- Recolectas señales (qué intentó, qué herramientas llamó, qué devolvieron, en qué se equivocó).

- Evalúas (¿éxito o fallo?, ¿por qué?, ¿qué habría sido mejor?).

- Ajustas (prompt, reglas, herramientas, memoria, etc.).

- Repites.

Agent Lightning intenta automatizar los pasos 2–4.

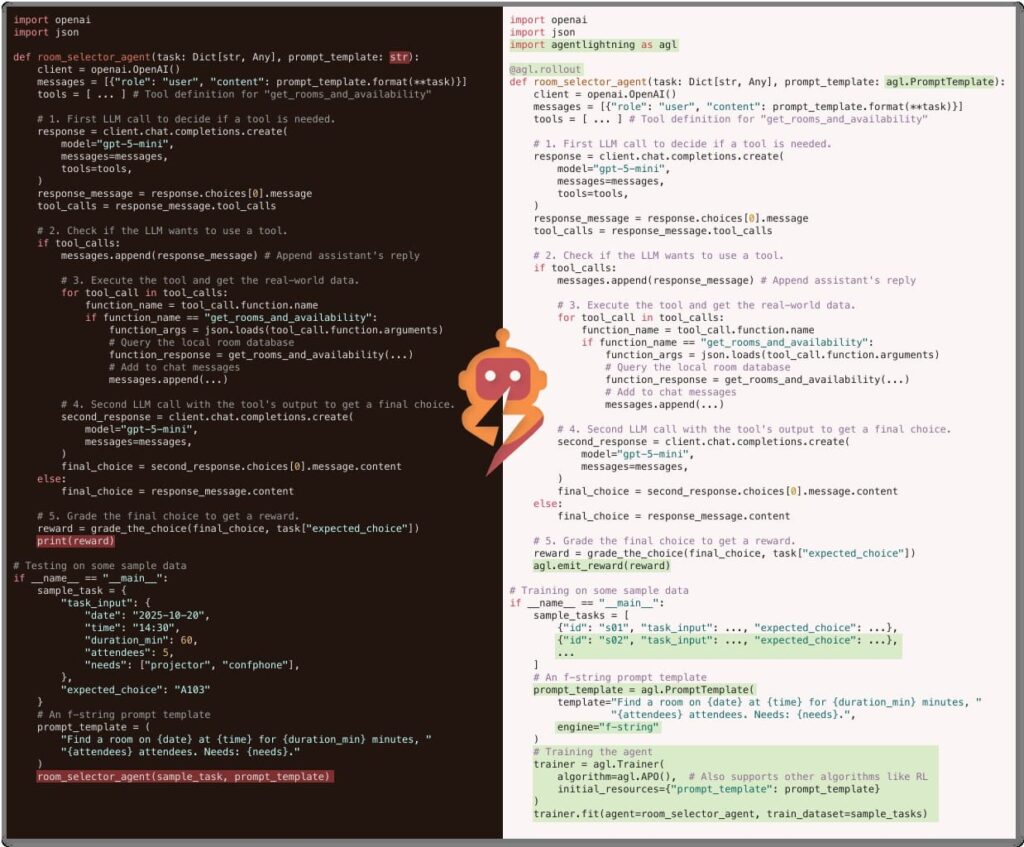

“Cero cambios de código”… casi: cómo se integra

El repositorio insiste en que puede “encender” la optimización con casi cero cambios: puedes añadir helpers agl.emit_xxx() o dejar que un tracer recoja la telemetría del agente (prompts, tool calls, recompensas). Esa telemetría se convierte en spans estructurados y aterriza en un LightningStore (el hub donde se sincronizan tareas, recursos y trazas).

A partir de ahí:

- Un algoritmo (el que elijas o implementes) consume spans, aprende, y publica recursos mejorados (por ejemplo, prompt templates refinados o nuevos pesos/políticas).

- Un Trainer orquesta el flujo: streaming de datasets a runners, intercambio de recursos entre store y algoritmo, y actualización del motor de inferencia cuando “caen” mejoras.

Este diseño es importante porque separa dos mundos que a menudo se mezclan mal:

- El mundo “online” (producción / inferencia / tool use).

- El mundo “training” (datasets, recompensas, evaluación, iteración).

Compatible con tu stack de agentes (la promesa de interoperabilidad)

Agent Lightning afirma poder trabajar con cualquier framework de agentes (menciona LangChain, OpenAI Agent SDK, AutoGen, CrewAI, Microsoft Agent Framework) o incluso sin framework, “a pelo” con Python.

La gracia aquí es operativa: si ya tienes agentes en marcha, no quieres reescribirlos para “hacer RL”. Quieres una capa que:

- observe,

- puntúe,

- y sugiera/mejore,

sin rehacer arquitectura.

La parte “seria”: RL para agentes y qué aporta el paper

El paper asociado (“Agent Lightning: Train ANY AI Agents with Reinforcement Learning”) describe un enfoque centrado en RL para agentes, con una arquitectura que busca hacer el entrenamiento más eficiente y escalable, y lo enmarca explícitamente como “entrenar cualquier agente” (no solo uno construido para RL desde el minuto cero).

En paralelo, la página de Microsoft Research describe Agent Lightning como un sistema que incluye Agent Lightning Server y Client, y lo sitúa como una infraestructura de entrenamiento que integra un OpenAI-compatible LLM API dentro del pipeline de training, con soporte para flujos de RL en agentes.

Traducido a lenguaje de calle: el proyecto intenta que sea viable (y repetible) entrenar agentes con bucles de recompensa sin convertir tu equipo en un laboratorio de research permanente.

Para qué casos tiene más sentido (y para cuáles no)

Casos donde Agent Lightning puede brillar

- Workflows con métricas objetivas: SQL que debe devolver un resultado correcto, agentes de búsqueda con ground truth, pipelines con validación automática, tareas con tests.

- Multi-agente: optimizar selectivamente un agente (planner/verifier/executor) dentro de un sistema más grande.

- Entornos donde el “prompt tuning manual” ya no escala: cuando tienes demasiadas tareas, demasiadas variantes, o demasiada rotación de comportamiento.

Casos donde puede ser una trampa

- Recompensas mal diseñadas: si el reward es pobre, el agente aprende atajos.

- Tareas ambiguas: “hazlo mejor” no es una métrica.

- Datos sensibles: si vas a almacenar trazas con prompts y tool outputs, necesitas higiene seria (secrets, PII, tokens). Agent training sin gobernanza es una fuga esperando ocurrir.

Mini “quickstart” conceptual (sin humo)

Instalación básica (según el propio repo):

pip install agentlightning

Y a partir de ahí, el patrón mental es:

- instrumenta (emit/tracing),

- captura trazas,

- define reward/evaluación,

- entrena/optimiza,

- publica recursos mejorados,

- vuelve a ejecutar.

El proyecto lo deja claro: el objetivo es que sigas usando tu framework, y añadas la capa de observabilidad + optimización.

Lo que significa para el mercado: menos “prompt whispering”, más ingeniería

Si esta línea cuaja, cambia el reparto del trabajo en equipos que despliegan agentes:

- Menos tiempo “a ojo” ajustando prompts.

- Más tiempo diseñando evaluaciones, recompensas, suites de tests, y observabilidad.

- Y, sobre todo, un salto cultural: tratar al agente como un sistema que se entrena y valida, no como un chatbot que “a veces se porta bien”.

Agent Lightning, además, se publica bajo licencia MIT, lo que facilita su adopción e integración en stacks internos y productos comerciales.