Los modelos de lenguaje grande (LLMs) continúan demostrando su versatilidad en el campo del procesamiento del lenguaje natural (NLP), abordando tareas que van desde diálogos simples hasta procesos complejos como la toma de decisiones y la generación de resúmenes detallados. Sin embargo, métodos tradicionales como la ingeniería de prompts y el ajuste fino supervisado han mostrado limitaciones significativas al intentar alinear estos modelos con las intenciones precisas de sus usuarios. Estos enfoques pueden ocasionar comportamientos no deseados, como la creación de información errónea, sesgos en los contenidos generados o respuestas que carecen de utilidad.

Un refinamiento en el entrenamiento de los LLMs mediante aprendizaje supervisado ofrece una solución parcial, pero no aborda completamente las complejidades éticas y sociales que son difíciles de condensar en ejemplos simples de entrenamiento. Esto a menudo resulta en comportamientos inesperados y contrarios a los objetivos iniciales de los desarrolladores.

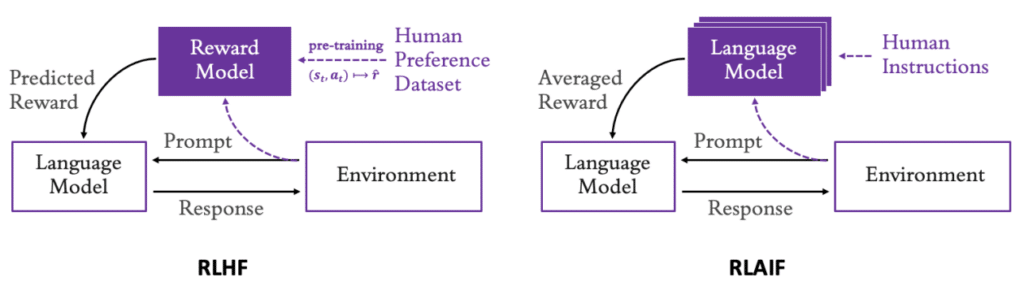

Recientemente, ha surgido una alternativa prometedora que emplea modelos de recompensa, entrenados a partir del feedback humano, para afinar el comportamiento de los LLMs según las preferencias y valores humanos. Este enfoque se conoce como entrenamiento por refuerzo con retroalimentación humana (RLHF, por sus siglas en inglés). No obstante, investigaciones recientes sugieren que la retroalimentación directa proveniente de otros modelos de lenguaje podría ser una vía efectiva para desarrollar estos modelos de recompensa, en un proceso denominado superalineación mediante retroalimentación de IA (RLAIF).

La técnica RLAIF permite emplear múltiplos LLMs, cada uno enfocado en una preferencia humana específica, como la relevancia, la concisión o la toxicidad, eliminando así la dependencia de servicios de anotación humana y optimizando el procedimiento. Los avances logrados con esta técnica apuntan a la creación de sistemas que se mantengan útiles, honrados y no perjudiciales, incluso cuando algunas capacidades de IA alcanzan o superan el desempeño humano.

Un ejemplo práctico de implementación de RLAIF podría incluir la generación de respuestas dentro de un conjunto de datos de diálogos, orientado a minimizar la toxicidad en las respuestas generadas. Este proceso aprovecharía modelos de recompensa accesibles públicamente para llevar a cabo el ajuste fino de los LLMs, evaluando posteriormente la eficacia de esta optimización a través de pruebas en un conjunto de datos reservado.

En síntesis, el desarrollo y ajuste de los modelos de lenguaje grandes se mantiene como un campo en constante evolución, donde técnicas emergentes como RLAIF abren nuevas posibilidades para mejorar la alineación de la IA con los valores humanos. Esto es esencial para asegurar que las respuestas generadas por estos sistemas sean más útiles y menos perjudiciales, afrontando así los desafíos éticos y técnicos que presenta la inteligencia artificial moderna. La investigación continua en esta área es fundamental para superar las barreras actuales y futuras en el desarrollo de la inteligencia artificial.