La industria de la Inteligencia Artificial acaba de vivir un movimiento poco habitual: Anthropic, OpenAI y Block han decidido colaborar —y no competir— para donar el Model Context Protocol (MCP) a la Linux Foundation y lanzar la nueva Agentic AI Foundation (AAIF), un fondo dirigido dentro de la propia fundación. La iniciativa cuenta, además, con el apoyo de pesos pesados como Google, Microsoft, Amazon Web Services (AWS), Cloudflare y Bloomberg.

El objetivo es claro: crear estándares abiertos y neutrales para la nueva era de la Agentic AI, en la que los modelos dejan de ser simples “chatbots” y se convierten en agentes capaces de actuar, orquestar herramientas y operar sobre datos y sistemas externos de forma autónoma.

Qué es MCP y por qué muchos lo llaman el “USB-C de la IA”

MCP (Model Context Protocol) nació en Anthropic como un protocolo abierto para conectar aplicaciones de IA con herramientas, APIs, bases de datos y otros sistemas externos. La idea es sencilla pero poderosa:

- Antes: si una empresa tenía M aplicaciones de IA (por ejemplo, varios asistentes, copilotos o interfaces) y N herramientas externas (APIs internas, CRMs, bases de datos, servicios cloud…), necesitaba M×N integraciones personalizadas.

- Ahora, con MCP: se construye un servidor MCP una sola vez por cada herramienta o sistema, y cualquier cliente compatible (Claude, ChatGPT, Gemini, editores de código, etc.) puede usarlo sin integración adicional.

De ahí la metáfora que muchos usan ya en la comunidad: MCP como una especie de USB-C de la IA, un conector estándar que sirve para casi todo.

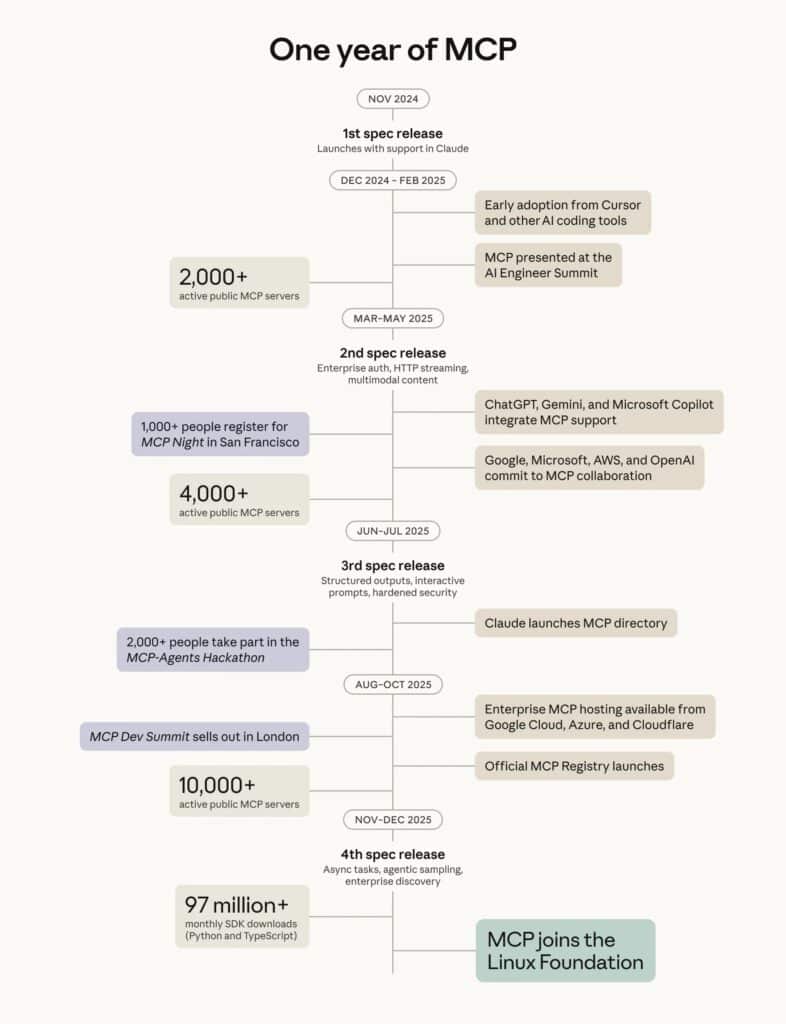

En solo un año, MCP ha alcanzado una adopción notable:

- Más de 10.000 servidores MCP públicos activos, cubriendo desde herramientas para desarrolladores hasta despliegues en grandes corporaciones.

- Integración en productos tan relevantes como ChatGPT, Cursor, Gemini, Microsoft Copilot o Visual Studio Code, entre otros.

- SDKs oficiales en los principales lenguajes de programación y decenas de millones de descargas mensuales, lo que indica una comunidad de desarrolladores muy activa (según los datos compartidos por Anthropic en su anuncio oficial).

En paralelo, Anthropic ha impulsado un directorio de conectores MCP para Claude con más de 75 integraciones listadas, y se ha creado un registry comunitario para descubrir servidores MCP disponibles, lo que refuerza su papel de estándar de facto en el ecosistema de herramientas para IA.

Nace la Agentic AI Foundation (AAIF) bajo el paraguas de la Linux Foundation

Con la donación de MCP, Anthropic da un paso más y sitúa el protocolo bajo la tutela de la Linux Foundation a través de la nueva Agentic AI Foundation (AAIF), un fondo dirigido cofundado por Anthropic, Block y OpenAI, con el respaldo de Google, Microsoft, AWS, Cloudflare y Bloomberg.

La Agentic AI Foundation arranca con tres proyectos fundacionales:

- Model Context Protocol (MCP), donado por Anthropic.

- AGENTS.md, una especificación impulsada por OpenAI para documentar y describir agentes de IA y sus capacidades.

- goose, un proyecto de Block ligado a agentes y automatización dentro de su ecosistema de productos.

El papel de la Linux Foundation es clave: la organización ya ha demostrado su capacidad para gestionar proyectos críticos y neutrales como Linux, Kubernetes, Node.js o PyTorch, convirtiéndolos en estándares de la industria gracias a una gobernanza abierta y a una colaboración inter-empresa que, de otro modo, sería difícil de sostener.

En este contexto, la AAIF aspira a repetir ese patrón, pero aplicado a la futura generación de agentes de Inteligencia Artificial: herramientas, protocolos y especificaciones compartidas, sobre las que luego cada empresa construirá sus propios productos diferenciados.

Rivales colaborando: por qué este movimiento importa

La foto es llamativa: Anthropic y OpenAI, rivales directos en el mercado de grandes modelos de lenguaje, alineándose en torno a un estándar común junto a los grandes proveedores cloud y a actores clave del ecosistema tecnológico.

Detrás hay un cálculo estratégico bastante claro:

- Un estándar percibido como neutral y comunitario tiene muchas más probabilidades de lograr adopción masiva que uno visto como propietario de un único actor.

- Para empresas como OpenAI, adoptar MCP significa reconocer el valor de una arquitectura diseñada inicialmente por un competidor, pero que ahora se convierte en infraestructura compartida, al estilo de lo que ocurrió con Kubernetes en 2015 cuando Google lo donó a la CNCF.

- Al reducir la fragmentación de integraciones (cada asistente hablando su “idioma” con las APIs), todos salen ganando: desarrolladores, plataformas de IA y empresas usuarias.

En otras palabras: la industria parece haber decidido que tiene más sentido colaborar en la “fontanería” de los agentes —los protocolos, conectores y estándares— y competir en el producto final: modelos, UX, calidad de los agentes y servicios asociados.

Qué cambia para desarrolladores y empresas

Para los desarrolladores, MCP y la Agentic AI Foundation apuntan a un futuro bastante concreto:

- Menos integraciones ad hoc: construir un servidor MCP para una API interna, una base de datos o un SaaS crítico permitirá que múltiples asistentes y herramientas de IA lo utilicen sin trabajo adicional.

- Mayor portabilidad: si una empresa decide cambiar de proveedor de modelo (por ejemplo, de un LLM a otro, o combinar varios), puede seguir reutilizando los mismos servidores MCP para conectarse a sus sistemas.

- Ecosistema de herramientas más rico: con un registry oficial, SDKs maduros y soporte en editores y clientes de escritorio, MCP se consolida como capa común para orquestar herramientas, datos y flujos de trabajo agénticos.

Para las organizaciones, el impacto es doble:

- Gobernanza y seguridad más claras

Un estándar bien definido facilita el control de qué agentes pueden acceder a qué herramientas, con qué permisos y bajo qué políticas. Esto es clave en entornos regulados o con datos sensibles. - Inversión reutilizable

Cada conector MCP que una empresa construye deja de ser una inversión “atada” a un solo proveedor y pasa a ser un activo reutilizable en múltiples plataformas y productos de IA.

Un “momento Kubernetes” para la IA agéntica

Varios analistas ya comparan este movimiento con el “momento Kubernetes” de la infraestructura de contenedores: cuando la industria decidió que merecía la pena compartir una capa común para luego innovar por encima de ella.

La creación de la Agentic AI Foundation, con Anthropic, OpenAI, Block y los grandes proveedores cloud en la misma mesa, sugiere que algo parecido está ocurriendo ahora en el terreno de la IA agéntica.

Que MCP, goose y AGENTS.md nazcan bajo el paraguas de la Linux Foundation envía un mensaje claro: los estándares que definan cómo los agentes de Inteligencia Artificial se conectan a herramientas, datos y sistemas no pueden estar controlados por una sola compañía si se aspira a una adopción realmente global.

El futuro del desarrollo parece cada vez más agéntico. Y, al menos sobre el papel, el estándar de conexión ya está encima de la mesa. La pregunta ahora es cuán rápido empresas y desarrolladores lo incorporarán a su flujo de trabajo diario.

vía: Anthropic y Model Context Protocol