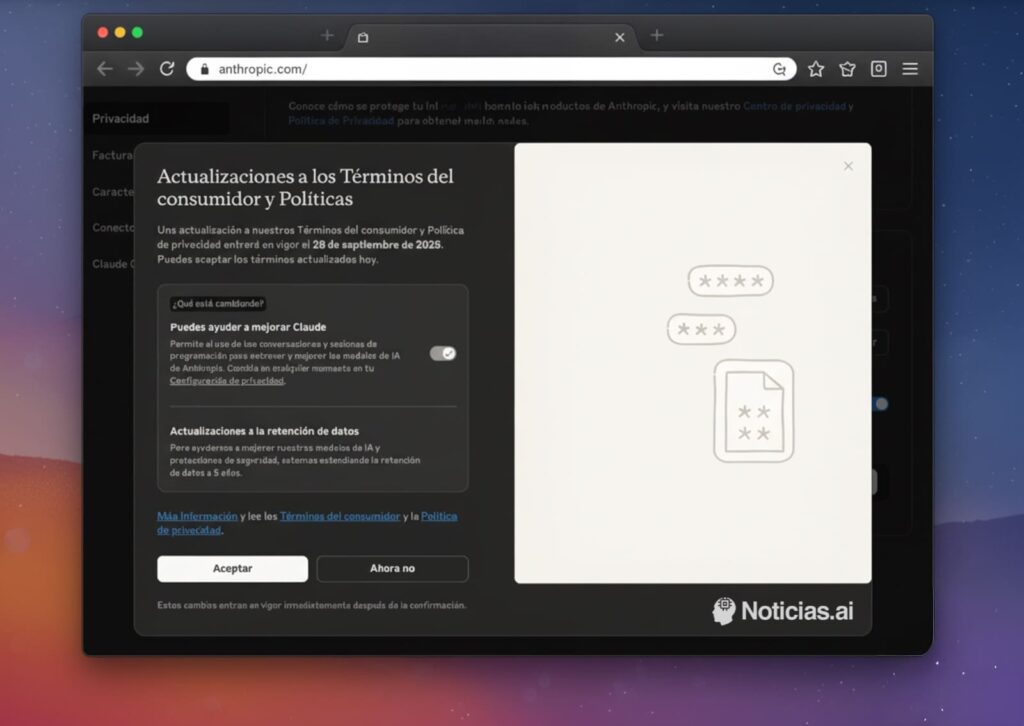

Anthropic, la empresa creadora de Claude AI, ha anunciado una actualización importante en sus Términos de Uso y Política de Privacidad que afecta directamente a sus millones de usuarios en todo el mundo. A partir de ahora, las conversaciones que los usuarios mantengan con el asistente de IA podrán ser utilizadas para entrenar sus modelos, a menos que se opte expresamente por desactivar esta opción.

Hasta ahora, Anthropic se había diferenciado de otras grandes compañías como OpenAI o Google por asegurar que Claude no utilizaba los datos de usuario en sus entrenamientos. Sin embargo, este cambio marca un giro en su estrategia.

Qué cambia con la nueva política

Según la compañía, las conversaciones, sesiones de programación y chats con Claude podrán ser almacenados y procesados con fines de entrenamiento de modelos de IA. Anthropic justifica la medida alegando que así se refuerzan las defensas contra abusos, fraudes o generación de contenido dañino.

Los usuarios tienen de plazo hasta el 28 de septiembre de 2025 para aceptar o rechazar los nuevos términos. Si se aceptan ahora, la medida entra en vigor de manera inmediata.

La opción por defecto es que los datos sí se utilicen. Para evitarlo, es necesario entrar en la página de ajustes de privacidad y desactivar el interruptor “You can help improve Claude”, que aparece activado de manera predeterminada.

Un detalle llamativo: 5 años de retención de datos

Otro punto que ha generado polémica es el tiempo de conservación de la información. Anthropic declara que mantendrá los datos recopilados durante cinco años, un periodo considerado excesivamente largo por muchos expertos en privacidad.

La empresa aclara que los datos no se almacenarán si el usuario no autoriza su uso para el entrenamiento de modelos, pero el hecho de que la retención sea tan prolongada despierta dudas sobre el equilibrio entre seguridad, innovación y derechos de los usuarios.

A quién afecta el cambio

Las nuevas reglas afectan a los planes Claude Free, Pro y Max. No obstante, quedan fuera los servicios que operan bajo los llamados “Términos Comerciales de Anthropic”, como Claude for Work, Claude Gov, Claude for Education o las integraciones mediante APIs en plataformas de terceros como Amazon Bedrock o Google Cloud Vertex AI.

Es decir, los usuarios individuales y la mayoría de profesionales suscritos verán impactados sus datos por defecto, salvo que hagan el proceso de exclusión manual.

El debate de fondo: ¿innovación o pérdida de privacidad?

Anthropic asegura que no vende los datos a terceros y que aplica procesos automáticos para filtrar o anonimizar información sensible. Sin embargo, la medida supone un paso atrás para muchos que veían a la compañía como un referente en privacidad dentro del sector.

El cambio opt-out (exclusión voluntaria), en el que el usuario debe desmarcar una casilla en lugar de dar un consentimiento expreso, ha sido criticado por expertos en protección de datos y asociaciones de consumidores. Esta práctica suele interpretarse como una estrategia que aprovecha la inacción de los usuarios para obtener más datos.

El contraste con otras compañías también es evidente: mientras Vivaldi, el navegador alternativo, anunciaba hace unos días que no integrará IA generativa en su software para preservar la experiencia humana y proteger la web abierta, Anthropic ha tomado el camino opuesto.

Una decisión con posibles precedentes legales

Más allá de la polémica social, el movimiento podría sentar precedentes jurídicos. En EE. UU. y la Unión Europea existen debates abiertos sobre la propiedad intelectual de los datos utilizados en el entrenamiento de IA, así como sobre el cumplimiento del Reglamento General de Protección de Datos (RGPD).

Si bien Anthropic habla de un uso “legítimo” orientado a la mejora de la seguridad y calidad de sus modelos, organizaciones de defensa digital advierten que este tipo de políticas podrían enfrentarse a litigios si no se respeta el consentimiento informado y explícito.

Preguntas frecuentes (FAQ)

1. ¿Cómo puedo evitar que Claude AI use mis datos para entrenar sus modelos?

Debes acceder a claude.ai/settings/data-privacy-controls y desactivar el interruptor que aparece marcado por defecto.

2. ¿Qué pasa si no rechazo los nuevos términos antes del 28 de septiembre de 2025?

Tus datos de nuevas conversaciones y sesiones serán almacenados y utilizados por Anthropic durante un periodo de hasta cinco años.

3. ¿Se aplican estos cambios a todos los planes de Claude?

Sí, afectan a los planes Free, Pro y Max. No obstante, quedan fuera los servicios comerciales como Claude for Work, Gov, Education o las integraciones API.

4. ¿Vende Anthropic mis datos a terceros?

La compañía afirma que no. Asegura que solo los usa para entrenar y mejorar sus propios modelos de IA, aplicando procesos de anonimización en la información sensible.

vía: anthropic