En el creciente ámbito del análisis de datos, la fusión con tecnologías de inteligencia artificial se ha convertido en una tendencia destacada, especialmente a través de plataformas como Amazon OpenSearch. Esta herramienta permite realizar búsquedas y análisis extensos sobre grandes volúmenes de datos. Sin embargo, a menudo surge la necesidad de enriquecer estos datos antes de indexarlos, como al procesar registros con direcciones IP que requieren una determinación geográfica o al analizar comentarios de clientes para identificar el idioma en que se han escrito.

Anteriormente, este enriquecimiento de datos dependía de procesos externos, complicando las canalizaciones de ingestión y poniendo en riesgo su eficiencia. Ahora, OpenSearch ha lanzado conectores de aprendizaje automático de terceros que simplifican y mejoran este proceso.

Entre estos conectores figura Amazon Comprehend, utilizado para identificar el idioma de documentos mediante la API LangDetect. Otro ejemplo es Amazon Bedrock, que facilita la búsqueda semántica en múltiples idiomas utilizando el modelo de embeddings de texto Amazon Titan Text Embeddings v2.

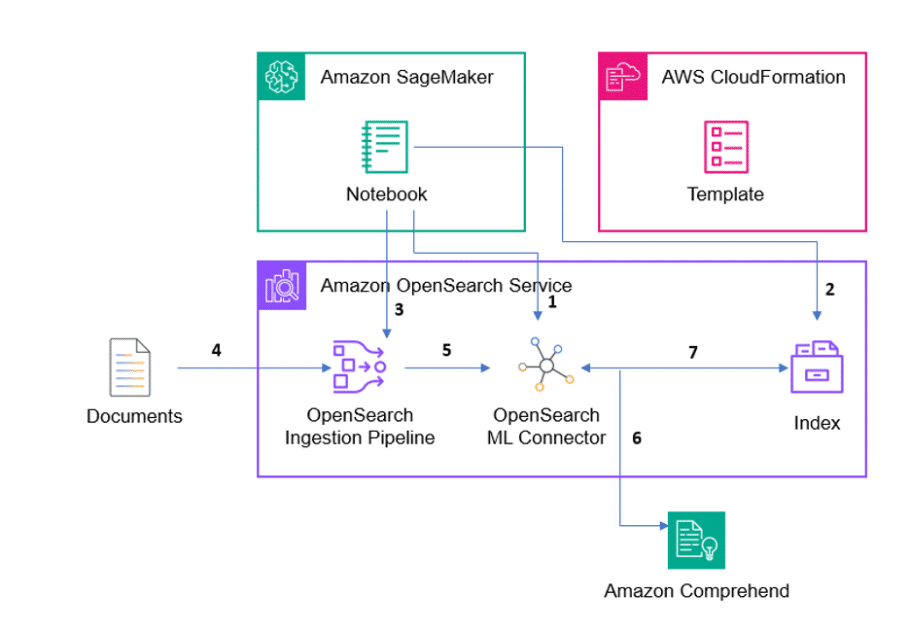

La implementación de estas capacidades se ilustra mediante un cuaderno de Amazon SageMaker y una plantilla de AWS CloudFormation, proporcionando a los usuarios los recursos necesarios para replicar el proceso. Esto incluye configurar OpenSearch para acceder adecuadamente a Amazon Comprehend, asegurando permisos mediante un rol IAM correctamente mapeado.

Un pipeline de ingestión también se ofrece, integrando la API de Amazon Comprehend para añadir información de idioma durante la indexación de documentos. Esto demuestra la facilidad con la que OpenSearch puede integrar modelos de aprendizaje automatizado de terceros a través de conectores, optimizando la búsqueda y el análisis.

Amazon Bedrock, el segundo conector, destaca la capacidad de efectuar búsquedas semánticas multilingües. Utilizando el modelo de embeddings, se crean vectores de texto a partir de documentos en varios idiomas. Este proceso estructurado involucra la carga de documentos en dataframes y la creación de un índice que almacena tanto los vectores generados como el texto original y su traducción al inglés.

Estos conectores no solo simplifican la arquitectura del sistema; también reducen la infraestructura necesaria, facilitan el mantenimiento, y mejoran la escalabilidad. Además, los costos operativos son más eficientes al eliminar la necesidad de gestionar endpoints y permitir una facturación más clara.

En resumen, con estas innovaciones, Amazon OpenSearch se posiciona como una herramienta esencial para quienes desean no solo almacenar y buscar datos, sino enriquecer su contenido, permitiendo tomar decisiones basadas en información precisa y contextual.