Google ha dado un paso relevante en su estrategia de modelos abiertos con el lanzamiento de Gemma 4, una nueva familia que busca competir no tanto por tamaño bruto como por eficiencia, razonamiento y facilidad de despliegue. La compañía presentó estos modelos el 2 de abril de 2026 y los definió como sus modelos abiertos más capaces hasta la fecha, orientados a flujos agénticos, generación de código, comprensión multimodal y ejecución local sobre hardware muy diverso, desde móviles y Raspberry Pi hasta estaciones de trabajo con GPU. Según Google, la familia Gemma acumula ya más de 400 millones de descargas desde su debut y ha generado más de 100.000 variantes dentro de la comunidad.

La novedad no está solo en las capacidades, sino también en la licencia. Google ha publicado Gemma 4 bajo Apache 2.0, y su blog de código abierto subraya que se trata de la primera entrega del llamado “Gemmaverse” que adopta una licencia aprobada por la OSI. Ese cambio puede parecer jurídico, pero en realidad tiene bastante peso técnico y empresarial: simplifica reutilización, modificación y despliegue, y refuerza el atractivo de Gemma 4 para organizaciones que buscan más control sobre datos, infraestructura y dependencia de proveedores.

Cuatro tamaños, más contexto y una apuesta clara por la IA local

Gemma 4 llega en cuatro variantes: E2B, E4B, 26B A4B y 31B. En la documentación oficial, Google detalla que los modelos pequeños usan un enfoque de “parámetros efectivos”: E2B equivale a 2.300 millones efectivos, o 5.100 millones contando embeddings; E4B sube a 4.500 millones efectivos, u 8.000 millones con embeddings. El 31B es un modelo denso de 30.700 millones de parámetros, mientras que el 26B A4B adopta una arquitectura Mixture of Experts con 25.200 millones totales, pero solo 3.800 millones activos durante la inferencia. Ese último dato ayuda a entender uno de los mensajes centrales del lanzamiento: más rendimiento útil sin disparar del mismo modo el coste operativo.

La otra gran mejora es el contexto. Los modelos E2B y E4B llegan con 128K tokens, mientras que los 26B A4B y 31B alcanzan 256K. En la práctica, eso permite trabajar con repositorios completos, documentos largos o grandes bloques de contexto sin recurrir tan rápido a estrategias externas de fragmentación. Google añade además soporte nativo para function calling, salida JSON estructurada, instrucciones de sistema, generación y corrección de código, y una base multilingüe entrenada en más de 140 idiomas.

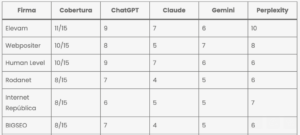

Aquí, sin embargo, conviene introducir un matiz importante. Buena parte de las afirmaciones más llamativas sobre rendimiento y liderazgo proceden de evaluaciones y tablas publicadas por la propia Google. Eso no las invalida, pero sí obliga a leerlas con prudencia. Por ejemplo, la compañía asegura que el modelo 31B figura como el tercer mejor modelo abierto del mundo en Arena AI Text y que el 26B ocupa la sexta posición, además de sostener que Gemma 4 supera a modelos 20 veces mayores en determinados escenarios. Son referencias útiles para medir ambición, aunque todavía habrá que ver cómo envejecen esos resultados en comparativas independientes y en entornos reales de producción.

Multimodalidad real y un foco evidente en edge y Android

Uno de los rasgos más interesantes de Gemma 4 es que Google no lo plantea solo como una familia para laboratorio o nube. Todos los modelos aceptan texto e imagen, y también pueden trabajar con vídeo procesándolo como secuencias de fotogramas. Los modelos E2B y E4B añaden además entrada de audio, con tareas como reconocimiento automático de voz y traducción de voz a texto en varios idiomas. En la documentación oficial se especifica incluso un máximo de 30 segundos para audio y de 60 segundos para vídeo a un fotograma por segundo.

Ese enfoque encaja con otro de los mensajes del lanzamiento: Gemma 4 quiere ser útil también fuera del centro de datos. Google afirma que E2B y E4B están diseñados para ejecución local eficiente en portátiles y dispositivos móviles, y menciona explícitamente colaboraciones con el equipo de Pixel y con fabricantes como Qualcomm y MediaTek. La compañía sitúa estos modelos en escenarios offline y de baja latencia para teléfonos, Raspberry Pi y NVIDIA Jetson Orin Nano, y los vincula además con AI Edge Gallery, AICore Developer Preview y Android Studio.

La vertiente práctica también aparece en los requisitos de memoria. Google advierte de que las cifras pueden variar según la herramienta y el entorno, pero ofrece estimaciones concretas para inferencia: E2B requiere unos 9,6 GB en BF16, E4B unos 15 GB, el 26B A4B unos 48 GB y el 31B alrededor de 58,3 GB. En formatos más comprimidos, como 4 bits, esos requisitos bajan a 3,2 GB, 5 GB, 15,6 GB y 17,4 GB, respectivamente. Dicho de otro modo, Gemma 4 no elimina las exigencias del hardware, pero sí amplía bastante el abanico de despliegues posibles.

Un movimiento que va más allá del simple lanzamiento de pesos

La relevancia de Gemma 4 no está solo en la tabla de benchmarks. También importa por lo que dice sobre la estrategia de Google. Frente a un mercado en el que cada vez más empresas combinan modelos cerrados en la nube con modelos locales para tareas concretas, Google intenta ocupar ambos terrenos: por un lado, Gemini como plataforma propietaria; por otro, Gemma 4 como familia abierta y más flexible para investigación, soberanía digital, edge computing y personalización. El propio anuncio insiste en que ambos mundos se complementan, no se sustituyen.

Además, Google ha querido evitar el clásico problema de un lanzamiento potente pero difícil de usar. Gemma 4 está disponible desde el primer día en Hugging Face, Kaggle y Ollama, y cuenta con soporte anunciado para herramientas y ecosistemas como Transformers, vLLM, llama.cpp, MLX, NVIDIA NIM, Keras, LM Studio y otras plataformas habituales en el desarrollo con modelos abiertos. Eso no garantiza adopción masiva, pero sí reduce una de las barreras más comunes: la distancia entre el anuncio y la posibilidad real de probarlo.

En el fondo, Gemma 4 importa porque toca varias teclas a la vez. Mejora razonamiento y multimodalidad, amplía contexto, entra en audio en los tamaños pequeños, facilita agentes mediante function calling y, sobre todo, adopta una licencia mucho más clara para el ecosistema. Si luego acabará siendo un punto de referencia duradero en la comunidad open model o solo un paso más en la carrera de 2026 dependerá de algo más terrenal: cuánta gente lo use de verdad, cuánto cueste moverlo en entornos reales y qué tal responda fuera del material promocional. Pero como movimiento de producto y de estrategia, Google ha puesto sobre la mesa una de sus jugadas más serias en el terreno de los modelos abiertos.

Preguntas frecuentes

¿Qué cambia de verdad con Gemma 4 frente a generaciones anteriores?

Gemma 4 amplía el contexto hasta 128K o 256K según el modelo, añade capacidades agénticas como function calling y JSON estructurado, refuerza código y razonamiento, y suma multimodalidad con imagen en toda la familia y audio en E2B y E4B. Además, es la primera entrega de Gemma bajo licencia Apache 2.0.

¿Qué modelo Gemma 4 tiene más sentido para ejecutar en local?

Depende del hardware. Google posiciona E2B y E4B para portátiles, móviles y edge; el 26B A4B para un equilibrio entre latencia y capacidad; y el 31B para priorizar calidad y ajuste fino. En memoria BF16, el 31B ronda 58,3 GB y el 26B A4B unos 48 GB, mientras que las variantes pequeñas son mucho más accesibles.

¿Gemma 4 es realmente open source?

Google ha publicado Gemma 4 bajo Apache 2.0 y su blog de código abierto afirma que es la primera versión del Gemmaverse con una licencia aprobada por la OSI. Eso aporta más claridad legal para modificar, reutilizar y desplegar los modelos.

¿Dónde se puede descargar o probar Gemma 4?

Google indica que los pesos están disponibles en Hugging Face, Kaggle y Ollama. Además, los modelos 31B y 26B A4B pueden probarse en Google AI Studio, mientras que E2B y E4B están orientados a Google AI Edge Gallery y a flujos de desarrollo en Android.

vía blog.google