Z.ai ha puesto sobre la mesa uno de los movimientos más llamativos del momento en el mercado de los modelos abiertos para desarrollo: GLM-5.1, una nueva versión de su familia GLM centrada en tareas de ingeniería agéntica, programación y ejecución prolongada. La compañía la presenta como su modelo insignia para trabajo técnico de largo recorrido, con una ventana de contexto de 200K, salida máxima de 128K tokens y una capacidad sostenida de trabajo autónomo de hasta 8 horas sobre una misma tarea. En su documentación oficial, Z.ai asegura además que GLM-5.1 se sitúa “alineado” con Claude Opus 4.6 en capacidad general y de código, y destaca mejoras claras en razonamiento, uso de herramientas y estabilidad durante tareas largas.

La noticia ha ganado más fuerza porque GLM-5.1 ya no se queda solo en la nube o en despliegues empresariales pesados. También se puede ejecutar en local gracias a su disponibilidad en frameworks abiertos y a las cuantizaciones publicadas por Unsloth. La propia ficha oficial del modelo en Hugging Face indica soporte para despliegue local con SGLang, vLLM, xLLM, Transformers y KTransformers, mientras que la guía de Unsloth explica cómo moverlo en llama.cpp y en Unsloth Studio. Eso cambia bastante el ángulo del anuncio: ya no se trata solo de un modelo grande con buenos benchmarks, sino de uno que entra directamente en la conversación sobre qué puede correr un desarrollador avanzado en su propio hardware.

Un modelo pensado para tareas largas, no solo para una buena primera respuesta

La propuesta de Z.ai es clara: GLM-5.1 no quiere competir únicamente en la típica foto fija de una respuesta brillante, sino en lo que ocurre cuando un agente tiene que seguir trabajando durante horas, iterar, revisar, lanzar pruebas y corregir. La compañía insiste en que el salto más importante no está en una generación inicial más vistosa, sino en la capacidad de sostener una cadena larga de decisiones sin perder eficacia demasiado pronto. En su documentación, Z.ai afirma que GLM-5.1 puede mantener ciclos de experimento, análisis y optimización durante cientos de rondas y miles de invocaciones de herramientas, y pone como ejemplo mejoras sustanciales en tareas de optimización de rendimiento y construcción de sistemas.

Ese enfoque conecta con una tendencia cada vez más visible en el sector: el valor de un modelo para desarrollo ya no se mide solo por cómo escribe código, sino por cómo aguanta tareas ambiguas, instrumenta pruebas, interpreta resultados y corrige estrategia. Z.ai incluso plantea que la evaluación del rendimiento está cambiando desde “qué tan inteligente es en un turno” hacia “cuánto tiempo puede trabajar bien y qué es capaz de entregar al final”. Es una idea ambiciosa y, al mismo tiempo, una forma de diferenciarse en un mercado saturado de modelos que prometen mucho en benchmarks cortos y se desinflan cuando el problema exige persistencia operativa.

Benchmarks fuertes, pero todavía con la cautela habitual

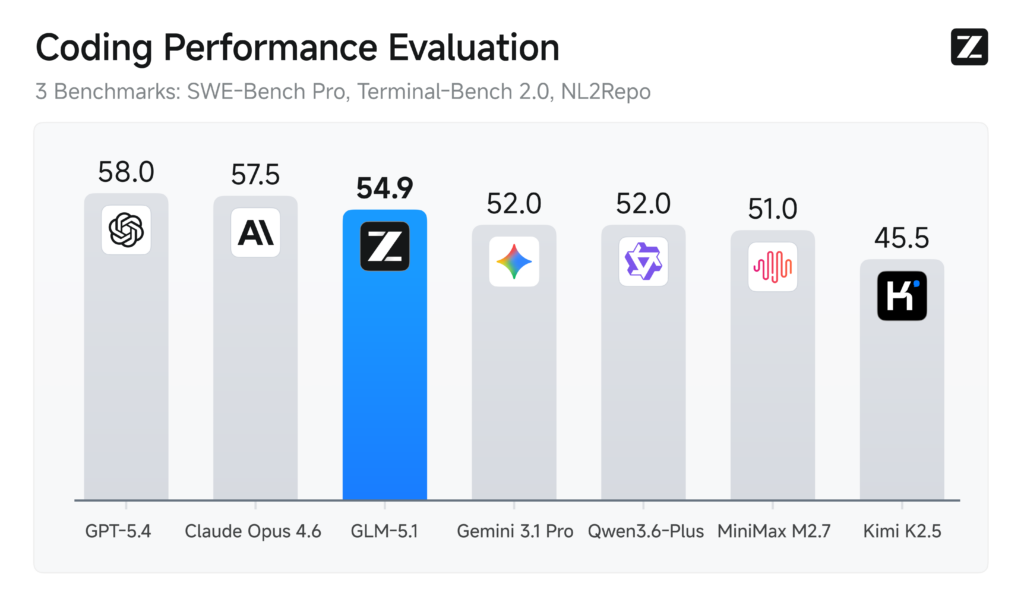

En rendimiento, Z.ai no se ha quedado corto en la presentación. La documentación oficial sitúa a GLM-5.1 con un 58,4 en SWE-Bench Pro, por delante de GPT-5.4, Claude Opus 4.6 y Gemini 3.1 Pro, y lo describe como un nuevo máximo en esa prueba. También afirma que lidera frente a GLM-5 en NL2Repo y Terminal-Bench 2.0, y que su perfil es más equilibrado en razonamiento, código, navegación, agentes y uso de herramientas. La ficha pública en Hugging Face repite esa línea y muestra una batería de benchmarks donde GLM-5.1 aparece compitiendo en la parte alta del mercado.

Ahora bien, como ocurre con cualquier lanzamiento de este tipo, conviene mantener cierta prudencia. Muchas de las afirmaciones más llamativas proceden de Z.ai y de sus propios materiales de distribución, así que todavía hará falta ver comparativas independientes, uso en entornos reales y validaciones cruzadas del ecosistema para saber hasta qué punto esas ventajas se sostienen fuera del marco promocional. Eso no invalida el anuncio, pero sí aconseja evitar titulares absolutos sobre un dominio incontestable del mercado open model.

Lo más interesante: ya hay una ruta real para moverlo en local

La parte más práctica del anuncio está en la ejecución local. Unsloth explica que el modelo completo parte de una huella enorme: 744.000 millones de parámetros totales, con 40.000 millones activos, y alrededor de 1,65 TB de espacio para la versión completa. La cuantización dinámica cambia esa historia. Según la documentación de Unsloth, la reducción con GGUF dinámico a 2 bits baja el tamaño a una horquilla en torno a 220-236 GB, dependiendo de la variante concreta, mientras que el modo dinámico de 1 bit puede rondar los 200 GB. La guía recomienda en particular la cuantización UD-IQ2_M, que sitúa en 236 GB y que, según Unsloth, cabe de forma directa en un Mac con 256 GB de memoria unificada o en configuraciones mixtas con bastante RAM y algo de VRAM.

Eso no significa que GLM-5.1 se convierta de repente en un modelo doméstico para cualquiera. Sigue siendo una bestia. El propio material de Unsloth advierte de que, si la memoria total disponible no supera el tamaño del modelo cuantizado, llama.cpp puede recurrir al almacenamiento SSD o HDD, pero con una penalización clara en velocidad. En otras palabras, “correr en local” aquí no quiere decir “correr cómodamente en cualquier portátil”, sino abrir la puerta a estaciones de trabajo serias, equipos con muchísima memoria o ciertos Mac de gama alta muy concretos. La diferencia es importante: el acceso local existe, pero sigue siendo un privilegio de hardware, no una democratización total.

Un mensaje estratégico para el ecosistema open model

Más allá de los números, GLM-5.1 refuerza una tendencia que se está acelerando en 2026: los modelos abiertos ya no compiten solo por ser más pequeños o más baratos, sino por acercarse a los sistemas cerrados de primer nivel en programación agéntica, tool use y trabajo de larga duración. Z.ai lo dice sin rodeos al presentar GLM-5.1 como un modelo para “agentic engineering”, no simplemente para generar código. Eso lo coloca en una liga donde el modelo tiene que saber planificar, usar herramientas, sostener iteraciones largas y operar con una lógica bastante más cercana a la de un agente que a la de un simple chatbot.

Si además ese tipo de modelo puede desplegarse en local, aunque sea en máquinas muy potentes, el impacto potencial es importante. Para equipos que trabajan con repositorios privados, automatización compleja o necesidades estrictas de soberanía tecnológica, poder acercarse a ese nivel de capacidad sin depender enteramente de una API remota es una propuesta cada vez más atractiva. GLM-5.1 todavía tendrá que demostrar qué tal se comporta fuera del material oficial y cuánto de su ventaja sobrevive al uso diario, pero el mensaje ya es claro: la frontera entre modelo abierto de laboratorio y sistema serio para producción local se está estrechando más rápido de lo que parecía hace solo unos meses.

Preguntas frecuentes

¿Qué es exactamente GLM-5.1?

Es el nuevo modelo insignia de Z.ai para tareas de programación, agentes y trabajo de largo recorrido. Su documentación oficial le atribuye una ventana de contexto de 200K, salida máxima de 128K y capacidad para sostener tareas autónomas durante hasta 8 horas.

¿Se puede ejecutar GLM-5.1 en local de verdad?

Sí, pero no en cualquier equipo. La ficha oficial indica soporte local en varios frameworks abiertos, y Unsloth ha publicado cuantizaciones GGUF para llama.cpp y su propia interfaz. Aun así, las versiones prácticas siguen exigiendo muchísima memoria.

¿Cuánta memoria necesita la versión local cuantizada?

Unsloth sitúa la cuantización dinámica recomendada UD-IQ2_M en 236 GB y habla de una reducción general a un rango cercano a 220 GB para ciertas versiones. Eso la coloca en el terreno de máquinas con 256 GB de memoria unificada o configuraciones muy generosas en RAM y VRAM.

¿Es realmente uno de los mejores modelos abiertos para programar?

Z.ai afirma que sí y apoya esa tesis en benchmarks como SWE-Bench Pro, Terminal-Bench 2.0 y NL2Repo. De momento, esa posición depende todavía en buena parte de métricas y materiales oficiales, así que faltará ver más validación independiente y uso real en el ecosistema.

vía: unsloth.ai