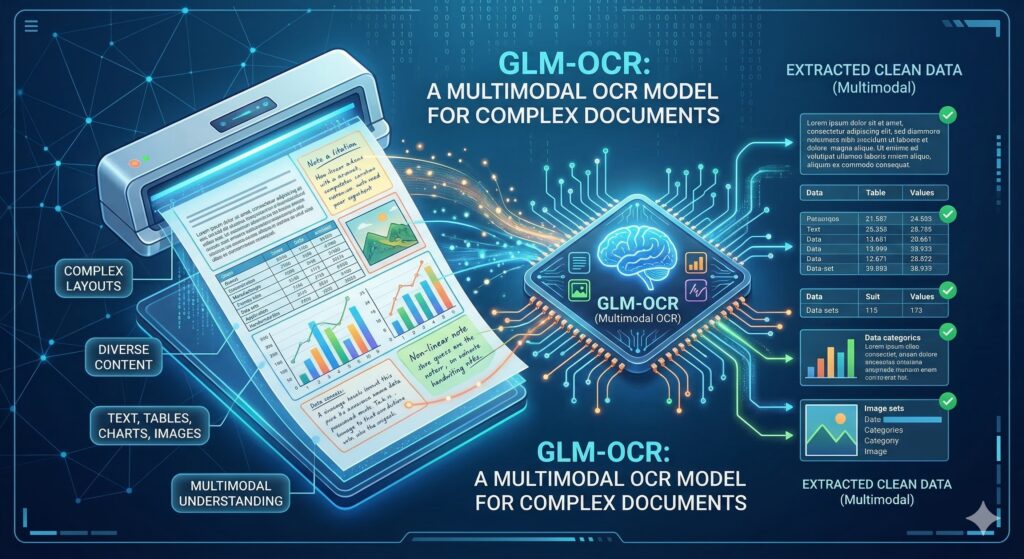

El mercado de la comprensión documental con Inteligencia Artificial acaba de sumar un competidor muy serio. GLM-OCR, publicado como proyecto open source por Z.ai, se presenta como un modelo multimodal de OCR para documentos complejos con solo 0,9B parámetros, una cifra muy baja para los estándares actuales del sector. Según sus autores, esa combinación de tamaño contenido y rendimiento elevado le permite aspirar tanto a despliegues locales como a servicios de producción con costes mucho más bajos que los de modelos mayores.

Lo llamativo no es solo el tamaño. El repositorio oficial, la ficha de Hugging Face y la documentación de Transformers coinciden en que el modelo alcanzó 94,62 puntos en OmniDocBench V1.5, donde aparece como número uno en ese benchmark, además de destacar en tareas como reconocimiento de fórmulas, tablas e información estructurada. Ahora bien, conviene poner el dato en contexto: hablamos de un benchmark de comprensión documental y OCR, no de una clasificación generalista donde tenga sentido afirmar sin más que “humilla” a GPT, Gemini u otros modelos de propósito general.

Un OCR pequeño, pero diseñado para documentos difíciles

Según el informe técnico publicado en arXiv, GLM-OCR combina un encoder visual CogViT de 0,4B parámetros con un decoder lingüístico GLM de 0,5B, dentro de una arquitectura encoder-decoder optimizada para documentos reales. El sistema incorpora además un mecanismo de Multi-Token Prediction (MTP) y una canalización en dos fases: primero analiza el layout con PP-DocLayout-V3 y después realiza reconocimiento paralelo por regiones. Esa combinación busca mejorar la velocidad de inferencia, la precisión de lectura y la robustez frente a páginas con maquetación compleja.

El mensaje del proyecto es claro: no quiere ser solo otro OCR para textos sencillos, sino una herramienta orientada a tablas complejas, documentos con mucho código, sellos, fórmulas y diseños difíciles, es decir, justo los casos donde muchas soluciones más básicas empiezan a fallar. Tanto la ficha oficial del modelo como la documentación integrada en Transformers remarcan esa orientación a escenarios empresariales y de producción, no solo a demos de laboratorio.

Local, open source y con varios caminos de despliegue

Uno de los elementos que más interés puede generar alrededor de GLM-OCR es su flexibilidad de despliegue. El proyecto ofrece uso a través de la API MaaS de Zhipu, pero también documenta despliegues locales con vLLM, SGLang, Ollama y MLX para Apple Silicon. Además, dispone de un SDK propio para Python y CLI, con modos de instalación más ligeros para cloud y otros más completos para autoalojado. En la práctica, eso permite usarlo tanto como servicio remoto como dentro de una infraestructura propia.

Aquí es importante rebajar otra exageración que circula en redes. El argumento de que “funciona en menos de 1,5 GB de VRAM” no aparece respaldado en la documentación oficial consultada. De hecho, la guía de despliegue con MLX indica que GLM-OCR “debería caber cómodamente en 8 GB de memoria unificada”, mientras que la guía de fine-tuning menciona 8 GB de VRAM para LoRA y alrededor de 24 GB para fine-tuning completo. Eso no le quita mérito como modelo compacto, pero sí sugiere que el relato de “casi cualquier portátil” debe tomarse con cautela, especialmente en despliegues locales serios.

Una señal clara del nuevo rumbo del OCR

Más allá del modelo concreto, GLM-OCR encaja con una tendencia cada vez más visible: los sistemas de OCR modernos ya no compiten solo en extraer texto, sino en entender documentos. Eso incluye reconstruir tablas, interpretar fórmulas, preservar estructura y devolver salidas en formatos más útiles para flujos automatizados, como JSON o Markdown. El propio proyecto muestra ambos formatos como salida estándar y propone una arquitectura modular pensada para integrarse en pipelines reales.

Ese enfoque también ayuda a explicar por qué un modelo relativamente pequeño puede resultar tan atractivo. En muchas empresas y equipos de desarrollo, el problema no es tener el OCR más enorme del mercado, sino conseguir una combinación equilibrada entre precisión, coste, latencia y facilidad de integración. GLM-OCR intenta entrar justo por ahí: tamaño contenido, pipeline relativamente claro, licencia abierta y opciones tanto de nube como de self-hosting. El código del repositorio está bajo Apache 2.0, mientras que el modelo se publica bajo licencia MIT, un detalle relevante para adopción técnica y comercial.

También hay otra lectura interesante: la del ecosistema alrededor del proyecto. GLM-OCR ya cuenta con soporte documentado en Transformers, lo que reduce bastante la fricción para investigadores y desarrolladores, y su SDK añadió recientemente un modo orientado a agentes y CLI más simple. Eso sugiere que Z.ai no quiere limitarse a liberar pesos y un paper, sino intentar que el modelo circule rápido entre herramientas, entornos locales y servicios de automatización documental.

En conjunto, GLM-OCR no demuestra que los modelos gigantes hayan perdido sentido, pero sí lanza un mensaje incómodo para muchos competidores: en OCR y comprensión documental, el tamaño ya no basta como argumento. Si un modelo de 0,9B puede colocarse en cabeza de benchmarks especializados y, al mismo tiempo, ofrecer despliegue local razonable, el listón para justificar modelos mucho más pesados empieza a subir bastante.

Preguntas frecuentes

¿Qué es exactamente GLM-OCR?

Es un modelo multimodal de OCR y comprensión documental de 0,9B parámetros desarrollado por Z.ai, orientado a documentos complejos y con soporte para salidas estructuradas como JSON y Markdown.

¿Qué benchmark lidera GLM-OCR según sus autores?

El proyecto afirma haber logrado 94,62 puntos en OmniDocBench V1.5, donde figura como número uno en ese benchmark de OCR y comprensión documental.

¿Se puede ejecutar GLM-OCR en local?

Sí. La documentación oficial recoge despliegues con vLLM, SGLang, Ollama y MLX, además de una opción cloud vía API MaaS.

¿Es verdad que basta con 1,5 GB de VRAM para usarlo?

No es una cifra respaldada por la documentación oficial consultada. Las guías del proyecto hablan de escenarios de 8 GB para despliegues o fine-tuning ligeros, no de 1,5 GB como requisito verificado.