La carrera de la inteligencia artificial suele medirse en modelos más grandes, más parámetros y ventanas de contexto más largas. Sin embargo, en muchos casos el cuello de botella no está solo en el tamaño del modelo, sino en cómo guarda y recupera la información mientras responde. Ahí es donde Google Research sitúa ahora el foco con TurboQuant, una nueva técnica de compresión anunciada el 24 de marzo de 2026 con la que busca reducir de forma drástica el consumo de memoria asociado a la llamada caché clave-valor o caché KV, una pieza esencial en el funcionamiento de los grandes modelos de lenguaje.

La propuesta no se presenta como una simple optimización menor. Google sostiene que TurboQuant puede aliviar uno de los problemas más serios de la IA moderna: el coste de manejar vectores de alta dimensión, que son la base con la que los modelos representan palabras, imágenes, conceptos o fragmentos de contexto. Cuando esos vectores se multiplican a gran escala, también crecen la memoria necesaria, el coste de inferencia y las limitaciones para trabajar con contextos largos o con búsquedas semánticas masivas. En ese terreno, cualquier mejora puede tener impacto directo en rendimiento, coste y escalabilidad.

Por qué esta técnica importa más de lo que parece

Para entender la relevancia de TurboQuant conviene bajar un paso el nivel técnico. La caché KV funciona como una memoria rápida donde el modelo conserva información ya procesada para no recalcularla una y otra vez. Esa estrategia acelera la inferencia, pero también consume enormes cantidades de memoria cuando se trabaja con textos largos, asistentes conversacionales complejos o sistemas de búsqueda vectorial. Google plantea que el problema no es solo almacenar menos, sino hacerlo sin romper la precisión matemática que el sistema necesita para decidir a qué partes del contexto debe prestar atención.

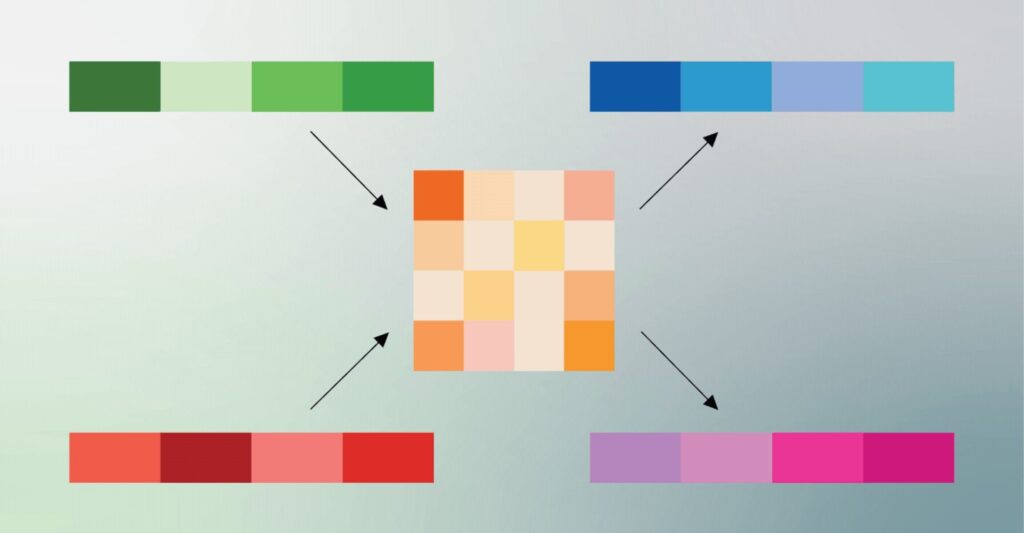

La novedad de TurboQuant está en cómo afronta la compresión. Según Google Research, el método combina dos fases. La primera, llamada PolarQuant, reorganiza los vectores mediante una rotación aleatoria y una representación polar que facilita su compresión sin el sobrecoste de memoria que arrastran otros enfoques clásicos. La segunda usa QJL, siglas de Quantized Johnson-Lindenstrauss, como una corrección de error de 1 bit sobre el residuo que deja la primera fase. El objetivo es reducir tamaño y, al mismo tiempo, evitar sesgos que deterioren la puntuación de atención del modelo.

Ese detalle es importante porque muchas técnicas de cuantización ganan eficiencia a costa de introducir un peaje oculto: necesitan almacenar constantes adicionales para reconstruir los datos con precisión, lo que resta parte del beneficio conseguido. Google sostiene que TurboQuant ataca precisamente ese punto débil. En otras palabras, no solo comprime, sino que intenta hacerlo sin cargar con demasiado equipaje extra. Sobre el papel, eso la convierte en una técnica interesante tanto para modelos generativos como para motores de búsqueda basados en vectores.

Los resultados que Google pone sobre la mesa

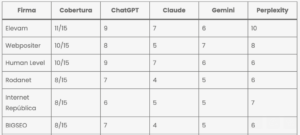

La compañía probó TurboQuant, PolarQuant y QJL en varios benchmarks de contexto largo, entre ellos LongBench, Needle In A Haystack, ZeroSCROLLS, RULER y L-Eval, utilizando modelos abiertos como Gemma y Mistral. En su entrada técnica, Google asegura que TurboQuant logra mantener resultados perfectos en pruebas de tipo “aguja en un pajar” al tiempo que reduce el tamaño de la memoria KV en al menos 6 veces. También afirma que, en aceleradores NVIDIA H100, una versión de 4 bits puede acelerar hasta 8 veces el cálculo de attention logits frente a claves no cuantizadas de 32 bits.

Ahora bien, el matiz importa. El mensaje divulgativo de Google habla de cuantizar la caché KV hasta 3 bits sin pérdida de precisión en sus pruebas, pero el resumen técnico del trabajo aceptado como póster en ICLR 2026 formula la mejora con algo más de cautela: habla de “neutralidad absoluta de calidad” en 3,5 bits por canal y de una degradación marginal en 2,5 bits por canal. No es una contradicción directa, porque el contexto experimental y la forma de medir pueden variar, pero sí una diferencia suficiente como para evitar titulares simplistas sobre una supuesta compresión milagrosa sin condiciones.

También hay otro elemento relevante: Google no enmarca TurboQuant solo como una mejora para Gemini o para los LLM. La compañía insiste en que estas técnicas pueden ser críticas para la búsqueda vectorial, es decir, para sistemas capaces de encontrar contenidos similares por significado y no solo por palabras clave. Eso afecta de lleno al presente de la IA empresarial, los asistentes con recuperación de información, los buscadores semánticos y las bases de datos vectoriales que se están convirtiendo en parte estructural de muchas aplicaciones modernas.

Más allá del laboratorio: ahorro, contexto largo y búsqueda semántica

La lectura de fondo es clara. En una industria obsesionada con escalar hardware, más memoria y más GPU, trabajos como este recuerdan que una parte del progreso puede venir de las matemáticas y los algoritmos, no solo de comprar más infraestructura. Si una técnica consigue reducir memoria, acelerar inferencia y mantener calidad suficiente, el efecto puede notarse en más usuarios concurrentes, contextos más amplios, despliegues más baratos y menores barreras para ejecutar modelos complejos.

Conviene, eso sí, mantener la prudencia habitual. TurboQuant ha sido presentado por Google Research y cuenta con respaldo teórico en el trabajo aceptado en ICLR 2026, mientras que PolarQuant figura en la programación de AISTATS 2026. Eso aporta solidez académica, pero no equivale automáticamente a una adopción inmediata y universal en todos los motores de inferencia, frameworks o bases de datos vectoriales del mercado. Como ocurre con muchas innovaciones en compresión, la distancia entre una buena idea en benchmarks y un despliegue industrial amplio puede depender de kernels, integración de software y compatibilidad con distintas arquitecturas.

Aun así, el movimiento merece atención. La investigación ha sido desarrollada por Google junto con colaboradores de Google DeepMind, KAIST y NYU, y apunta a una dirección cada vez más estratégica: hacer que la IA sea más eficiente sin degradar la experiencia final. En un momento en que la conversación pública gira casi siempre alrededor de modelos más grandes, TurboQuant recuerda que la siguiente ventaja competitiva puede estar en comprimir mejor, calcular más rápido y gastar menos memoria. Y eso, para cualquier actor que opere IA a gran escala, importa tanto como lanzar un modelo nuevo.

Preguntas frecuentes

¿Qué es TurboQuant y para qué sirve?

TurboQuant es una técnica de compresión presentada por Google Research para reducir el uso de memoria en modelos de IA y en sistemas de búsqueda vectorial. Su objetivo es aliviar el cuello de botella de la caché KV y acelerar operaciones sin perder demasiada precisión en el proceso.

¿Qué significa que comprima la caché KV de un modelo?

Significa que reduce el espacio que ocupa la memoria rápida donde un modelo guarda información ya procesada durante la inferencia. Eso puede ayudar a manejar contextos más largos, abaratar costes y mejorar velocidad, especialmente en modelos de lenguaje y asistentes avanzados.

¿TurboQuant ya se usa en Gemini o en productos comerciales de Google?

Google menciona a Gemini como uno de los grandes escenarios donde este tipo de cuantización puede ser útil, pero el anuncio de Research se centra en la aportación algorítmica y en los resultados experimentales. En las fuentes consultadas no se detalla un calendario público de despliegue comercial concreto.

¿Por qué esta tecnología también importa en buscadores y bases de datos vectoriales?

Porque la búsqueda semántica moderna trabaja con enormes volúmenes de vectores y necesita compararlos con rapidez y con un coste razonable. Google sostiene que TurboQuant puede construir y consultar índices vectoriales con muy poca memoria, casi sin tiempo de preprocesado y con una precisión competitiva frente a otros métodos.

vía: research.google