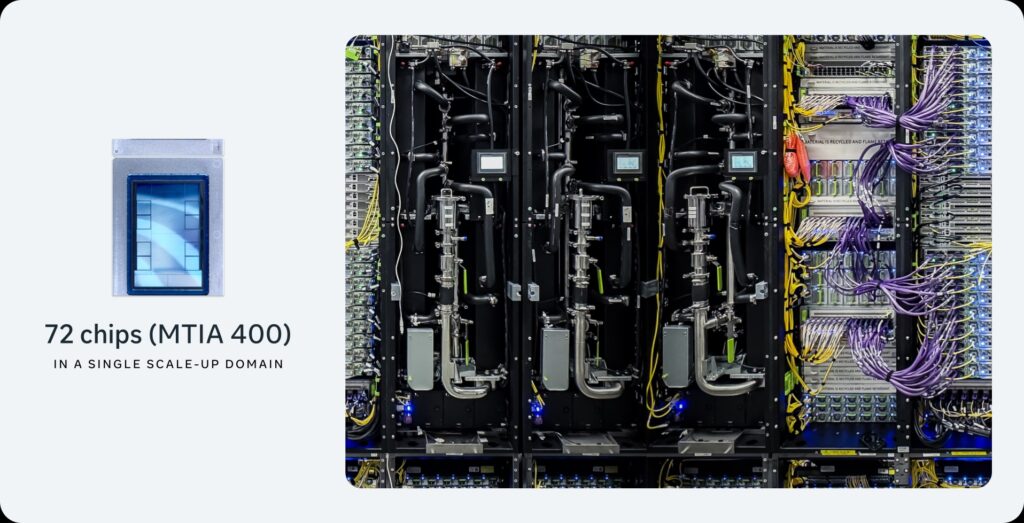

Meta ya no quiere que su infraestructura de IA dependa solo de la próxima GPU disponible. Con la presentación de las nuevas generaciones MTIA 300, 400, 450 y 500, la compañía deja claro que su estrategia pasa por construir una familia de aceleradores propios orientados cada vez más a un problema muy concreto: servir inferencia de IA a gran escala, con mejor coste por token y menos dependencia de hardware generalista.

La decisión no llega aislada. Google ya definió Ironwood como su primera TPU diseñada específicamente para la “era de la inferencia”, AWS sigue ampliando su hoja de ruta con Trainium3 e Inferentia, y Microsoft ha posicionado Maia 200 como su nueva plataforma de inferencia para Azure. Lo que se está dibujando no es una guerra frontal contra Nvidia en todos los frentes, sino algo más matizado y, probablemente, más profundo: una segmentación del cómputo de IA en la que las GPUs siguen dominando el entrenamiento frontier, mientras los hiperescalares diseñan silicio propio para absorber la parte más repetitiva, predecible y costosa de la inferencia.

Meta explica que MTIA —desarrollado en estrecha colaboración con Broadcom— ya se ha desplegado a escala de cientos de miles de chips y ha servido modelos internos de recomendación, ranking e incluso pruebas con LLMs como Llama. Pero el cambio importante está en la evolución reciente: de una línea inicialmente optimizada para ranking and recommendation a una familia claramente enfocada en GenAI inference.

La inferencia ya manda más que el entrenamiento en muchas cuentas

La tesis de Meta es muy concreta: los aceleradores generalistas, diseñados sobre todo para el preentrenamiento a gran escala, no siempre son la forma más eficiente de ejecutar inferencia generativa en producción. En su blog técnico, la compañía insiste en que el ancho de banda de la memoria HBM es uno de los factores más críticos para el rendimiento de inferencia, especialmente en fases como el decode. De ahí que MTIA 450 duplique el ancho de banda HBM frente a MTIA 400 y que MTIA 500 vuelva a subir otro 50 %, además de aumentar capacidad y optimizaciones de baja precisión.

Los números que aporta Meta ayudan a entender la magnitud del salto. Entre MTIA 300 y MTIA 500, la compañía afirma haber multiplicado por 4,5 el ancho de banda HBM y por 25 el rendimiento de cómputo en sus formatos orientados a inferencia. Según la tabla técnica publicada junto al anuncio, MTIA 300 ofrece 6,1 TB/s de ancho de banda HBM, MTIA 400 sube a 9,2 TB/s, MTIA 450 alcanza 18,4 TB/s y MTIA 500 llega a 27,6 TB/s, con entre 384 y 512 GB de HBM en esta última generación.

En otras palabras, Meta está diseñando chips pensando menos en el gran entrenamiento masivo y más en el problema económico del próximo ciclo de la IA: cómo servir millones o miles de millones de consultas diarias sin que el coste se dispare.

Cuatro generaciones, una misma idea: iterar más rápido que el mercado

Otro elemento diferencial de MTIA es la velocidad de desarrollo. Meta asegura que ha construido una capacidad interna para lanzar una nueva generación de chip aproximadamente cada seis meses, muy por debajo del ciclo clásico de uno o dos años que domina buena parte de la industria. Lo consigue apoyándose en una arquitectura modular de chiplets y en una fuerte reutilización de chasis, racks e infraestructura de red entre varias generaciones.

Eso significa que MTIA 400, 450 y 500 comparten la misma huella física a nivel de sistema, lo que permite insertar una nueva generación en el mismo entorno sin rediseñar por completo el centro de datos. Desde el punto de vista de una infraestructura de IA, esto tiene bastante valor: reduce fricción de despliegue y acorta el tiempo entre diseño de silicio y adopción real en producción.

La hoja de ruta también está claramente ordenada. MTIA 300 ya está en producción para entrenamiento de modelos de recomendación; MTIA 400 ha terminado pruebas en laboratorio y va camino del despliegue en centros de datos; MTIA 450 está previsto para despliegue masivo a principios de 2027; y MTIA 500 llegará más tarde ese mismo año, con más ancho de banda, más capacidad HBM y más rendimiento en formatos MX4.

El gran patrón del mercado: chips propios para inferencia, GPUs para entrenamiento

La estrategia de Meta encaja casi milimétricamente con lo que otros gigantes ya han empezado a hacer. Google Ironwood fue presentado como el primer TPU diseñado específicamente para inferencia, con 192 GB de HBM3E por chip y 7,37 TB/s de ancho de banda. AWS Trainium3 ofrece 144 GB de HBM3E y 4,9 TB/s, mientras que un Trn3 UltraServer puede escalar hasta 144 chips, 20,7 TB de HBM3E agregada y 706 TB/s de ancho de banda total. Microsoft Maia 200, por su parte, se define como un acelerador de inferencia construido en 3 nm, con 216 GB de HBM3E, 7 TB/s de ancho de banda y una mejora del 30 % en rendimiento por dólar frente a sistemas anteriores desplegados en Azure.

Visto en conjunto, el mensaje es difícil de ignorar: los hiperescalares ya no quieren pagar siempre la prima de una GPU de entrenamiento para ejecutar cargas de inferencia que son más estables, más repetitivas y mucho más sensibles al coste operativo. Eso no destrona a Nvidia, pero sí erosiona la idea de que toda la economía de la IA debe pasar inevitablemente por el mismo tipo de silicio. La inferencia se está convirtiendo en un mercado propio dentro de la infraestructura de IA.

El software importa casi tanto como el chip

Hay otro punto donde Meta parece haber aprendido de las limitaciones históricas del silicio propietario: el software stack. La compañía subraya que MTIA está construido de forma nativa sobre PyTorch, vLLM, Triton y estándares del Open Compute Project. En un entorno donde mover modelos entre plataformas es cada vez más valioso, esa compatibilidad es crucial. Cuanto más fácil sea portar modelos, kernels y sistemas de serving, más viable será que una organización reduzca parte de su dependencia de CUDA como capa casi única.

No es casual que Google también haya añadido soporte de vLLM para TPU en beta, o que AWS mantenga su ecosistema Neuron alineado con frameworks ampliamente usados como PyTorch. La guerra del silicio ya no se gana solo con FLOPS o ancho de banda: también se gana con portabilidad, compiladores y facilidad de adopción.

Meta no está diciendo que vaya a reemplazar sus clusters GPU con MTIA en todos los casos. Lo que está diciendo es algo más importante para entender el mercado de aquí a 2027: que la inferencia masiva, especialmente en asistentes, recomendaciones, feeds, anuncios y futuros agentes de IA, merece una infraestructura específica. Y que esa infraestructura ya no tiene por qué ser una GPU pensada ante todo para entrenar modelos frontier.

Preguntas frecuentes

¿Qué ha anunciado exactamente Meta con MTIA?

Meta ha detallado cuatro generaciones de su familia de aceleradores propios —MTIA 300, 400, 450 y 500— con despliegues en producción o previstos entre 2026 y 2027, cada vez más orientados a inferencia de IA generativa.

¿Por qué Meta pone tanto foco en la memoria HBM?

Porque, según su explicación técnica, el ancho de banda HBM es uno de los factores más críticos para el rendimiento de inferencia, especialmente en el decode y en cargas GenAI a gran escala.

¿Meta quiere sustituir a Nvidia con MTIA?

No de forma total. La estrategia apunta más a segmentar cargas: usar chips propios para inferencia de alto volumen y mantener GPUs para entrenamiento frontier y otros usos más generalistas.

¿Qué otros hiperescalares siguen esta misma dirección?

Google con Ironwood, AWS con Trainium3 e Inferentia, y Microsoft con Maia 200 también están reforzando sus aceleradores propios para cargas de inferencia.

vía: Noticias Cloud