Desde su lanzamiento en otoño pasado, la GPU NVIDIA H100 Tensor Core ha sido identificada como la GPU más potente del mundo para la Inteligencia Artificial (IA). Esta reconocida posición ha llevado a NVIDIA y sus socios a desarrollar nuevos productos y servicios en torno a esta tecnología para atender la creciente demanda de entrenamiento e inferencia de IA generativa.

En su discurso inaugural en el GTC NVIDIA, Jensen Huang, fundador y CEO de la compañía, anunció que las supercomputadoras NVIDIA DGX H100 estaban comenzando a producirse para ser distribuidas a empresas en todo el mundo. Huang destacó que «la IA generativa está inspirando a casi todas las industrias a reinventar sus estrategias comerciales y la tecnología necesaria para lograrlas».

La Arquitectura Hopper en el Corazón de la Revolución de la IA

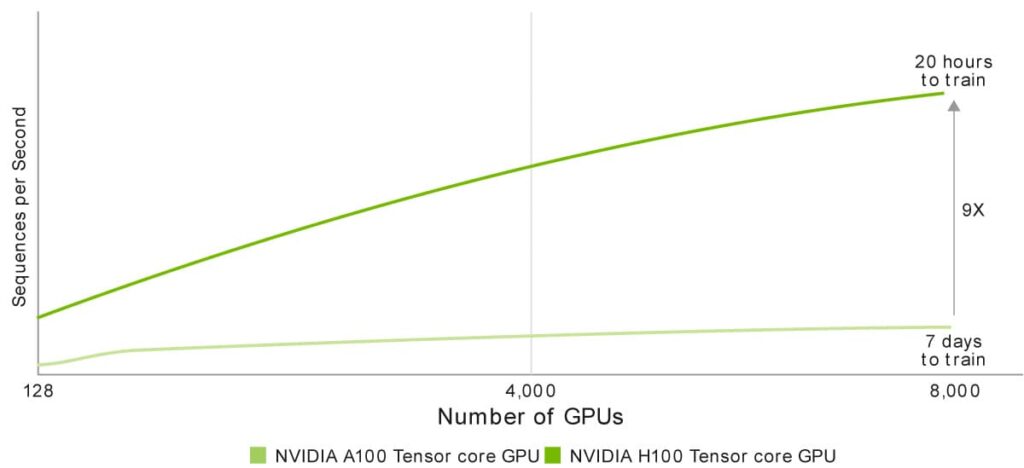

La GPU H100, basada en la arquitectura informática NVIDIA Hopper, se diseñó específicamente para el desarrollo, entrenamiento e implementación de IA generativa, modelos de lenguaje extenso (LLM) y sistemas de recomendación. Esta tecnología, impulsada por la precisión FP8 de la H100, permite un entrenamiento de IA 9 veces más rápido y una inferencia de IA hasta 30 veces más rápida en LLM en comparación con su predecesora, la A100.

Los sistemas NVIDIA DGX H100, equipados con hasta 8 GPUs H100 y conectados mediante NVIDIA NVLink e integrando redes NVIDIA Quantum InfiniBand y Spectrum Ethernet, ofrecen hasta 32 petaflops de rendimiento informático con precisión FP8. Así, son capaces de procesar grandes cargas de trabajo de IA con una eficiencia energética óptima.

Adopción de H100 por Pioneros en IA Generativa

OpenAI, Meta, Stability AI, Twelve Labs y Anlatan, son solo algunos de los pioneros en IA generativa que han adoptado las GPUs H100 para acelerar sus trabajos. Desde entrenar y ejecutar sistemas de diálogo de IA como ChatGPT de OpenAI hasta acelerar la inferencia de modelos recomendadores de aprendizaje profundo y la comprensión de contenido en el sistema Grand Teton de Meta, la H100 está impulsando la próxima generación de la IA.

NVIDIA H100 Hopper: rendimiento, escalabilidad y seguridad sin precedentes

La GPU H100 Tensor Core de NVIDIA, con su arquitectura Hopper, ofrece un rendimiento hasta 30 veces más rápido y eficiente que las GPUs de generación anterior.

Características destacadas de las GPUs NVIDIA H100 Hopper

Las GPUs H100 presentan Tensor Cores de cuarta generación y Transformer Engine con precisión FP8 que proporcionan un entrenamiento de IA hasta 9 veces más rápido. A nivel de infraestructura, ofrecen una escalabilidad eficiente desde pequeñas empresas hasta clústeres de GPU unificados y masivos gracias a la combinación de NVlink de cuarta generación, NVLINK Switch System y PCIe Gen5.

El rendimiento de inferencia de IA puede ser hasta 30 veces superior en los modelos más grandes, gracias a la tecnología MIG (Multi-Instance GPU), que permite una división flexible y eficiente de la GPU para maximizar la utilización y brindar inferencias más rápidas y de alta calidad.

Además, las GPUs H100 presentan la innovadora tecnología de encriptación de memoria a nivel de hardware NVIDIA H100 Infinity Guard, proporcionando una seguridad de datos líder en la industria. Esta encriptación en tiempo real no compromete el rendimiento, lo que ofrece un equilibrio perfecto entre seguridad y rendimiento.

Otra ventaja de las GPUs H100 es el soporte para programación en CUDA 12, lo que permite a los desarrolladores aprovechar al máximo las capacidades de las GPUs Hopper y mejorar aún más el rendimiento y la eficiencia.

En términos de capacidad de memoria, las GPUs NVIDIA H100 ofrecen hasta 80 GB de memoria HBM3 por GPU, con una velocidad de transferencia de 3 TB/s, lo que permite un procesamiento de datos extremadamente rápido y eficiente.

Finalmente, las GPUs H100 están diseñadas para ser compatibles con los servidores de data center más modernos y pueden ser fácilmente integradas en infraestructuras existentes, proporcionando una transición fluida y rentable hacia las capacidades de IA de última generación.

La llegada de las GPUs NVIDIA H100 Hopper no solo marca un gran paso adelante en la tecnología de IA, sino que también brinda a las empresas de todos los tamaños la oportunidad de avanzar en la adopción y la implementación de soluciones de IA. En resumen, la GPU H100 está allanando el camino para el futuro de la IA y el aprendizaje automático, abriendo un sinfín de posibilidades para los desarrolladores y las empresas.

Comparativa entre las NVIDIA GPU A100 y NVIDIA GPU H100

| Características | A100 NVLink | A100 PCIe | H100 SXM | H100 PCIe |

|---|---|---|---|---|

| FP64 | 9,7 TF | 9,7 TF | 30 TF | 24 TF |

| Tensor Core FP64 | 19,5 TF | 19,5 TF | 60 TF | 48 TF |

| FP32 | 19,5 TF | 19,5 TF | 60 TF | 48 TF |

| Tensor Core FP32 | 156 TF | 312 TF** | 156 TF | 312 TF** | 1000 TF* | 800 TF* |

| Tensor Core BFLOAT16 | 312 TF | 624 TF** | 312 TF | 624 TF** | 2000 TF* | 1600 TF* |

| Tensor Core FP16 | 312 TF | 624 TF** | 312 TF | 624 TF** | 2000 TF* | 1600 TF* |

| Tensor Core FP8 | 4000 teraFLOPS* | 3200 teraFLOPS* | ||

| Tensor Core INT8 | 624 TOPS | 1.248 TOPS** | 624 TOPS | 1.248 TOPS** | 4.000 TOPS* | 3.200 TOPS* |

| Memoria GPU | 40 GB | 80 GB | 40 GB | 80GB | 80GB |

| Ancho de banda de memoria GPU | 1.555 GB/s | 2.039 GB/s | 1.555 GB/s | 3TB/S | 2TB/s |

| Decodificadores | 7 NVDEC 7 JPEG | 7 NVDEC 7 JPEG | ||

| Potencia máxima de diseño térmico (TDP) | 400 W | 250 W | 700 W | 350 W |

| GPU de múltiples instancias | Varios tamaños de instancia con hasta 7 MIG a 10 GB | Varios tamaños de instancia con hasta 7 MIG a 5 GB | Hasta 7 MIGS de 10 GB cada uno | |

| Formato | ;4/8 SXM en NVIDIA HGX | PCIe | SXM | PCIe de doble ranura refrigerado por aire |

| Interconexión | NVLink: 600 GB/s PCIe 4.0: 64 GB/s | NVLink: 600 GB/s PCIe 4.0: 64 GB/s | NVLink: 900 GB/s PCIe 5.0: 128 GB/s | NVLINK: 600 GB/s PCIe 5.0: 128 GB/s |

| Opciones del servidor | NVIDIA HGX H100 Partner y NVIDIA-Certified Systems con 4 u 8 GPU NVIDIA DGX H100 con 8 GPU | Sistemas certificados por NVIDIA y partners con 1 a 8 GPU |