Durante años, la mayoría de asistentes de voz han funcionado como un walkie-talkie educado: tú hablas, el sistema espera; luego responde, y tú vuelves a esperar. Ese “turn-taking” (turnos rígidos) es cómodo para las máquinas… pero poco natural para las personas. La novedad de PersonaPlex-7B es que rompe esa regla: es un modelo de voz “full-duplex”, capaz de escuchar y hablar simultáneamente, gestionando interrupciones, solapamientos y cambios de ritmo sin pausas artificiales.

Qué es exactamente PersonaPlex-7B (y por qué suena diferente)

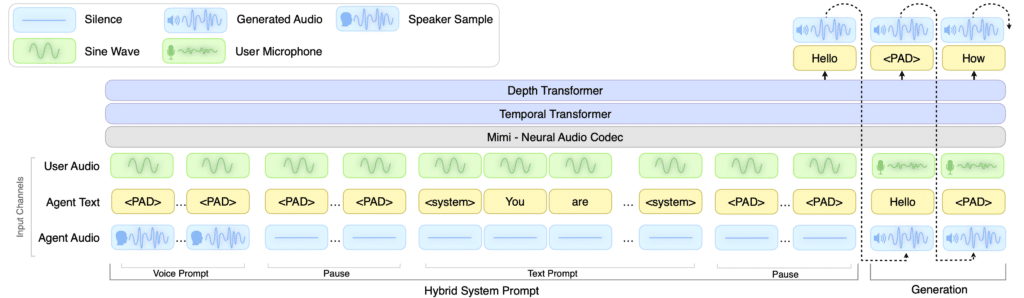

PersonaPlex se describe como un modelo speech-to-speech en tiempo real: recibe audio entrante, lo codifica de forma incremental y, al mismo tiempo, va generando audio saliente con baja latencia. En su bucle de inferencia no solo “transcribe y contesta”, sino que mantiene conversación con dinámica humana: barge-in (interrumpir), overlaps (hablar a la vez) y turnos rápidos.

Además, añade un ingrediente clave para producto: control de “persona” y de voz con dos prompts:

- Voice prompt: una secuencia de tokens de audio que fija características vocales y estilo.

- Text prompt: define rol, contexto y rasgos de personalidad para guiar el contenido.

En otras palabras: no es solo “voz”, es voz + comportamiento.

Full-duplex vs asistentes de voz tradicionales (tabla rápida)

| Lo que notas como usuario | Asistente típico (half-duplex) | PersonaPlex (full-duplex) |

|---|---|---|

| Interrupciones | Se “rompe”, ignora o corta raro | Admite interrupciones y reacciona |

| Pausas | Silencios obligatorios entre turnos | Conversación más continua |

| Solapamientos | Generalmente no | Puede manejar overlaps |

| Sensación | “Robot por turnos” | Más parecido a una llamada real |

Qué hay debajo del capó (en claro, sin humo)

En la ficha del modelo se indica que PersonaPlex es un Transformer de 7.000 millones de parámetros (7B) y que se basa en la arquitectura Moshi, con un pipeline de códec neuronal: Mimi Speech Encoder/Decoder y un transformador temporal/profundidad.

A nivel práctico, esto importa por dos cosas:

- No trabaja con “texto primero” como paso obligatorio. Puede predecir tokens de texto y de audio de forma autoregresiva para hablar fluido.

- Opera con audio a 24 kHz, pensado para calidad conversacional razonable en tiempo real.

Benchmarks: dónde presume (y con qué métricas)

NVIDIA publica resultados en FullDuplexBench, un benchmark público para evaluar dinámica conversacional full-duplex. Entre los valores reportados aparecen métricas de turn-taking e interrupciones (TOR), latencias y similitud de voz (SSIM con WavLM) en escenarios de interrupción del usuario.

Sin entrar en “guerra de números” (porque cada stack de audio cambia el resultado), la lectura útil para equipos de producto es: la evaluación ya no es solo WER o MOS, sino cómo de bien se comporta el agente cuando la conversación se vuelve humana (caótica).

Licencia y “open source”: lo que conviene matizar

Aquí es donde mucha gente se confunde con el titular fácil:

- El código del repositorio está bajo licencia MIT.

- Los pesos (weights) se distribuyen bajo el NVIDIA Open Model License Agreement (y la ficha menciona información adicional CC-BY-4.0).

Traducción: tienes código abierto, y un modelo con licencia abierta “usable”, pero no es lo mismo que “OSI-approved para todo”. Para un uso comercial serio, toca leer condiciones.

Cómo probarlo (la versión sysadmin-friendly)

El repo oficial describe un camino bastante directo, con dos puntos típicos de “audio en Linux”:

- Instalar dependencias del códec Opus (ej. en Debian/Ubuntu

libopus-dev). - Instalar el paquete (

pip install moshi/.). - Aceptar la licencia del modelo en Hugging Face y exportar

HF_TOKEN. - Levantar servidor (

python -m moshi.server ...) con opción de CPU offload si falta VRAM.

También incluyen ejecución “offline” para procesar WAV de entrada y generar WAV de salida (útil para pruebas reproducibles).

Dónde encaja (casos reales que sí piden full-duplex)

- Contact centers: interrupciones naturales (“perdona, una cosa…”) sin que el bot se quede colgado.

- Asistentes embebidos (vehículo/IoT): conversaciones cortas, rápidas, con ruido y cambios de intención.

- Copilotos de productividad: cuando el usuario piensa en voz alta y corrige sobre la marcha.

- Juegos / NPCs: diálogos con “timing” creíble (backchannels, confirmaciones rápidas).

Los “peros” inevitables (para no vender humo)

Un modelo full-duplex no se evalúa solo por lo que responde, sino por cómo convive con el audio del mundo real:

- Echo cancellation y acústica: si tu pipeline mezcla micro+altavoz sin AEC decente, el modelo puede “pelearse” con el entorno.

- Latencia de extremo a extremo: no basta con latencia del modelo; importan códec, I/O, buffering, WebRTC, etc.

- Seguridad: voz + persona controlable implica riesgo de suplantación si se diseña mal el producto (no es un problema “del paper”, es del despliegue).

FAQ

¿Qué significa “full-duplex” en un asistente de voz?

Que el sistema puede escuchar mientras habla, permitiendo interrupciones y solapamientos como en una conversación real.

¿Necesito GPU sí o sí?

La ficha del modelo está orientada a sistemas acelerados por NVIDIA (se mencionan compatibilidades como Ampere/Hopper), pero el repo contempla CPU offload si falta memoria de GPU, a costa de rendimiento.

¿Es realmente “gratis y open source”?

El código es MIT, pero los pesos tienen su propia licencia (NVIDIA Open Model License). “Gratis” y “abierto” puede ser cierto en la práctica, pero conviene revisar términos si hay uso comercial.

¿Cómo se controla la voz y la personalidad?

Con dos prompts: uno de voz (audio tokens) para el timbre/estilo, y uno de texto para la persona/rol y el contexto conversacional.

Referencias: huggingface.co, github y research.nvidia