La promesa de los agentes de Inteligencia Artificial lleva meses repitiéndose en presentaciones y hojas de ruta: menos chat, más acción. Menos “resúmeme esto”, más “hazlo por mí”. En ese terreno —el de los asistentes que no solo responden, sino que ejecutan tareas y conectan herramientas— aparece Sentient, un proyecto open source y autoalojable que se presenta como “un asistente personal para todos” y como un primer paso hacia agentes autónomos capaces de automatizar el trabajo repetitivo.

Según la descripción pública del repositorio, Sentient se plantea como un “centro de mando”: un lugar único donde el usuario define objetivos y el sistema los traduce en acciones, sin depender de prompts largos ni de flujos manuales. El planteamiento encaja con una tendencia clara del mercado: la transición desde asistentes generalistas hacia orquestadores que combinan conversación, memoria, conectores y ejecución de tareas.

Qué propone Sentient: conversación, memoria y tareas “de verdad”

El proyecto describe un conjunto de capacidades que, en la práctica, apuntan a un asistente con tres pilares:

- Chat por texto y voz, como interfaz principal para consultar, planificar o pedir acciones.

- Memoria: el sistema dice poder aprender preferencias, hábitos y objetivos para personalizar respuestas y comportamientos con el tiempo.

- Automatización y workflows: incluye una sección de “Tasks” para manejar tareas recurrentes, programadas, disparadas por eventos o en modo “swarm” (enfoque multiagente).

Es un detalle relevante: muchos asistentes se quedan en el “copiloto” (te acompaño), mientras que aquí se insiste en “te quito trabajo” con flujos que se repiten y que no deberían requerir intervención constante del usuario.

Integraciones: el punto donde los agentes se juegan la credibilidad

Sentient también afirma soportar más de 20 aplicaciones para integrarse con las herramientas que ya se usan a diario. En el mundo real, este es el verdadero cuello de botella: un asistente puede ser brillante conversando, pero si no tiene conectores fiables (y permisos bien gestionados) acaba siendo un “chat bonito” con poco impacto operativo.

En esa misma línea, el proyecto habla de leer email y calendario para sugerir horarios y recordar eventos importantes. En términos de valor práctico, es exactamente el tipo de función que convierte un asistente en algo útil… o en un problema, si la seguridad y la gobernanza no están bien resueltas.

Privacidad y control: autoalojable como declaración de intenciones

Uno de los puntos más llamativos es la apuesta por el autoalojamiento: Sentient se define como una plataforma que puede ejecutarse localmente para que los datos del usuario “se queden en casa”. En 2025, con empresas y profesionales cada vez más sensibles a fugas de información, esto no es un detalle menor: es una postura.

Ahora bien, autoalojable no significa automáticamente “seguro”. Significa más control (y también más responsabilidad): actualizaciones, hardening, control de accesos, auditoría, copias de seguridad y, sobre todo, gestión de secretos (tokens de APIs, credenciales de correo, permisos sobre servicios internos). Si el asistente se conecta a “todo”, la pregunta obvia es: ¿qué pasa si alguien compromete ese “todo”?

La letra pequeña para empresas: licencia AGPL

Otro elemento a tener en cuenta es la licencia GNU AGPL. En entornos corporativos, esta licencia suele activar conversaciones jurídicas y de producto: si una empresa modifica y ofrece el software como servicio, la AGPL puede obligar a publicar esas modificaciones bajo los términos de la licencia. Para startups y equipos internos, esto puede ser perfecto (colaboración y transparencia) o un freno (si el plan es convertirlo en producto cerrado sin abrir cambios).

En otras palabras: Sentient no solo compite por funcionalidad, también define el terreno ideológico y legal en el que quiere jugar.

Por qué este tipo de proyectos está creciendo ahora

Sentient aparece en un momento donde los “agentes” dejan de ser una promesa abstracta y empiezan a tomar forma como productos con:

- Ejecución de tareas multi-etapa (no una sola acción).

- Contexto organizacional o personal (memoria).

- Conectores a herramientas reales.

- Interfaz conversacional como capa de control.

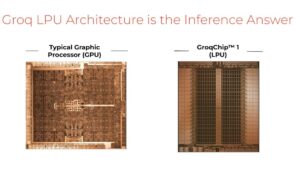

La idea de un “asistente personal” vuelve a sonar creíble por una razón simple: hoy existe un ecosistema de modelos, frameworks y runtimes capaz de sostenerlo. La batalla ya no es solo “quién responde mejor”, sino quién integra mejor sin romper la seguridad, sin disparar los costes y sin volver loco al usuario con configuración.

El reto real: pasar del “demo” al hábito diario

Si Sentient quiere ser algo más que un repositorio prometedor, tendrá que ganar en tres frentes que separan el prototipo del producto:

- Fiabilidad: automatizar sin generar “sorpresas”.

- Permisos y auditoría: que el usuario sepa qué puede hacer el asistente, cuándo lo hizo y por qué.

- Experiencia de uso: que crear tareas recurrentes y flujos multiagente sea más fácil que seguir haciéndolo manualmente.

Ahí es donde se decide si los agentes “se quedan” o vuelven a ser una moda.

Preguntas frecuentes

¿Qué significa que Sentient sea autoalojable y “local”?

Que, según su planteamiento, puede ejecutarse en infraestructura propia para reducir la dependencia de servicios externos y mantener mayor control sobre los datos y credenciales.

¿Qué riesgos de seguridad tiene un asistente que se integra con email, calendario y apps?

El principal riesgo es la concentración de permisos: si el sistema almacena tokens y accesos a varias herramientas, se convierte en un objetivo de alto valor. Es clave aplicar mínimos privilegios, rotación de credenciales y auditoría.

¿Qué implica la licencia AGPL para una empresa que quiera usarlo internamente?

Normalmente, el uso interno no es el problema. El punto sensible suele aparecer si se modifica el software y se ofrece como servicio a terceros: la AGPL puede exigir publicar las modificaciones.

¿En qué se diferencia un “agente” de un chatbot clásico?

Un chatbot responde. Un agente, además, planifica y ejecuta acciones (a menudo en varios pasos), usando herramientas externas e integraciones para completar un objetivo.