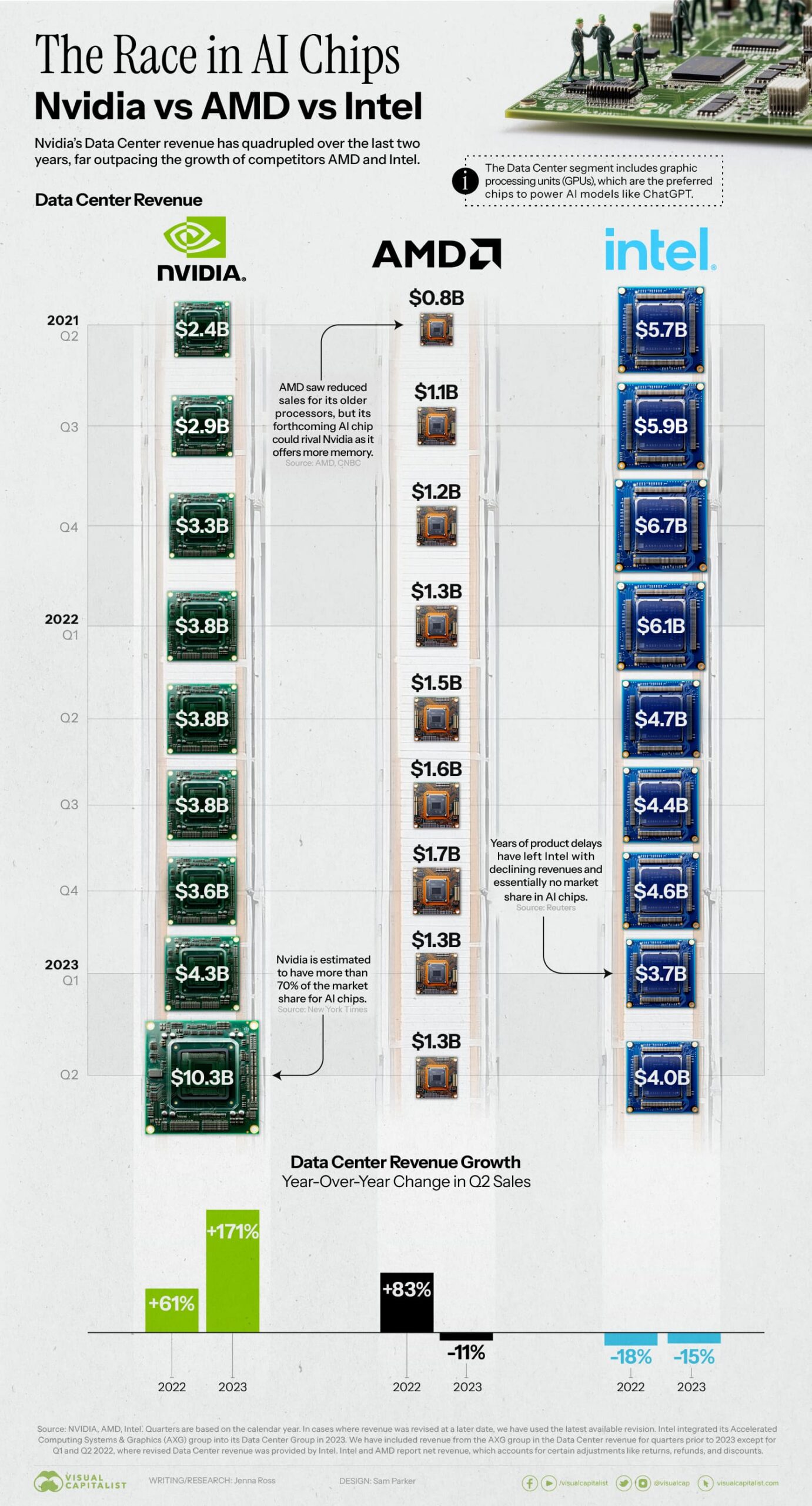

Nvidia ha emergido como un ganador temprano en el auge de la IA generativa. La compañía informó ingresos récord en su informe de ganancias del segundo trimestre, y las ventas de chips para IA jugaron un papel importante en esto. Pero, ¿cómo se comparan las ventas de chips para IA de Nvidia con las de sus competidores estadounidenses AMD e Intel?

Utilizamos informes de ganancias de cada empresa para examinar su evolución en ingresos a lo largo del tiempo.

Un líder claro sale a la luz

Aunque las compañías no informan ingresos específicos para sus chips de IA, sí comparten ingresos para su segmento de Centros de Datos, que incluye Unidades de Procesamiento Central (CPU), Unidades de Procesamiento de Datos (DPU) y Unidades de Procesamiento Gráfico (GPU). Estas últimas son las preferidas para la IA, ya que pueden realizar muchas tareas simples de forma simultánea y eficiente.

Ingresos trimestrales del segmento de Centros de Datos

| Empresa | Q2 2021 | Q3 2021 | Q4 2021 | Q1 2022 | Q2 2022 | Q3 2022 | Q4 2022 | Q1 2023 | Q2 2023 |

|---|---|---|---|---|---|---|---|---|---|

| Nvidia | $2.4B | $2.9B | $3.3B | $3.8B | $3.8B | $3.8B | $3.6B | $4.3B | $10.3B |

| AMD | $0.8B | $1.1B | $1.2B | $1.3B | $1.5B | $1.6B | $1.7B | $1.3B | $1.3B |

| Intel | $5.7B | $5.9B | $6.7B | $6.1B | $4.7B | $4.4B | $4.6B | $3.7B | $4.0B |

Nvidia ha cuadruplicado sus ingresos del segmento de Centros de Datos en los últimos dos años y se estima que tiene más del 70% de la cuota de mercado para chips de IA.

Competencia entre Nvidia, AMD e Intel

AMD: Un Contendiente en Ascenso

AMD ha visto un crecimiento más lento en comparación con Nvidia. Sin embargo, la empresa recientemente ha mostrado un mayor enfoque en IA, anunciando su nuevo chip MI300X con 192 GB de memoria, comparado con los 141 GB del nuevo chip GH200 de Nvidia. Más memoria podría hacer de AMD un competidor más fuerte en el espacio de la IA.

Intel: En Busca de un Cambio

Intel ha experimentado una disminución en sus ingresos anuales y tiene prácticamente ninguna participación en el mercado de chips de IA. Su procesador Sapphire Rapids ha enfrentado retrasos debido a un diseño complejo y múltiples fallos.

Perspectivas Futuras

Todas las empresas planean ampliar sus ofertas de IA. Y no es difícil ver por qué: se informa que ChatGPT funciona en 10,000 chips Nvidia A100, lo que representaría un costo total de alrededor de $100 millones.

A medida que se desarrollen más modelos de IA, la infraestructura que los respalda se convertirá en una gran oportunidad de ingresos.

Infografía de Visual Capitalist.