La suspensión repentina de más de 60 cuentas de Claude en la fintech argentina Belo ha puesto sobre la mesa un problema que muchas empresas prefieren no mirar de frente: la dependencia operativa de un único proveedor de Inteligencia Artificial. El episodio, denunciado públicamente por Patricio “Pato” Molina, CTO de Belo, mostró hasta qué punto una decisión automática de un proveedor puede bloquear durante horas flujos de trabajo enteros, historiales de conversación, integraciones y procesos internos sobre los que ya descansa buena parte del día a día de un equipo.

Según relató Molina, Anthropic revocó el acceso de toda la organización a Claude sin previo aviso y con una explicación genérica vinculada a una supuesta infracción de la política de uso. La única vía de recurso que recibió la empresa fue un formulario de apelación. Horas después, el acceso fue restablecido y el propio directivo explicó que, aparentemente, se había tratado de un falso positivo. Distintos medios sitúan la interrupción en algo más de 15 horas, tiempo suficiente para convertir una incidencia de soporte en una advertencia seria sobre continuidad operativa.

Un corte de servicio que afectó a una empresa entera

Lo que convierte este caso en algo más que una anécdota viral no es solo el bloqueo, sino el modo en que se produjo. El mensaje enviado por Anthropic, reproducido por varios medios a partir de la captura compartida por Molina, indicaba que los sistemas automáticos habían detectado “un alto volumen de señales” asociado a la cuenta que violaba la política de uso, y añadía que esas señales habían sido revisadas por el equipo para validar el hallazgo antes de revocar el acceso. El problema es que Belo aseguró no haber recibido detalles concretos sobre qué norma se había incumplido, ni un canal humano claro para resolver una incidencia con impacto empresarial inmediato.

Ese punto resulta especialmente delicado porque Anthropic sí mantiene una página oficial de ayuda donde explica que las cuentas pueden ser suspendidas o canceladas por violaciones repetidas de la política de uso, creación desde ubicaciones no admitidas o incumplimientos de los términos del servicio. La misma página remite a un formulario de apelación cuando un usuario considera que la suspensión es errónea. Es decir, el formulario no fue una anomalía del caso Belo, sino parte del procedimiento documentado por la propia compañía.

La diferencia entre un proceso aceptable y uno problemático está en la escala del daño. Cuando la suspensión afecta a un usuario individual, el perjuicio puede ser importante pero acotado. Cuando el corte paraliza a una organización completa que usa el servicio en tareas críticas, la lógica cambia. En el caso de Belo, Molina sostuvo que más de 60 personas se quedaron sin una herramienta central para su trabajo diario y que cambiar deprisa a otra plataforma no era trivial, porque eso implicaba perder contexto acumulado, reconfigurar flujos e interrumpir procesos integrados.

El verdadero debate no es Anthropic, sino la fragilidad del modelo

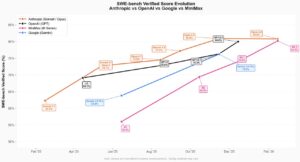

La lección de fondo va más allá de Anthropic. El propio Molina resumió el episodio con una frase que se ha repetido en toda la industria: no conviene poner todos los huevos en la misma cesta. La observación puede sonar obvia, pero en la práctica muchas empresas están haciendo justo eso con sus herramientas de IA. A medida que modelos como Claude, ChatGPT o Gemini se vuelven más útiles para programación, automatización, análisis y trabajo colaborativo, las organizaciones tienden a integrarlos cada vez más a fondo en sus procesos. El problema es que esa integración multiplica el coste de un corte repentino.

La crítica que ha circulado estos días en redes y medios especializados tampoco se centra solo en el falso positivo. Varias reacciones han puesto el foco en otra cuestión: que una decisión de alto impacto, como bloquear a una empresa entera, pueda ejecutarse con poca transparencia y con una vía de apelación limitada a un formulario estándar. Esa combinación alimenta una sensación cada vez más extendida entre desarrolladores y compañías: la IA puede ser una capa estratégica del negocio, pero sigue dependiendo de proveedores que conservan un poder casi unilateral sobre el acceso al servicio.

De hecho, el caso Belo llega en un momento en que Anthropic ya estaba sometida a escrutinio por otros cambios recientes en sus mecanismos de control y verificación. Business Insider informó hace pocos días de que la compañía ha empezado a pedir verificación de identidad a algunos usuarios cuyo comportamiento le parece potencialmente fraudulento o abusivo, y recordó que ese proceso puede terminar en veto de la cuenta si se confirma una infracción. No es el mismo caso, pero sí forma parte del mismo debate: el equilibrio entre seguridad, lucha contra el abuso y derechos básicos de quienes dependen del servicio para trabajar.

De la fascinación por la IA a la gestión del riesgo proveedor

El episodio también reabre una discusión más amplia sobre arquitectura tecnológica. Muchas empresas han asumido que diversificar proveedores de nube, identidad o conectividad es una práctica razonable de continuidad de negocio. Sin embargo, no siempre están aplicando esa misma lógica a la IA generativa. En teoría, mantener varias plataformas activas añade costes, complejidad operativa y necesidad de formación. En la práctica, puede convertirse en una póliza de seguro frente a cortes, cambios unilaterales de condiciones o errores de clasificación. Eso fue precisamente lo que deslizó Molina al explicar que Belo también disponía de Gemini, aunque el cambio no era inmediato ni gratuito en términos de contexto e integración.

Hay otra derivada que conviene no pasar por alto. Anthropic mantiene una fuerte expansión comercial y tecnológica: la compañía afirmó esta misma semana que ya hay más de 100.000 clientes ejecutando Claude en Amazon Bedrock, una cifra que muestra hasta qué punto su tecnología está entrando en entornos corporativos y flujos críticos. Cuanto más profunda sea esa adopción, mayor será la exigencia de que las salvaguardas automáticas, los procesos de revisión y los canales de apelación estén a la altura del impacto real que pueden provocar.

En el fondo, el caso Belo no demuestra que Claude sea una mala herramienta ni que Anthropic actúe siempre de forma errónea. Lo que sí demuestra es algo mucho más incómodo: que la empresa moderna está empezando a tratar la IA como infraestructura, mientras muchos proveedores todavía la gestionan con mecanismos de control y soporte que recuerdan más a un producto de consumo que a un servicio del que pueden depender decenas de empleados al mismo tiempo. Esa distancia entre valor estratégico y fragilidad operativa es, probablemente, la noticia más importante de todo el episodio.

Preguntas frecuentes

¿Qué le ocurrió exactamente a Belo con Claude?

La fintech argentina Belo denunció que Anthropic revocó el acceso de toda su organización a Claude, afectando a más de 60 cuentas, sin una explicación concreta más allá de una supuesta infracción de la política de uso. Horas después, el acceso fue restaurado y la empresa habló de un falso positivo.

¿Cuál era la única vía de recurso que recibió la empresa?

Según el mensaje compartido públicamente por Patricio Molina y según la ayuda oficial de Anthropic, la vía para recurrir una suspensión era rellenar un formulario de apelación del equipo de salvaguardas.

¿Qué razones reconoce Anthropic para suspender una cuenta de Claude?

Anthropic indica en su centro de ayuda que puede vetar cuentas por violaciones repetidas de su política de uso, creación de cuenta desde ubicaciones no admitidas o incumplimientos de sus términos del servicio.

¿Qué lección deja este caso para empresas que usan IA en procesos críticos?

La principal lección es de continuidad operativa: depender de un solo proveedor de IA puede convertirse en un riesgo empresarial si esa plataforma concentra historiales, integraciones y flujos esenciales. El caso Belo ha reforzado la idea de que conviene tener alternativas o planes de contingencia.