Las empresas en el ámbito de los modelos fundacionales están volviéndose menos transparentes, según Rishi Bommasani, líder de la Sociedad en el Centro de Investigación sobre Modelos Fundacionales (CRFM) de Stanford HAI. Sorprendentemente, OpenAI, cuyo nombre lleva la palabra “open”, ha afirmado claramente que no será transparente en la mayoría de aspectos de su modelo estrella, GPT-4.

Esta falta de transparencia dificulta que empresas, académicos, legisladores y consumidores comprendan, confíen y trabajen con modelos fundacionales comerciales. Ante este desafío, Bommasani y el director del CRFM, Percy Liang, formaron un equipo multidisciplinario de Stanford, MIT y Princeton para crear un sistema de puntuación denominado Índice de Transparencia en Modelos Fundacionales (FMTI).

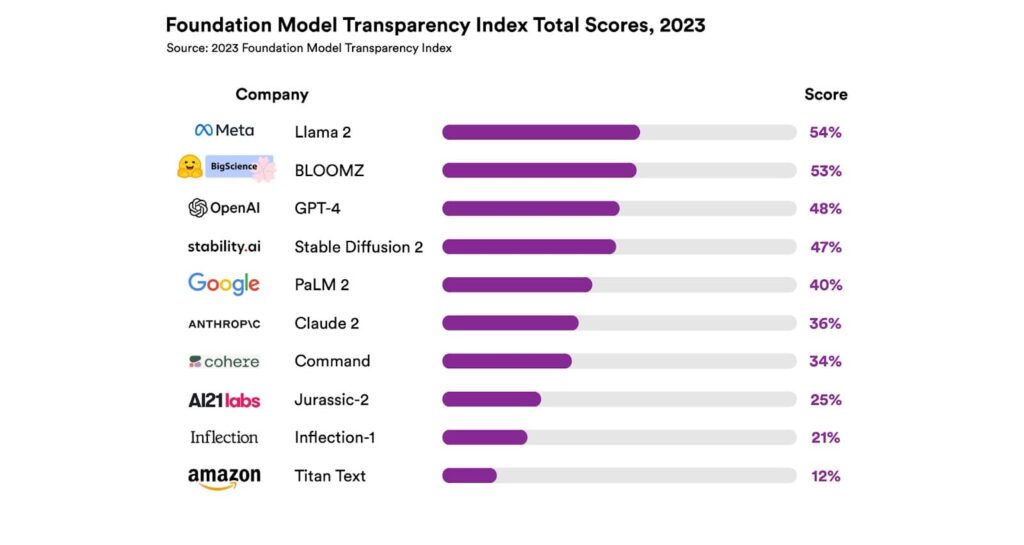

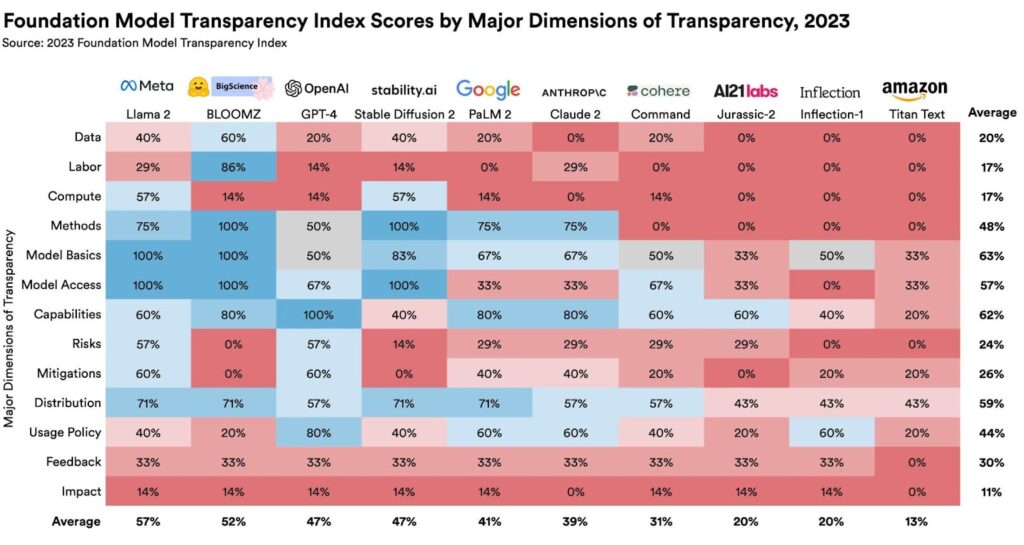

El FMTI evalúa 100 aspectos diferentes de transparencia, desde cómo se construye un modelo hasta su funcionamiento y aplicación. Al calificar a 10 importantes empresas del sector con su índice de 100 puntos, el equipo encontró amplio margen de mejora. Las puntuaciones más altas oscilaron entre 47 y 54, mientras que la más baja apenas alcanzó los 12 puntos.

Además, el índice busca guiar a los legisladores hacia una regulación efectiva de estos modelos. Bommasani destaca que para muchos gobiernos en el mundo, la transparencia es una prioridad política esencial.

Junto al índice, se publicó un extenso documento de 100 páginas sobre la metodología y resultados, que detalla los 100 indicadores de transparencia, el protocolo de puntuación y las justificaciones de las calificaciones.

¿Por qué es importante la transparencia?

La falta de transparencia no es un problema nuevo en tecnologías digitales. Bommasani señala que ya hemos visto prácticas engañosas en anuncios, tarifas y moderación de contenido en línea. Con la disminución de la transparencia en los Modelos Fundacionales Comerciales, surgen amenazas similares para la protección del consumidor.

Percy Liang añade que la transparencia en estos modelos es crucial para impulsar iniciativas políticas en inteligencia artificial y garantizar que los usuarios dispongan de la información necesaria.

Creando el FMTI

Para desarrollar el FMTI, el equipo estableció 100 indicadores de transparencia. Estos se basan en la literatura de inteligencia artificial y prácticas de protección al consumidor en redes sociales. Los indicadores abarcan desde la construcción del modelo hasta su aplicación y uso final.

Bommasani recalca que el índice no busca evaluar la responsabilidad corporativa, sino más bien priorizar la transparencia como paso inicial hacia una conducta más responsable de las empresas.

Los resultados

Para calificar a las principales empresas creadoras de modelos, el equipo colectó información públicamente disponible sobre cada modelo líder. Luego, presentaron un borrador inicial de las calificaciones del FMTI a las empresas para que pudieran responder.

Meta logró la puntuación más alta con un no muy impresionante 54 sobre 100. Sin embargo, lo que quizás es más relevante son los indicadores en los que casi todas las empresas tuvieron un rendimiento deficiente. Por ejemplo, ninguna empresa proporciona información sobre cuántos usuarios dependen de su modelo ni estadísticas sobre las geografías o sectores del mercado que utilizan el modelo.

Impacto potencial del FMTI

Bommasani espera que el FMTI motive a las empresas a aumentar su transparencia y que informe la elaboración de políticas gubernamentales. Pone como ejemplo la Unión Europea, que está trabajando en la Ley de IA. Al destacar donde las empresas tienen deficiencias, espera que el FMTI ayude a enfocar el enfoque de la UE en su próxima versión.

Los autores del estudio son reconocidos expertos y académicos de Stanford, MIT y Princeton, quienes buscan, a través de este trabajo, arrojar luz sobre la situación actual de la transparencia en el ámbito de los modelos fundacionales y alentar a una mayor responsabilidad y claridad en la industria.

vía: HAI Stanford