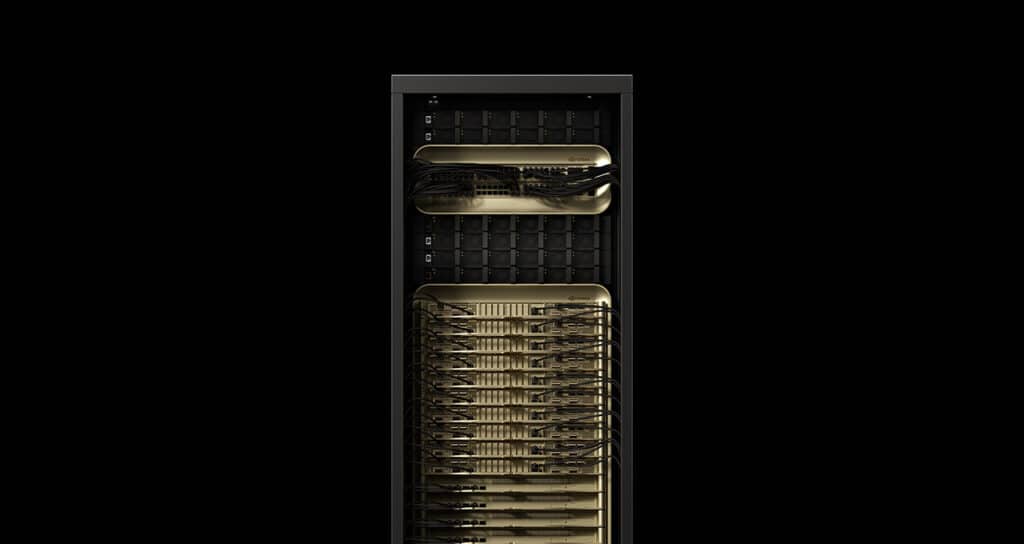

En los recientes benchmarks de MLPerf Inference V5.0, que reflejan algunos de los escenarios de inferencia más desafiantes, la plataforma NVIDIA Blackwell estableció nuevos récords y marcó la primera participación de NVIDIA utilizando el sistema NVIDIA GB200 NVL72, una solución a escala de rack diseñada para el razonamiento de inteligencia artificial.

La promesa de una inteligencia artificial de vanguardia requiere una nueva infraestructura computacional, conocida como fábricas de IA. A diferencia de los centros de datos tradicionales, las fábricas de IA no solo almacenan y procesan datos, sino que fabrican inteligencia a gran escala, transformando datos crudos en conocimientos en tiempo real. El objetivo es entregar respuestas precisas a consultas de forma rápida, al menor costo y al mayor número de usuarios posible.

La complejidad de lograr esto es significativa y se lleva a cabo tras bastidores. A medida que los modelos de inteligencia artificial crecen a miles de millones de parámetros para ofrecer respuestas más inteligentes, el cómputo necesario para generar cada token aumenta. Este requisito reduce el número de tokens que una fábrica de IA puede generar y aumenta el costo por token. Mantener un alto rendimiento de inferencia y un bajo costo por token requiere una rápida innovación a través de todas las capas de la pila tecnológica, abarcando desde el silicio hasta los sistemas de red y el software.

Las últimas actualizaciones de MLPerf Inference, un benchmark de la industria revisado por pares sobre el rendimiento de inferencia, incluyen la incorporación del modelo Llama 3.1 405B, uno de los más grandes y desafiantes de ejecutar. El nuevo benchmark interactivo Llama 2 70B presenta requisitos de latencia mucho más estrictos en comparación con el benchmark original Llama 2 70B, reflejando mejor las restricciones de las implementaciones en producción para ofrecer las mejores experiencias de usuario posibles.

Además de la plataforma Blackwell, la plataforma NVIDIA Hopper demostró un rendimiento excepcional, con un aumento significativo en el rendimiento en el último año con el Llama 2 70B gracias a optimizaciones de pila completa.

El sistema GB200 NVL72, que conecta 72 GPUs NVIDIA Blackwell para actuar como una GPU masiva, entregó hasta 30 veces mayor rendimiento en el benchmark Llama 3.1 405B en comparación con la presentación anterior de NVIDIA H200 NVL8. Este logro se alcanzó mediante más del triple de rendimiento por GPU y un dominio de interconexión NVIDIA NVLink 9 veces más grande.

Las implementaciones de inferencia en producción a menudo tienen restricciones de latencia en dos métricas clave: el tiempo hasta el primer token (TTFT) y el tiempo por token de salida (TPOT). El nuevo benchmark interactivo Llama 2 70B tiene un TPOT 5 veces más corto y un TTFT 4.4 veces menor, modelando una experiencia de usuario más receptiva.

NVIDIA Hopper, introducida en 2022, potencia muchas de las fábricas de inferencia de IA actuales y continúa impulsando el entrenamiento de modelos. Gracias a la optimización continua de software, NVIDIA incrementa el rendimiento de las fábricas de IA basadas en Hopper, aumentando su valor.

En esta ronda de MLPerf, 15 socios presentaron resultados sobresalientes en la plataforma NVIDIA, reflejando su alcance a lo largo de todos los proveedores de servicios en la nube y fabricantes de servidores a nivel mundial. El trabajo de MLCommons para evolucionar continuamente el conjunto de benchmarks MLPerf Inference es vital para ayudar a los tomadores de decisiones en TI a seleccionar la infraestructura de IA óptima.

Fuente: Zona de blogs y prensa de Nvidia