NVIDIA ha aprovechado GTC 2026 para meterse de lleno en uno de los debates más delicados de la inteligencia artificial actual: cómo ejecutar agentes autónomos de forma útil sin abrir la puerta a problemas de seguridad, privacidad o control. Su respuesta se llama NemoClaw, una nueva pila de software para OpenClaw que, según la compañía, permite instalar modelos Nemotron y el nuevo entorno OpenShell con un solo comando para desplegar asistentes de IA “siempre activos” en equipos locales, servidores on premise o sistemas como los RTX PC, DGX Station y DGX Spark.

La noticia tiene interés porque llega en un momento en el que los agentes dejan de ser simples chatbots y empiezan a asumir tareas continuadas, con memoria, herramientas, acceso a red y capacidad para actuar durante horas o días. OpenClaw, el proyecto sobre el que se apoya NemoClaw, se presenta como una pasarela autoalojada que conecta aplicaciones como WhatsApp, Telegram, Discord o iMessage con asistentes de IA que el usuario ejecuta en su propia máquina o en un servidor bajo su control. Esa propuesta encaja con la demanda creciente de modelos más personales, persistentes y menos dependientes de servicios cerrados en la nube.

Qué es NemoClaw y qué añade a OpenClaw

Lo que NVIDIA ha puesto sobre la mesa no es un nuevo agente en sí mismo, sino una capa adicional para endurecer el funcionamiento de OpenClaw. En su documentación oficial, la compañía define NemoClaw como una pila open source que añade controles de privacidad y seguridad al proyecto y que, además, automatiza buena parte de la puesta en marcha. En la práctica, instala OpenShell, un runtime que aísla al agente dentro de un entorno sandbox y aplica políticas declarativas para decidir qué puede leer, a qué servicios puede conectarse y a dónde se envían las peticiones de inferencia.

Ese matiz es importante. Mientras muchas demos de agentes se centran en lo que el sistema es capaz de hacer, NemoClaw intenta responder a otra pregunta: qué debe poder hacer y bajo qué condiciones. La guía técnica de NVIDIA explica que cada solicitud de red, acceso a archivos o llamada a inferencia puede quedar gobernada por políticas explícitas, y que OpenShell recurre a mecanismos de aislamiento a nivel de kernel como Landlock, seccomp y namespaces de red. No es una promesa menor, porque el principal problema de los agentes autónomos no suele ser que fallen al responder, sino que tengan demasiado margen para actuar sin supervisión suficiente.

NVIDIA también plantea un enfoque híbrido para el uso de modelos. NemoClaw puede aprovechar modelos abiertos en local, entre ellos Nemotron, y al mismo tiempo enrutar determinadas cargas hacia modelos alojados en la nube mediante un “privacy router”. La idea es combinar privacidad y coste en las tareas que puedan resolverse en el dispositivo del usuario, sin renunciar a modelos externos cuando haga falta más capacidad. La compañía lo presenta como una forma de hacer más productivos y escalables los agentes de larga duración, aunque esa visión, como ocurre con buena parte del discurso de GTC, debe leerse todavía como una hoja de ruta en evolución más que como un estándar ya asentado.

Por qué la seguridad importa más que la demo

La relevancia real del anuncio no está tanto en el instalador en un solo comando como en el problema que intenta resolver. OpenClaw deja claro en su propia documentación que un asistente bien conectado puede ejecutar comandos de shell, leer y escribir archivos, acceder a servicios de red e incluso enviar mensajes si el usuario le ha dado acceso a canales como WhatsApp. También advierte de que personas externas pueden intentar manipular al asistente para que haga cosas indebidas, obtener datos sensibles o sonsacar información de la infraestructura.

Ese modelo de amenaza explica por qué NVIDIA insiste tanto en los “guardrails”. En lugar de tratar al agente como una aplicación inocua, NemoClaw parte de la idea de que hay que limitar desde el principio el radio de impacto de cualquier acción. La aproximación no elimina el riesgo, pero sí encaja con una necesidad muy clara en empresas y desarrolladores avanzados: poder aprovechar agentes persistentes sin entregarles acceso indiscriminado a todo el sistema. En un mercado saturado de promesas sobre agentes que reservan viajes, escriben código o automatizan procesos completos, el matiz de seguridad puede ser, precisamente, lo que separe una demo vistosa de una herramienta utilizable.

También hay una lectura empresarial. OpenClaw se dirige sobre todo a desarrolladores y usuarios avanzados que quieren un asistente personal autoalojado, mientras que NVIDIA intenta colocar alrededor de ese proyecto una capa más cercana al despliegue profesional. Su blog técnico sitúa NemoClaw dentro del Agent Toolkit, una colección más amplia de modelos, runtimes y herramientas para construir agentes de larga duración con un enfoque más controlado. Eso refuerza la estrategia de la compañía de no limitarse al silicio: NVIDIA quiere vender hardware, sí, pero también el entorno de software, seguridad y operación que haga viable la nueva generación de agentes.

Del PC con RTX al mini superordenador de sobremesa

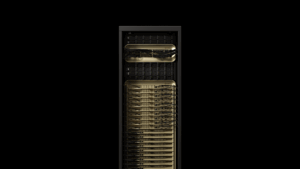

Otro punto clave del anuncio es el hardware. NVIDIA sostiene que los agentes “always-on” necesitan computación dedicada para construir herramientas, ejecutar tareas y mantenerse activos alrededor del reloj. Por eso NemoClaw se posiciona para funcionar desde ordenadores con GeForce RTX o estaciones con RTX PRO hasta equipos como DGX Station y DGX Spark. En la página oficial de NemoClaw aparece además como “early preview”, lo que indica que, aunque ya existe una vía de acceso y documentación pública, la propuesta todavía está en fase inicial y puede cambiar en disponibilidad o prestaciones.

Ese detalle no es menor. NVIDIA ha acompañado el lanzamiento con páginas específicas para ejecutar NemoClaw sobre DGX Spark y DGX Station, presentándolos como plataformas idóneas para agentes persistentes en local. El mensaje de fondo es evidente: si la siguiente ola de la IA consiste en asistentes que viven en el PC del usuario, trabajan todo el día y combinan modelos locales con servicios cloud, entonces la venta de hardware de escritorio para IA puede ganar un nuevo argumento comercial. No se trata solo de entrenar grandes modelos en centros de datos, sino de reservar potencia local para operar con privacidad, latencia baja y más control.

Aun así, conviene separar el entusiasmo promocional de los hechos comprobados. Jensen Huang llegó a describir OpenClaw como “el sistema operativo de la IA personal” y como el proyecto open source de crecimiento más rápido de la historia, pero esa afirmación forma parte del discurso corporativo del anuncio y no aparece acompañada de una verificación independiente en la nota de NVIDIA. Lo que sí está confirmado es que OpenClaw existe como proyecto abierto, con documentación pública, enfoque autoalojado y una comunidad activa; y que NVIDIA ha decidido construir encima una capa de seguridad, despliegue y modelos con la que intenta convertir ese impulso comunitario en una plataforma más madura para la era de los agentes.

Preguntas frecuentes

¿Qué es OpenClaw y para qué sirve?

OpenClaw es un proyecto autoalojado que conecta apps de mensajería como WhatsApp, Telegram, Discord o iMessage con asistentes de IA que el usuario ejecuta en su propio equipo o servidor. Está pensado para crear asistentes personales persistentes y con control local.

¿Qué aporta NemoClaw frente a OpenClaw por sí solo?

NemoClaw añade una capa de seguridad y privacidad desarrollada por NVIDIA. Instala OpenShell, crea un entorno sandbox para el agente y aplica políticas sobre acceso a archivos, red e inferencia, con el objetivo de reducir riesgos en agentes autónomos de larga duración.

¿Se puede usar NemoClaw con modelos locales y también con la nube?

Sí. NVIDIA indica que NemoClaw puede utilizar modelos abiertos en local, como Nemotron, y combinar ese uso con modelos cloud a través de un sistema de enrutado orientado a la privacidad. Ese enfoque híbrido busca equilibrar control, coste y capacidad.

¿Está ya disponible NemoClaw para todo el mundo?

NVIDIA lo muestra ya en su web oficial y ofrece documentación pública, pero lo califica como “early preview”. Eso sugiere que la tecnología ya puede probarse en ciertos entornos, aunque su disponibilidad, integración final o evolución futura todavía pueden cambiar.

Más información en GitHub.