Meta lanzó en abril de 2023 SAM (Segment Anything Model), un modelo de segmentación de imágenes de código abierto entrenado con más de 1.100 millones de máscaras en 11 millones de fotografías. El modelo supuso un cambio respecto a los sistemas anteriores, que requerían grandes volúmenes de datos etiquetados a mano para cada dominio específico y limitaban su uso a entornos con recursos técnicos considerables. Con SAM, Meta planteó un sistema capaz de generalizar a objetos nuevos sin ajuste fino previo y puso el código, los pesos del modelo y el dataset SA-1B a disposición pública bajo licencia Apache 2.0.

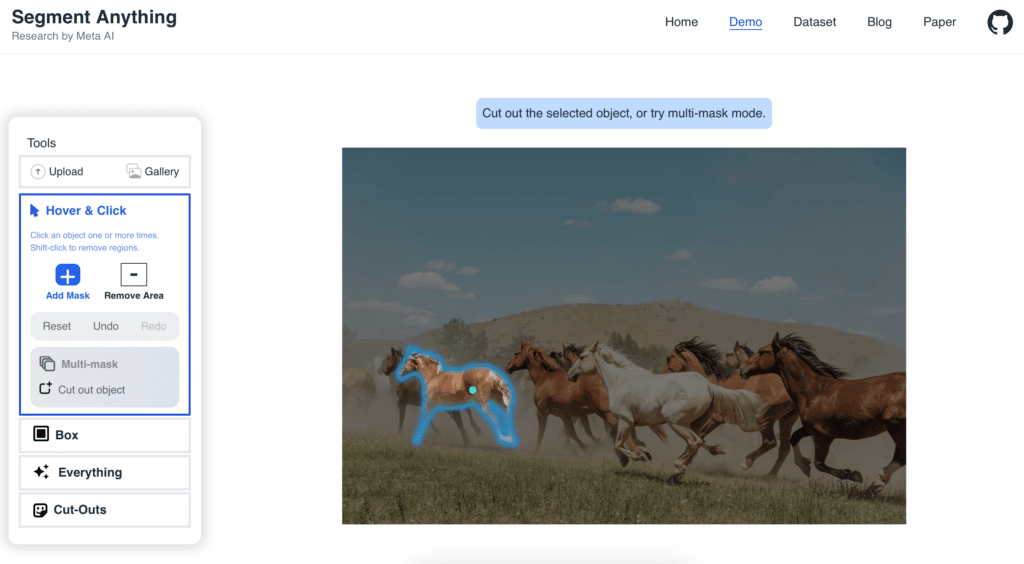

SAM actúa como un modelo de fundamento para visión por computadora (VC). Acepta distintos tipos de indicación, incluyendo clics dentro del objeto, cuadros delimitadores, máscaras aproximadas y texto libre, y devuelve máscaras con alta precisión incluso en objetos que no vio durante el entrenamiento. Esta versatilidad lo diferencia de modelos específicos como Mask R-CNN, que necesitan entrenamiento o ajuste fino específico para cada caso de uso. El equipo de Meta describió SAM como una unificación de los enfoques de segmentación interactiva y automática en un único modelo generalista.

El dataset SA-1B se construyó con un motor de datos de tres fases. La primera recurría a anotadores humanos asistidos por el modelo; la segunda mezclaba anotación automática con revisión humana para ampliar la diversidad de las máscaras; y la tercera automatizaba el proceso por completo. Esa última fase fue la que permitió escalar hasta 1.100 millones de máscaras en aproximadamente 11 millones de imágenes con licencias adecuadas y sin datos personales identificables.

Las aplicaciones previstas abarcan análisis automático de contenido visual en páginas web, herramientas de edición creativa (extracción de regiones para collages, edición de vídeo con objetos aislados) y usos científicos como la segmentación de imágenes de satélite, microscopía o imágenes médicas. En todos estos casos, SAM elimina la necesidad de entrenar un modelo especializado para cada dominio, algo que ha sido uno de los frenos principales para usar la segmentación en producción. Meta también publicó el dataset SA-1B como recurso independiente, ya que hasta entonces no existía ningún conjunto de datos de segmentación a esa escala disponible de forma abierta.

Una limitación relevante de SAM es que identifica qué píxeles pertenecen a un objeto pero no determina qué tipo de objeto es, lo que lo obliga a combinarse con un modelo de detección cuando se necesita reconocimiento de categorías. Las arquitecturas de IA más allá de los LLM explican cómo SAM y otros modelos de visión encajan junto a los transformers y los modelos de difusión en el mapa actual de la inteligencia artificial.

Desde su publicación, SAM se ha integrado en proyectos de código abierto y plataformas comerciales de edición de imagen y análisis visual. Meta ha continuado desarrollando modelos de visión más avanzados que amplían las capacidades del modelo original. El trabajo posterior de Meta en modelos de fundamento ilustra hasta dónde ha llegado la compañía desde aquel primer SAM. Sobre la estrategia del grupo frente a sus competidores, la apuesta actual de Meta frente a OpenAI y Google analiza su posicionamiento en el mercado de la IA generativa.

Preguntas frecuentes sobre SAM

¿Qué es SAM y en qué se diferencia de otros modelos de segmentación?

SAM es un modelo de fundamento para segmentación de imágenes entrenado a gran escala que puede generalizar a objetos nuevos sin ajuste fino. Los modelos anteriores necesitaban entrenamiento o ajuste específico para cada dominio.

¿Qué tipos de indicaciones acepta SAM para guiar la segmentación?

SAM acepta clics dentro del objeto, cuadros delimitadores, máscaras aproximadas y texto. Esta variedad le permite integrarse en distintos flujos de trabajo sin adaptar el modelo.

¿Cuántos datos se usaron para entrenar SAM?

El modelo se entrenó con el dataset SA-1B, que contiene más de 1.100 millones de máscaras de segmentación en aproximadamente 11 millones de imágenes con licencias adecuadas.

¿SAM puede identificar qué tipo de objeto está segmentando?

No. SAM identifica qué píxeles pertenecen a un objeto, pero no lo clasifica semánticamente. Para reconocimiento de categorías hay que combinarlo con un modelo de clasificación o detección.

¿Con qué licencia está disponible SAM?

Meta publicó SAM bajo licencia Apache 2.0, que permite uso comercial y modificación del código. El modelo y el dataset SA-1B están en el repositorio oficial en GitHub.

Fuente: Meta AI Blog · GitHub facebookresearch/segment-anything.