La generación de interfaces con IA está dejando de ser una curiosidad visual para convertirse en una pieza más del flujo de desarrollo. Ese cambio no tiene tanto que ver con “hacer diseños bonitos con prompts” como con algo bastante más práctico: integrar el diseño dentro del mismo entorno donde ya se escribe el producto. Y ahí es donde AIDesigner empieza a resultar interesante para desarrolladores y equipos frontend. Su propuesta no es abrir otra web para generar una landing aislada, sino conectar un servidor MCP a asistentes como Claude Code, Codex, Cursor o VS Code con Copilot para que el agente pueda crear, refinar y adaptar interfaces desde el propio repositorio.

Eso importa porque una parte del problema del diseño con IA no era la calidad visual, sino la fragmentación del flujo. Se generaba una maqueta fuera del proyecto, se copiaba HTML de forma manual, se perdía el contexto del stack y después alguien tenía que rehacerlo para que encajara en React, Next.js o la librería de componentes interna. AIDesigner intenta resolver justo ese punto: su CLI analiza el repositorio, detecta framework, sistema de estilos, componentes y rutas, y envía ese repo_context al servidor MCP para generar una interfaz más alineada con el código existente. El resultado se guarda además como artefacto local dentro de .aidesigner/, no como una respuesta efímera que desaparece al cerrar la pestaña.

Más que otro generador de landing pages

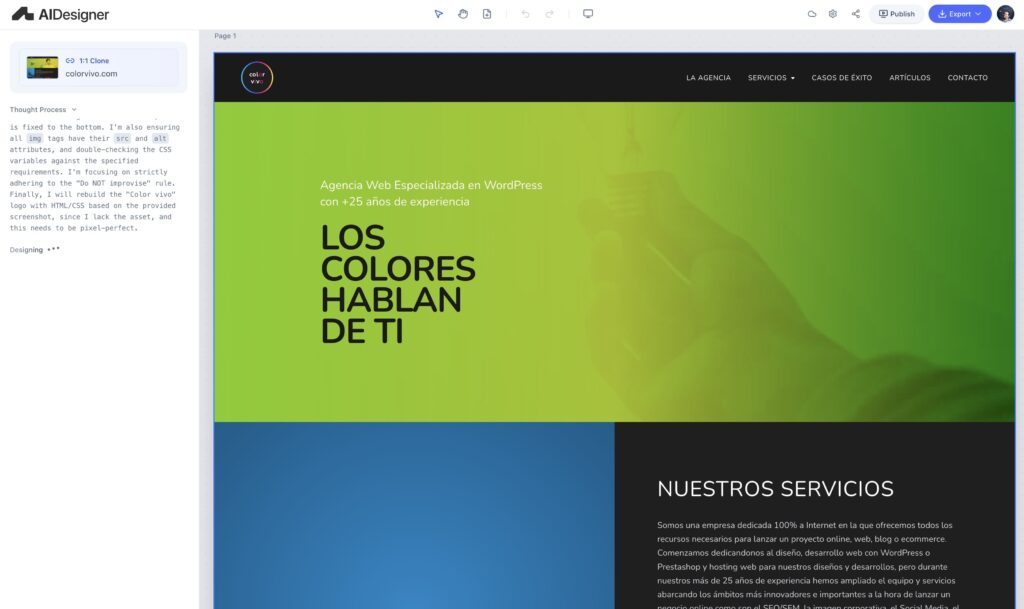

La documentación oficial de AIDesigner deja claro que el producto se apoya en dos herramientas principales: generate_design y refine_design. La primera genera un nuevo diseño en HTML completo con Tailwind CSS inline a partir de un prompt. La segunda permite iterar sobre una ejecución previa o sobre HTML existente con instrucciones en lenguaje natural. Lo interesante es que ambas admiten modos de referencia como inspire, clone y enhance, de manera que una URL puede servir como inspiración, como base para una recreación visual cercana o como punto de partida para una mejora estética. La herramienta no promete una copia literal perfecta de cualquier frontend, pero sí un flujo razonablemente estructurado para replicar lenguaje visual, layout y estilo de una web concreta dentro del entorno del asistente.

Ese matiz es importante para no exagerar lo que hace. AIDesigner no “roba” automáticamente una web ni reconstruye de forma mágica todos sus componentes productivos. Lo que documenta es un sistema que analiza una URL de referencia y genera una interfaz en uno de esos tres modos, con un coste de crédito asociado y con una intención clara: acelerar la fase de diseño inicial o de rediseño sin salir del flujo de programación. Para un equipo frontend o un desarrollador individual, eso puede ahorrar bastante tiempo en exploración visual y en primeras iteraciones, aunque el resultado siga necesitando criterio humano y adaptación al proyecto real.

La parte interesante para desarrolladores: integración y adopción

Uno de los aspectos más útiles de AIDesigner para un medio de desarrolladores no está en la demo, sino en la adopción posterior. El sistema guarda por ejecución el HTML, el contexto detectado, la petición, un resumen, una previsualización y un documento de adopción. Además, ofrece un comando adopt para generar una guía estructurada de portado, identificando framework objetivo, rutas sugeridas, mapeo de tokens y componentes reutilizables del propio proyecto. Esa capa marca una diferencia frente a muchas herramientas de IA visual que generan algo aparente, pero luego dejan todo el trabajo serio en manos del desarrollador. Aquí, al menos, hay una intención clara de conectar diseño generado y código de producción.

La integración también está bastante trabajada. Para Claude Code, AIDesigner propone instalarse con npx -y @aidesigner/agent-skills init, lo que crea .mcp.json, agentes, comandos y una skill específica dentro de .claude/. La propia documentación de Claude Code explica que puede conectarse a herramientas externas mediante MCP, extenderse con skills, configurarse con CLAUDE.md y automatizar acciones con hooks. Es decir, AIDesigner no está inventando una ruta paralela: está aprovechando justo el modelo de extensibilidad que Anthropic está empujando para Claude Code.

Cómo hacer algo parecido directamente en Claude Code

La parte más interesante para muchos equipos es que parte de este flujo también puede construirse directamente en Claude Code, incluso sin depender por completo de AIDesigner. No de la misma forma, ni con el mismo nivel de empaquetado, pero sí con herramientas bastante cercanas. Claude Code ya permite conectarse a servidores MCP, crear skills, usar instrucciones persistentes con CLAUDE.md, montar subagentes especializados y automatizar comprobaciones o procesos con hooks. En la práctica, eso abre dos caminos.

El primero es el más directo: usar AIDesigner como MCP dentro de Claude Code. Según la guía oficial del producto, basta con ejecutar su inicializador en la raíz del proyecto, abrir Claude Code, entrar en /mcp, conectar el servidor aidesigner y completar el flujo OAuth en el navegador. A partir de ahí, Claude puede invocar sus herramientas de diseño y usar el comando /aidesigner o el subagente instalado para generar y refinar interfaces desde el propio proyecto. Es la vía más cómoda si lo que se quiere es una experiencia lista para usar.

El segundo camino es más artesanal, pero también más flexible: usar Claude Code de forma nativa para replicar gran parte de ese comportamiento. Claude Code ya soporta MCP para conectarse a herramientas externas y su propia documentación muestra ejemplos de integración con servidores como Playwright MCP para automatización de navegador. Eso significa que un equipo puede montar un flujo donde Claude visite una web, inspeccione estructura y estilos a través de un MCP de navegador, lea tokens o componentes del repositorio, y genere después una implementación alineada con el stack usando instrucciones en CLAUDE.md y skills internas del proyecto. No es exactamente AIDesigner, pero sí una forma de construir un “copiloto de UI” bastante serio dentro de Claude Code sin salir del ecosistema de Anthropic.

De hecho, Claude Code ya permite una combinación bastante potente para esto:CLAUDE.md para fijar reglas de diseño y componentes autorizados,

skills para enseñarle patrones de UI del proyecto,

MCP para leer webs, Figma-like endpoints o herramientas internas,

y hooks para validar automáticamente que el código generado respeta linting, tokens o convenciones del equipo. Anthropic lo plantea precisamente como una plataforma extensible para adaptar Claude al flujo del repositorio, no solo como un chat en terminal.

Una tendencia que va más allá de una sola herramienta

Lo que hace relevante a AIDesigner no es solo que conecte Claude Code con generación de interfaces, sino que muestra hacia dónde se mueve el desarrollo asistido por IA. Durante un tiempo, los agentes se centraron en escribir funciones, arreglar tests o navegar repositorios. Ahora empiezan a intervenir también en la capa visual, y eso cambia bastante la conversación para equipos de frontend y producto. La frontera ya no está solo en generar código válido, sino en producir interfaces suficientemente buenas y suficientemente adaptadas al stack como para que no haya que rehacerlas enteras después.

AIDesigner aporta una solución empaquetada para eso. Claude Code, por su parte, ya ofrece los bloques necesarios para construir algo parecido de forma más abierta. La diferencia está en cuánto trabajo quiere asumir cada equipo: usar un MCP especializado listo para funcionar o diseñar su propio flujo con skills, hooks, instrucciones y herramientas conectadas. En ambos casos, la dirección es la misma: el diseño UI ya está entrando en el bucle real de los agentes de código. Y esa transición probablemente será una de las más importantes del frontend asistido por IA durante este año.