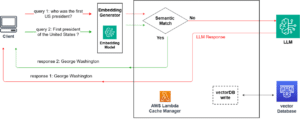

Creación de una Caché Semántica en Amazon OpenSearch Serverless y Amazon Bedrock

La latencia y los costos emergen como desafíos cruciales en el ámbito de la inteligencia artificial generativa, especialmente al emplear modelos de lenguaje de gran tamaño (LLMs, por sus siglas en inglés). Estos modelos, que procesan texto de manera secuencial y predicen un token a la vez, pueden generar retrasos significativos, impactando adversamente la experiencia del usuario. Además, la creciente