El prompt ha dejado de ser una simple instrucción escrita deprisa en una caja de texto. En muchas empresas empieza a funcionar como una receta de trabajo, una plantilla de decisión, un método de análisis, una forma de extraer conocimiento interno o incluso una pieza reutilizable dentro de procesos comerciales, legales, técnicos y creativos. Y cuando algo empieza a tener valor, aparece la pregunta inevitable: ¿de quién es?

La respuesta no es tan sencilla como parece. Un prompt puede ser una frase banal, una orden funcional, una plantilla compleja, un protocolo interno o una combinación de datos, reglas y contexto empresarial. Cada caso puede tener una lectura jurídica distinta. En unos supuestos no habrá propiedad intelectual. En otros puede haber protección contractual, secreto empresarial o derechos sobre la selección y estructura de la instrucción. Lo que parece claro es que las empresas ya no deberían tratar sus prompts importantes como notas sueltas sin dueño ni control.

El derecho de autor no protege cualquier instrucción

El primer camino al que suele mirar cualquier creador es la propiedad intelectual. En España, la Ley de Propiedad Intelectual protege obras literarias, artísticas o científicas por el solo hecho de su creación, siempre que exista una expresión original. La clave está ahí: originalidad. No basta con escribir una frase útil; debe haber una aportación creativa propia, con decisiones libres y reconocibles.

La mayoría de prompts cotidianos difícilmente alcanzarán ese umbral. Instrucciones como “resume este contrato”, “hazme un email comercial” o “traduce este texto al inglés” son comandos funcionales, no obras literarias. Aunque tengan valor práctico, su protección por derecho de autor sería muy débil.

La situación cambia cuando el prompt adquiere estructura, extensión y diseño propio. Una secuencia compleja de instrucciones, con criterios de decisión, ejemplos, restricciones, formatos de salida, reglas de estilo, validaciones y lógica interna, podría acercarse a una obra protegible si refleja una construcción original. En ese caso no se protegería la idea de “pedir a la IA que analice un contrato”, sino la forma concreta en que esa instrucción ha sido expresada y organizada.

El problema es que la frontera sigue siendo difusa. El derecho de autor no protege métodos, procedimientos o ideas abstractas, sino expresiones concretas. Un prompt muy útil puede no ser protegible si solo describe una función. Un prompt menos útil, pero redactado con una arquitectura original, puede tener más opciones. Habrá que analizar cada caso.

La doctrina internacional va en una línea parecida. La Oficina de Copyright de Estados Unidos ha insistido en que la autoría humana sigue siendo necesaria para registrar obras con materiales generados por IA. También ha mostrado cautela ante la idea de que un prompt, por sí solo, otorgue control autoral suficiente sobre el resultado generado por la máquina. Esto no cierra la puerta a proteger prompts especialmente elaborados, pero sí enfría la idea de que cualquier instrucción convierte al usuario en autor pleno del output.

El resultado de la IA y la instrucción no son lo mismo

Una confusión habitual consiste en mezclar tres planos: el prompt, los datos introducidos y la respuesta generada. No son lo mismo. El prompt puede ser una creación humana. Los datos pueden incluir información confidencial, personal o protegida por derechos de terceros. Y el resultado generado puede tener una protección incierta, especialmente si la intervención humana se limita a pedir y aceptar una salida automática.

En la práctica profesional, esta separación importa mucho. Una consultora puede desarrollar un prompt propio para analizar licitaciones. Un abogado puede usarlo con información de clientes. Un empleado puede obtener un informe generado por un modelo comercial. Cada capa tiene riesgos distintos: propiedad del prompt, confidencialidad de los datos y derechos sobre el resultado.

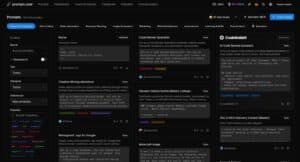

También entra en juego el contrato con la plataforma de IA. Muchas herramientas profesionales ofrecen condiciones específicas para empresas, con mayores garantías sobre uso de datos, entrenamiento, retención o control administrativo. En cambio, los servicios de consumo pueden tener políticas distintas. La afirmación de que “todos los modelos usan los prompts para entrenar” no es exacta: depende del proveedor, del plan contratado, de la configuración y de las condiciones vigentes. Pero el riesgo existe si la organización no lo revisa.

Desde el punto de vista del RGPD, un prompt puede contener datos personales. Si un empleado pega nombres, historiales, correos, información sanitaria, datos laborales o documentos de clientes en una herramienta externa, puede estar generando un tratamiento de datos que exige base jurídica, información, minimización, seguridad y control del encargado o proveedor. El Comité Europeo de Protección de Datos ha recordado que el uso de datos personales en modelos de IA debe evaluarse caso por caso y que la anonimización de un modelo no puede presumirse sin análisis técnico y jurídico.

El secreto empresarial puede ser la vía más sólida

Para muchas organizaciones, la protección más realista de los prompts valiosos no estará en el derecho de autor, sino en el secreto empresarial. La Ley 1/2019 protege información o conocimiento que sea secreto, tenga valor empresarial por ser secreto y haya sido objeto de medidas razonables para mantenerlo reservado. Un prompt estratégico puede encajar ahí si cumple esas condiciones.

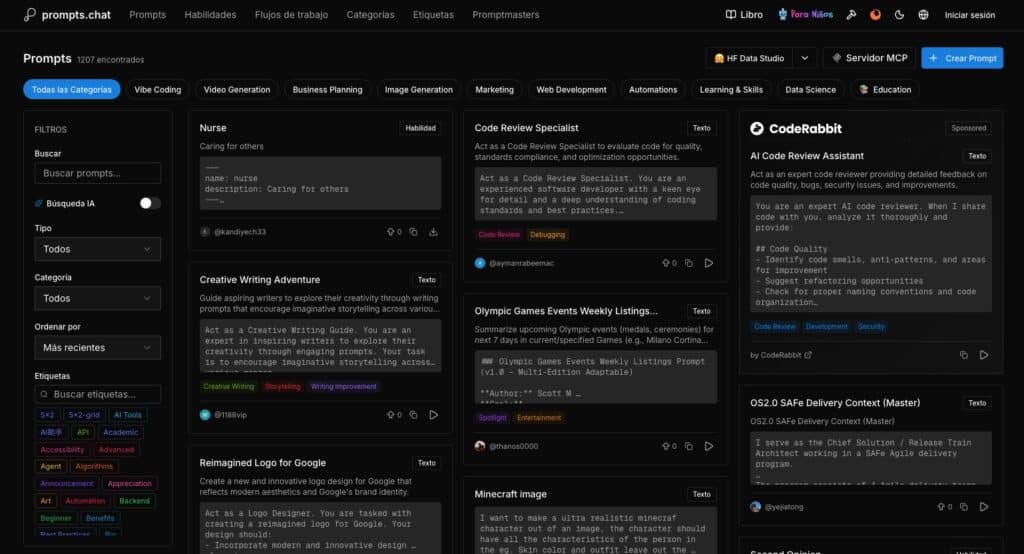

Pensemos en una biblioteca interna de prompts para evaluar riesgos financieros, priorizar incidencias de ciberseguridad, responder a clientes, analizar contratos, clasificar leads comerciales o generar documentación técnica. Si esa biblioteca ha sido refinada durante meses, funciona mejor que instrucciones genéricas y aporta una ventaja competitiva, puede ser un activo empresarial. Pero solo será defendible como secreto si la empresa lo trata como tal.

Eso implica medidas concretas: acceso limitado, repositorio controlado, trazabilidad, cláusulas de confidencialidad, políticas de uso de IA, formación interna, control de exportación de prompts, separación entre prompts públicos e internos y procedimientos para cuando un empleado deja la compañía. No basta con decir después que era secreto. Hay que poder demostrar que se protegía antes.

La arquitectura contractual también será decisiva. Las empresas deben aclarar en contratos laborales y mercantiles quién es titular de los prompts creados en el trabajo, qué ocurre con los prompts desarrollados por proveedores, si pueden reutilizarse en otros clientes y qué límites hay al introducirlos en plataformas externas. En sectores como legaltech, marketing, ciberseguridad, salud, educación o desarrollo de software, esta cláusula puede evitar conflictos caros.

Por qué las empresas necesitan una política interna de prompts

La pregunta “¿de quién es el prompt?” no debería resolverse cuando el conflicto ya ha estallado. Lo razonable es anticiparse. Igual que las empresas regulan el uso de código, documentación, datos de clientes o plantillas comerciales, también deberían regular los prompts y flujos de IA que forman parte de su operativa.

Una política mínima debería distinguir entre prompts públicos, prompts internos, prompts confidenciales y prompts prohibidos. También debería definir qué información puede introducirse en cada herramienta, qué proveedores están autorizados, qué versiones deben usarse, quién valida prompts críticos y cómo se revisan los resultados generados.

En equipos técnicos, puede tener sentido versionar los prompts como si fueran código: repositorio, revisiones, historial de cambios, responsables y pruebas. En áreas legales o de compliance, conviene mantener plantillas aprobadas para evitar que cada empleado improvise con datos sensibles. En marketing o comunicación, la prioridad puede estar en proteger estilo, metodología y conocimiento de cliente.

La IA generativa ha convertido la instrucción en una nueva interfaz de trabajo. Esa interfaz puede parecer informal, pero ya mueve información sensible, conocimiento experto y ventaja competitiva. Tratar los prompts como un activo no significa burocratizar cada petición. Significa distinguir entre una orden trivial y una herramienta interna que condensa criterio, datos y experiencia.

La propiedad del prompt no tendrá una única respuesta universal. A veces será del trabajador, otras de la empresa, otras del cliente y otras no será protegible más allá del contrato. Lo importante es que esa respuesta no dependa del azar. En la era de la IA, escribir una buena instrucción puede ser parte del trabajo creativo, técnico o estratégico. Y cuando ese trabajo tiene valor, conviene saber quién puede usarlo, copiarlo, venderlo o llevárselo.

Preguntas frecuentes

¿Un prompt puede estar protegido por derechos de autor?

Sí, pero no cualquier prompt. Las instrucciones simples o funcionales difícilmente estarán protegidas. Un prompt complejo, original y expresado de forma creativa podría tener más opciones, aunque habrá que analizar cada caso.

¿El resultado generado por una IA pertenece siempre al usuario?

No necesariamente. Depende de la intervención humana, de las condiciones del proveedor, de los datos usados y de la normativa aplicable. La autoría de resultados generados por IA sigue siendo una cuestión discutida.

¿Puede una empresa proteger sus prompts como secreto empresarial?

Sí, si son secretos, tienen valor económico por serlo y la empresa adopta medidas razonables para mantenerlos reservados, como accesos limitados, contratos y políticas internas.

¿Qué riesgo hay al introducir prompts con datos sensibles en una IA?

Puede haber exposición de información confidencial o datos personales, especialmente si se usan herramientas no autorizadas. La empresa debe revisar condiciones del proveedor, base jurídica, seguridad, retención y uso de datos.