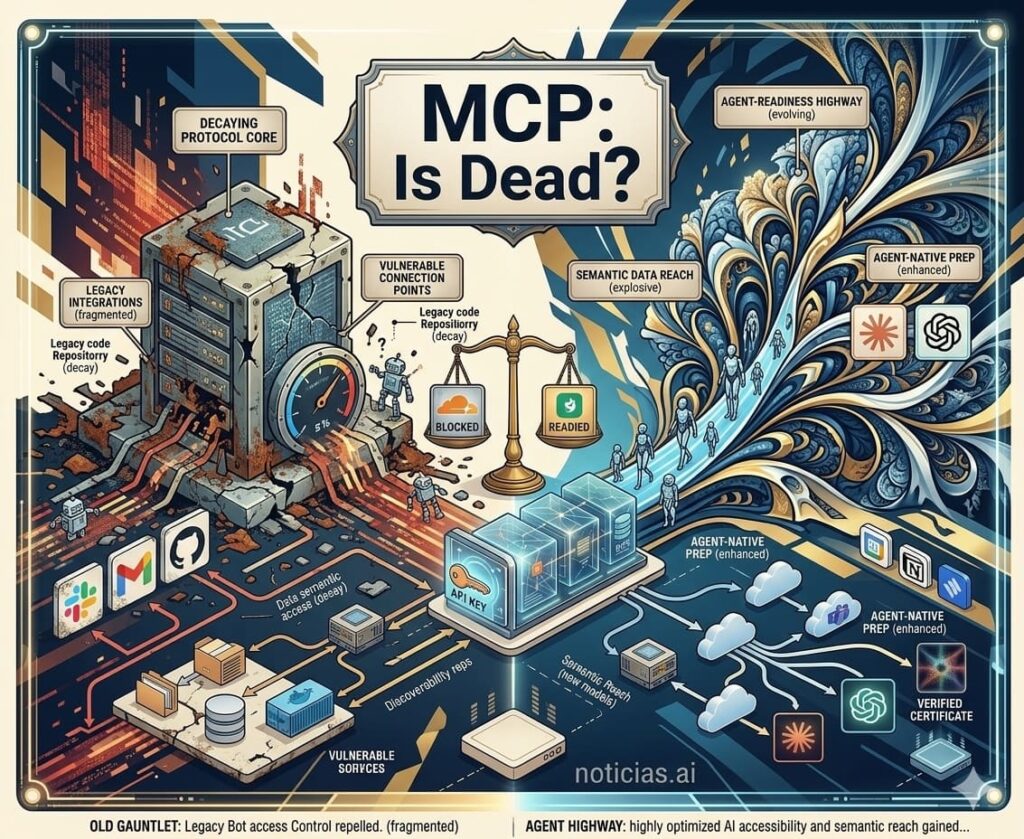

La frase «MCP is dead» sirve como titular pegadizo, pero no resiste un repaso a la realidad del mercado en abril de 2026. El Model Context Protocol que impulsa Anthropic mantiene una hoja de ruta activa, una especificación oficial vigente y un registro público de servidores que se actualiza cada pocos días. Lo que sí está perdiendo fuerza es la idea ingenua de que basta con instalar un servidor MCP y conectarlo a Claude o ChatGPT para resolver cualquier flujo de trabajo con agentes.

El debate útil no es si el estándar sigue vivo, sino en qué fase ha entrado. Y la respuesta, con los datos en la mano, apunta a una etapa menos entusiasta y bastante más empresarial. El propio roadmap del protocolo coloca en primera línea problemas concretos de madurez: transporte escalable, sesiones resilientes, comunicación entre agentes, gobernanza y preparación para entornos corporativos. Quien escribe esa hoja de ruta no actúa como si el trabajo estuviera cerrado, sino como si quedase la parte aburrida del estándar.

El problema real no es la muerte de MCP, sino su coste de operación

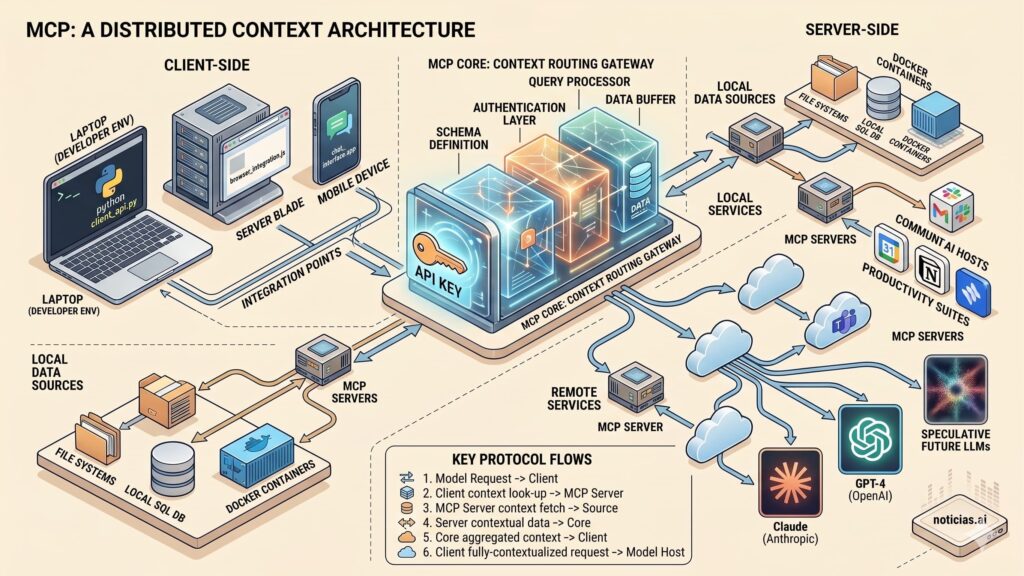

MCP nació en noviembre de 2024 con una promesa clara por parte de Anthropic: ofrecer un canal estandarizado entre aplicaciones de IA y sistemas externos. Algo así como un puerto común para herramientas, datos, archivos y servicios. La documentación oficial lo describe como un estándar abierto que permite a modelos como Claude conectarse a bases de datos, repositorios, calculadoras o buscadores sin reinventar cada integración.

El concepto suena bien. La práctica es más áspera. Un servidor MCP añade una capa propia de transporte, autenticación, definición de herramientas, permisos, observabilidad y mantenimiento. Eso no convierte al protocolo en un fracaso, pero sí encarece su despliegue. Los equipos que llevan unos meses operando con MCP en producción suelen llegar a la misma conclusión: aquí no hay varita mágica, hay una pieza más de infraestructura que conviene justificar antes de meterla en el stack. La propia hoja de ruta lo reconoce de forma indirecta cuando prioriza transporte escalable, sesiones persistentes y gobernanza.

Un ejemplo simple: levantar un servidor MCP para exponer dos herramientas internas con un único caso de uso muy estable suele resultar más caro y frágil que una integración directa por API. En cambio, cuando hablamos de varios asistentes que tienen que hablar con CRMs, repositorios, almacenes de datos y pasarelas de pago manteniendo permisos coherentes, el cálculo cambia. Ahí MCP empieza a compensar. No porque la documentación lo diga, sino porque el coste de mantener cinco integraciones a medida supera al de adoptar un único estándar abierto.

Las grandes plataformas no se alejan: se acercan

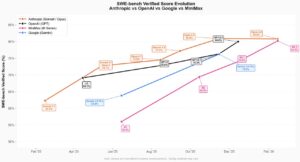

Si MCP estuviera en retirada, costaría explicar lo que está pasando con OpenAI, Anthropic, Microsoft y compañía. OpenAI documenta soporte para MCP remoto en su Responses API y publica guías para construir servidores compatibles tanto con ChatGPT como con integraciones externas. Además, ChatGPT Business y ChatGPT Enterprise/Edu han comenzado a desplegar un developer mode pensado para crear, probar y publicar conectores MCP con capacidades de lectura y escritura. En la misma dirección apunta Google Cloud Next 26 con su empresa agéntica entrando en producción, otra señal de que los grandes vendors apuestan por agentes y estándares abiertos como pilar de la próxima ola corporativa.

Anthropic mantiene la línea original. Claude Code y NotebookLM ya se usan juntos vía MCP para investigar documentos largos sin disparar el consumo de tokens. La documentación de Claude Code incluye comandos específicos como /mcp, gestión de servidores en VS Code y persistencia de configuraciones en .mcp.json. La compañía sigue describiendo MCP como el estándar abierto para conectar aplicaciones de IA con sistemas externos, sin matices.

El movimiento alcanza también a la capa de orquestación. Proyectos como NanoClaw v2 apuestan por correr agentes en contenedores con memoria compartida y control humano, y MCP se cuela como uno de los caminos naturales para que esos agentes hablen con el resto del software de la empresa. Algo parecido sucede con Snowflake Intelligence y Cortex Code, que aspira a convertirse en el centro de control de la empresa agéntica. Ninguno de estos productos describiría a MCP como tecnología en retirada.

El registro oficial de servidores MCP sigue activo y la gobernanza pública del proyecto publica con regularidad notas de los mantenedores y propuestas de evolución. La actividad de la comunidad no encaja con la imagen de un estándar moribundo, sino con la de un protocolo que está pasando del prototipo al despliegue serio.

¿Qué está cambiando entonces?

La expectativa. Durante el último año, MCP se vendió casi como el «USB-C de la IA», una metáfora que la propia Anthropic sigue empleando. La comparación tiene un problema serio: oculta la parte difícil. En el mundo real no basta con enchufar y usar. Hay que resolver permisos por usuario, latencia entre llamadas, descubrimiento de herramientas, autenticación con identidades corporativas, estado de sesión, límites de uso y trazabilidad para auditoría. En un prototipo de fin de semana todo eso parece manejable. En una empresa con varios equipos, varios proveedores y varios clientes, ya no.

Por eso el mercado está separando dos preguntas que antes se confundían. Una: si MCP tiene futuro como estándar. Hoy la evidencia apunta a que sí. Otra: si todo producto basado en IA necesita MCP. Aquí la respuesta es mucho más matizada. Muchos flujos sencillos seguirán funcionando mejor con integraciones directas, herramientas nativas o conectores cerrados. MCP empieza a justificar su complejidad cuando el problema real es la interoperabilidad entre múltiples sistemas, asistentes o equipos. Esa es la frontera que se está dibujando en 2026.

La crítica de UX Planet, en su sitio

La tesis publicada en UX Planet aporta un correctivo útil contra el entusiasmo desbordado. Acierta al recordar que MCP introduce una capa extra de complejidad y que no siempre es la mejor opción para un trabajo concreto de diseño o de producto. Convertir esa crítica en una declaración de defunción, sin embargo, exagera. Mientras OpenAI extiende soporte MCP en ChatGPT y su API, Anthropic lo mantiene en Claude Code, Microsoft empuja agentes en Copilot Studio y el protocolo publica una hoja de ruta enfocada en escalarlo para entornos reales, hablar de fase terminal queda lejos de los hechos.

La lectura más razonable hoy es otra: MCP no ha muerto, ha dejado de ser una moda fácil para convertirse en una tecnología de infraestructura. Eso significa dos cosas a la vez. Por un lado, que va a seguir creciendo, porque resuelve un problema real de interoperabilidad. Por otro, que exige más criterio arquitectónico, más gobierno y más disciplina de producto que la que muchos prometían cuando lo presentaban como solución casi automática. Una conversación parecida atraviesa al sector con los agentes de IA aplicados al trabajo diario: la promesa es enorme, la implantación pide oficio.

Preguntas frecuentes

¿MCP está realmente en retirada en 2026?

No. El protocolo mantiene especificación oficial, un roadmap activo y un registro público de servidores que se actualiza con frecuencia. OpenAI y Anthropic siguen integrándolo en sus productos comerciales, así que la evidencia apunta a un estándar en consolidación, no en descomposición.

¿Por qué muchos desarrolladores se quejan de que MCP complica las cosas?

Porque añade capas de configuración, autenticación, gestión de sesiones, permisos y mantenimiento que no siempre compensan en flujos sencillos. El propio roadmap del estándar pone esos problemas de escalado y gobernanza como prioridad, lo que confirma que la queja tiene fundamento.

¿Cuándo merece la pena adoptar MCP en una empresa?

Cuando una aplicación o un agente tiene que trabajar con varias herramientas y fuentes externas de forma estandarizada y cuando hay más de un asistente o más de un equipo en la ecuación. Para integraciones cerradas y muy estables, una API directa puele resultar más simple y barata.

¿Qué está haciendo OpenAI con MCP en 2026?

OpenAI documenta soporte MCP en la Responses API y ha empezado a desplegar conectores MCP en ChatGPT Business y Enterprise/Edu mediante un developer mode que permite crear, probar y publicar conectores con capacidades de lectura y escritura.

¿Y Anthropic?

Anthropic sostiene MCP como pieza estructural de Claude Code y de su discurso de plataforma. La gestión de servidores MCP, los comandos específicos en la CLI y el almacenamiento de configuraciones en .mcp.json forman parte del flujo habitual de trabajo con Claude.

¿MCP es la única forma seria de integrar IA con software corporativo?

No. Sigue habiendo casos donde una API directa, un conector cerrado o una herramienta nativa funcionan mejor, sobre todo cuando el problema está acotado. MCP gana terreno cuando hace falta una capa común y reutilizable entre varios productos, no cuando solo hay que conectar dos sistemas concretos.