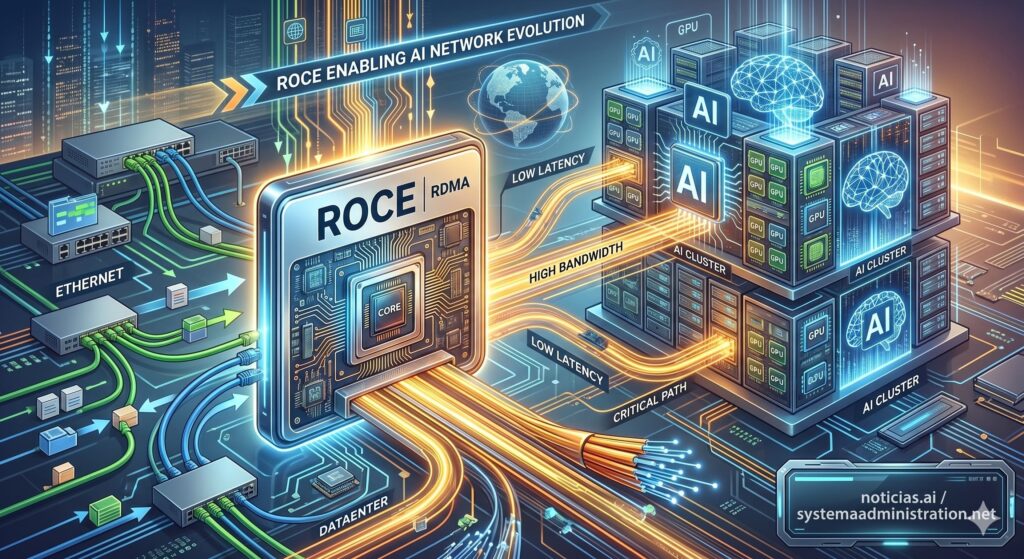

La carrera por la inteligencia artificial no se decide solo en GPUs, modelos fundacionales o centros de datos de varios cientos de megavatios. Cada vez depende más de algo menos visible, pero igual de determinante: la red que conecta miles de aceleradores para que trabajen como si fueran una sola máquina. En ese punto, Ethernet está viviendo una segunda juventud gracias a RoCE, RDMA over Converged Ethernet.

Durante décadas, Ethernet fue la red fiable, barata y ubicua del centro de datos. Movía paquetes, aceptaba pérdidas puntuales y dejaba que TCP hiciera el trabajo de retransmitir cuando algo fallaba. Los clusters de IA han cambiado las reglas. Entrenar o servir modelos a gran escala exige mover datos entre GPUs con latencias de microsegundos, alto ancho de banda y un comportamiento mucho más predecible. Ya no basta con que la red esté disponible; tiene que comportarse casi como una extensión de la memoria.

Por qué la IA necesita una red distinta

En un cluster de entrenamiento distribuido, miles de GPUs calculan en paralelo, intercambian gradientes, sincronizan estados y esperan a que la red no se convierta en el cuello de botella. Si una parte del cluster se retrasa, el rendimiento global cae. Da igual que las GPUs sean muy potentes si pasan demasiado tiempo esperando datos.

RoCE permite que los servidores usen RDMA sobre Ethernet. Esto reduce la intervención de la CPU y del sistema operativo en las transferencias, de forma que los nodos pueden intercambiar datos con menor latencia y menos sobrecarga. Para la IA, esa diferencia importa porque muchas cargas no solo consumen ancho de banda, sino que dependen de comunicaciones repetidas, intensivas y coordinadas.

Google Cloud lo ha incorporado en sus máquinas A3 Ultra y A4 para comunicación entre nodos y tráfico GPU a GPU. Según la documentación de Google, estas instancias pueden entregar 3,2 Tbps de tráfico inter-nodo GPU-to-GPU mediante RoCE, una cifra que muestra la escala de red que empiezan a exigir las plataformas de IA modernas.

Meta también ha mostrado el alcance de este cambio. La compañía ha documentado sus despliegues de RoCE para entrenamiento distribuido y ha explicado que usa RoCEv2 como transporte inter-nodo para una parte mayoritaria de su capacidad de IA. Además, detalló dos clusters de 24.576 GPUs NVIDIA H100 para Llama 3, uno sobre RoCE y otro sobre InfiniBand, ambos con endpoints a 400 Gbps.

| Tecnología | Enfoque | Ventajas principales | Retos principales |

|---|---|---|---|

| Ethernet tradicional | Red best-effort para tráfico general | Coste, interoperabilidad, madurez, base instalada | Pérdidas aceptadas, latencia variable, recuperación vía TCP |

| RoCEv2 sobre Ethernet | RDMA sobre Ethernet para baja latencia | Menor sobrecarga de CPU, alto rendimiento, integración con Ethernet | Requiere tuning de PFC, ECN, buffers y congestión |

| InfiniBand | Fabric HPC especializada | Latencia muy baja, RDMA maduro, stack integrado | Mayor dependencia de proveedor y menor ubicuidad que Ethernet |

| Ultra Ethernet | Evolución Ethernet para IA y HPC | Busca mejorar escalabilidad, multipath y transporte extremo | Todavía en maduración frente a despliegues RoCE actuales |

PFC y ECN: las dos piezas que hacen posible el salto

El gran cambio técnico es que RoCE necesita una Ethernet prácticamente sin pérdidas en las clases de tráfico críticas. Esto no significa que se eliminen todos los riesgos, sino que la red se diseña para evitar descartes antes de que ocurran. En una red convencional, si se pierde un paquete, TCP retransmite. En tráfico RDMA a escala, esa pérdida puede perjudicar operaciones coordinadas entre muchas GPUs.

Para lograrlo se usan mecanismos conocidos por los ingenieros de redes, pero ahora aplicados con una exigencia mucho mayor. PFC, Priority Flow Control, permite pausar de forma selectiva una clase de tráfico cuando una cola se llena. ECN, Explicit Congestion Notification, marca paquetes antes de que se descarten para que el emisor reduzca el ritmo. Juntas, estas tecnologías ayudan a que Ethernet soporte tráfico RDMA con latencias bajas y menor riesgo de pérdida.

El problema es que no basta con activar dos opciones en un switch. PFC mal ajustado puede propagar congestión o provocar bloqueo de cabecera. ECN requiere umbrales bien definidos y coordinación con los endpoints. Los buffers deben dimensionarse con cuidado. La telemetría tiene que observar microbursts, marcas ECN, eventos PFC, colas, drops por prioridad y comportamiento de las librerías de comunicación usadas por las cargas de IA.

En otras palabras, la red deja de ser una capa genérica y se convierte en una parte del sistema de cómputo. El ingeniero de redes que antes diseñaba VLANs, QoS para voz o fabrics leaf-spine para virtualización ahora necesita entender cómo se comportan NCCL, las GPUs, las NICs, los drivers, el scheduler y los patrones de tráfico de entrenamiento.

Ethernet frente a InfiniBand: no es una guerra simple

InfiniBand sigue siendo una tecnología muy sólida para HPC e IA. Tiene baja latencia, semánticas RDMA maduras y una integración profunda en entornos de alto rendimiento. Durante años ha sido la opción natural para clusters donde el rendimiento extremo justificaba un stack más especializado.

Ethernet, sin embargo, tiene una ventaja económica y operativa difícil de ignorar: está en todas partes. Hay más proveedores, más experiencia acumulada, más herramientas, más competencia y una base instalada enorme. Para los hiperescalares, esto no es un detalle menor. Cuando se construyen clusters de decenas de miles de GPUs, la capacidad de elegir proveedores, reducir dependencia y aprovechar un estándar extendido puede pesar tanto como unos puntos de rendimiento.

NVIDIA lo ha entendido bien con Spectrum-X, una plataforma Ethernet para IA que combina SuperNICs, conectividad RoCE, control de congestión, telemetría y aislamiento de rendimiento. Aunque NVIDIA domina InfiniBand tras la integración de Mellanox, también está empujando Ethernet como pieza central para fábricas de IA a gran escala.

Broadcom sigue una línea similar desde otro ángulo. Sus chips Tomahawk y Jericho están pensados para redes Ethernet de muy alta capacidad en centros de datos de IA. Reuters recogió que Tomahawk 6 está diseñado para sistemas con más de 100.000 GPUs y que Broadcom prevé escenarios futuros con hasta un millón de GPUs en un único edificio físico.

| Criterio | Ethernet con RoCE | InfiniBand |

|---|---|---|

| Ecosistema | Muy amplio, multivendor, basado en estándares Ethernet | Más especializado y muy integrado |

| Operación | Familiar para equipos de red, pero exige tuning avanzado | Stack diseñado para HPC y RDMA desde el origen |

| Coste y disponibilidad | Puede beneficiarse de economías de escala Ethernet | Puede ser más dependiente de proveedor y disponibilidad específica |

| Rendimiento | Muy alto si la fabric está bien diseñada | Muy alto y maduro en baja latencia |

| Encaje en IA | Gana peso en hiperescalares y clouds | Sigue fuerte en entrenamiento y HPC extremo |

Qué cambia para los centros de datos de IA

El impacto no se queda en los switches. Si Ethernet se convierte en una fabric crítica para IA, cambia la forma de diseñar centros de datos. Hay que pensar en topologías más simétricas, múltiples rails, separación de tráfico, cableado de alta densidad, óptica de 400G y 800G, consumo energético de la red, refrigeración y observabilidad casi en tiempo real.

También cambia el perfil del equipo técnico. La red de IA ya no se mide solo por disponibilidad o throughput agregado. Se mide por cómo afecta al tiempo de entrenamiento, a la eficiencia de las GPUs, al coste por token y a la capacidad de escalar sin que aparezcan colas invisibles. Una GPU de alto coste esperando datos por una mala configuración de red es dinero parado.

La aparición de Ultra Ethernet confirma que el sector ve límites en el RoCE actual y quiere evolucionar Ethernet para IA y HPC. La especificación busca mejorar aspectos como escalabilidad, multipath y transporte en sistemas extremos, manteniendo compatibilidad con el ecosistema Ethernet. RoCE no desaparece; actúa como puente entre la Ethernet conocida y la red optimizada que demandan las próximas fábricas de IA.

Este punto es importante para un medio de inteligencia artificial porque explica algo que a menudo se queda fuera del foco. Los avances en modelos no dependen solo de más parámetros o más datos. Dependen de redes capaces de mantener ocupadas a miles de GPUs durante semanas o meses. Cuando la red falla, el modelo tarda más, cuesta más y escala peor.

La nueva infraestructura de IA se construye también en la red

La conversación pública sobre IA suele concentrarse en NVIDIA, OpenAI, Anthropic, Google, Meta o los grandes modelos. Pero por debajo hay una transición industrial igual de profunda. La red del centro de datos se está rediseñando para que la memoria, el cómputo y el almacenamiento trabajen con una coordinación mucho más estrecha.

Ethernet tiene una oportunidad enorme porque combina escala, madurez y apertura. Pero esa oportunidad exige un nivel de ingeniería que no se improvisa. Diseñar una fabric RoCE estable para IA no es lo mismo que montar una red corporativa tradicional. Requiere laboratorio, pruebas de carga, telemetría detallada, coordinación entre equipos de sistemas y red, y una comprensión fina de cómo se comportan los workloads reales.

Para las empresas que quieran construir infraestructura de IA, esta será una decisión estratégica. Podrán comprar GPUs, alquilar capacidad o desplegar clusters propios. Pero si quieren entrenar o servir modelos con eficiencia, tendrán que mirar la red como una parte del producto, no como una capa secundaria.

RoCE resume bien la nueva etapa. Ethernet, la tecnología que durante años movió paquetes sin demasiado protagonismo, se ha convertido en una de las piezas que decidirán cuánto cuesta entrenar y ejecutar inteligencia artificial a gran escala. La IA no solo está cambiando el software. Está cambiando la forma en la que diseñamos las redes.

Preguntas frecuentes

¿Qué es RoCE en inteligencia artificial?

RoCE es RDMA over Converged Ethernet. Permite acceso directo a memoria remota sobre Ethernet y reduce la intervención de la CPU en transferencias entre servidores, algo muy útil en clusters de GPUs.

¿Por qué RoCE necesita una red casi sin pérdidas?

Porque las cargas de entrenamiento distribuido son muy sensibles a pérdidas, congestión y latencia. Una pérdida puntual puede afectar a operaciones coordinadas entre muchas GPUs.

¿Qué hacen PFC y ECN?

PFC pausa clases de tráfico concretas cuando hay congestión. ECN marca paquetes antes de que se descarten para que el emisor reduzca el ritmo. Ambas ayudan a sostener tráfico RDMA sobre Ethernet.

¿Ethernet va a sustituir a InfiniBand en IA?

No necesariamente. InfiniBand seguirá siendo relevante en HPC e IA de alto rendimiento. Ethernet con RoCE está ganando peso porque ofrece apertura, escala, más proveedores y mejor encaje con infraestructuras cloud masivas.