La idea de ejecutar un asistente de programación avanzado sin depender de la nube, sin cuotas mensuales y sin sacar el código del portátil lleva tiempo rondando el mundo del desarrollo. Lo que hasta hace poco parecía más un experimento de laboratorio que una opción práctica empieza a tomar forma en proyectos como Claude Code Local, un repositorio de GitHub que propone algo bastante ambicioso: usar Claude Code sobre modelos locales en Apple Silicon, con MLX como base de inferencia y un servidor que emula la API de Anthropic en local. El proyecto está publicado bajo licencia MIT y se presenta como una pila “local-first” pensada para desarrollo, automatización, navegación web y hasta interacción por voz, todo en el propio Mac.

Lo más interesante aquí no es solo el discurso de privacidad, sino el enfoque técnico. Anthropic documenta oficialmente que Claude Code puede funcionar con una LLM gateway mediante variables como ANTHROPIC_BASE_URL, es decir, a través de una capa compatible que redirige las peticiones a otro endpoint. Claude Code Local aprovecha precisamente esa posibilidad para sustituir el backend remoto por un servidor local que habla el formato esperado por Claude Code y lo conecta con modelos que corren directamente sobre la GPU integrada del Mac. No es un producto oficial de Anthropic, ni Anthropic respalda los modelos que usa, pero sí se apoya en un mecanismo compatible con la forma en que Claude Code está diseñado para trabajar con gateways.

Qué promete exactamente este proyecto

El repositorio plantea cuatro modos de uso: programación con Claude Code, agente de navegador, modo manos libres por voz y una variante de control remoto desde el teléfono. En la parte puramente técnica, la pieza central es un servidor en Python que usa MLX y mlx-lm para cargar modelos locales sobre Apple Silicon. Apple describe MLX como un framework optimizado para la memoria unificada de sus chips y pensado para ejecutarse sobre Metal, algo que encaja bien con la obsesión del proyecto por exprimir al máximo MacBook y Mac Studio sin salir del entorno local.

Claude Code Local ofrece tres “cerebros” principales: Gemma 4 31B, Llama 3.3 70B y Qwen 3.5 122B-A10B, todos en variantes preparadas para MLX. El propio README recomienda 32 GB de RAM como mínimo para Gemma 31B y 96 GB para los modelos más grandes, además de reservas de disco que pueden ir de 18 GB a 75 GB. En otras palabras, esto no está pensado para cualquier Mac básico, sino sobre todo para equipos con bastante memoria unificada, especialmente gamas Max o Ultra.

También hay un componente claramente experimental y, en algunos casos, polémico. El proyecto distribuye versiones “abliterated” de algunos modelos, término que el propio repositorio define como una forma de reducir o suprimir la dirección interna de rechazo del modelo para que no se niegue con tanta facilidad a responder a determinadas peticiones. Los autores advierten que eso no supone una mejora general de capacidades y que el uso sigue sujeto a las licencias originales de cada modelo. Traducido al mundo real: es una propuesta atractiva para quienes quieren menos fricción local, pero también una bandera roja para cualquier entorno corporativo, regulado o sensible.

Rendimiento, privacidad y las matizaciones necesarias

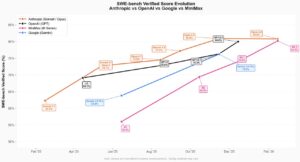

Uno de los grandes reclamos del proyecto son sus cifras de rendimiento. El repositorio afirma que su tercera generación, basada en servidor MLX nativo, alcanza hasta 65 tokens por segundo en Qwen 3.5 122B-A10B sobre un M5 Max con 128 GB, y que una tarea real en Claude Code bajó de 133 segundos a 17,6 segundos al eliminar el proxy y hablar directamente el formato de Anthropic desde el servidor local. También aparecen cifras previas de 41 tok/s asociadas a una fase con llama.cpp + TurboQuant, lo que indica que el proyecto mezcla varias generaciones de benchmark en la misma narrativa. Son números interesantes, pero conviene subrayar que proceden del propio repositorio y no de una auditoría independiente.

El otro gran argumento es la privacidad. El proyecto insiste en que el código no sale del Mac, que no hay telemetría y que no hay llamadas salientes de red más allá de localhost. Técnicamente, esa promesa es coherente con el planteamiento del stack: servidor local, modelos locales y Claude Code apuntando a un endpoint local. Sin embargo, el tono del repositorio va más allá de una simple arquitectura privada y lo convierte en un manifiesto “anti-cloud”. Ahí conviene ser prudente. Que el modelo corra en local reduce riesgos de exposición y elimina costes por API, sí, pero no convierte automáticamente el sistema en apto para cualquier entorno empresarial ni sustituye por sí solo controles de seguridad, gestión de secretos o gobierno del dato.

Hay además una parte especialmente llamativa: el modo de voz manos libres. El proyecto lo vincula a un repositorio hermano y utiliza SFSpeechRecognizer en macOS para captura de voz, además de TTS local para devolver respuestas habladas. Apple documenta el framework Speech y ha explicado públicamente que su reconocimiento puede funcionar en local en determinados contextos y dispositivos, pero aquí de nuevo la experiencia final depende de idioma, configuración y de cómo se haya montado toda la canalización alrededor de esa API. El proyecto lo vende como una experiencia completamente local, y técnicamente puede serlo, pero no es una capacidad que Claude Code ofrezca de serie.

Lo que significa de verdad

Más allá del entusiasmo del README, Claude Code Local señala una tendencia real: Claude Code ya no se entiende solo como un cliente ligado a los modelos de Anthropic en la nube, sino como una interfaz que muchos desarrolladores quieren reutilizar con otros backends, gateways y modelos locales. Esa apertura, aunque sea indirecta, está generando un pequeño ecosistema de compatibilidad alrededor del terminal y del flujo de trabajo de Claude Code.

La gran pregunta no es si este tipo de proyectos pueden funcionar, porque ya está claro que sí. La cuestión es para quién tienen sentido. Para desarrolladores individuales, laboratorios caseros, entornos sin conexión o trabajo con código muy sensible, la propuesta es muy atractiva. Para empresas que necesiten trazabilidad, soporte formal, garantías de seguridad o razonamiento al nivel de los mejores modelos cloud, el entusiasmo debería ser bastante más moderado. El propio repositorio reconoce, de hecho, que para “Claude-level reasoning” el cloud sigue teniendo ventaja.

En resumen, Claude Code Local no es tanto una alternativa universal a Claude en la nube como una demostración de hasta dónde está llegando el ecosistema local en Apple Silicon. Y eso, por sí solo, ya lo convierte en uno de los proyectos más interesantes del momento para seguir la evolución de la IA en el escritorio.

Preguntas frecuentes

¿Se puede usar Claude Code con modelos locales de verdad?

Sí, al menos mediante una capa compatible. Anthropic documenta que Claude Code puede funcionar con gateways LLM usando ANTHROPIC_BASE_URL, y proyectos como Claude Code Local aprovechan esa vía para redirigir las peticiones a un servidor local.

¿Qué Mac hace falta para mover Claude Code Local?

Según el propio proyecto, Gemma 4 31B puede arrancar desde 32 GB de RAM, mientras que Llama 3.3 70B y Qwen 3.5 122B-A10B se orientan a equipos con 96 GB o más.

¿Es realmente más rápido que usar Claude en la nube?

El repositorio afirma que en algunos escenarios alcanza hasta 65 tok/s y supera en velocidad bruta a ciertos modos cloud, pero esas cifras son internas del proyecto y no equivalen a una comparación independiente y universal.

¿Qué significa que un modelo sea “abliterated”?

Según el repositorio, significa que se ha reducido la tendencia del modelo a rechazar ciertas peticiones. No es una mejora general de capacidad y puede introducir riesgos claros en seguridad, cumplimiento y uso responsable.

Más información en el GitHub de Claude Code Local.