La IA agéntica ha cambiado el problema técnico de la inferencia. Ya no se trata solo de responder a una petición aislada con el mayor número posible de tokens por segundo. Un agente puede consultar herramientas, dividir una tarea en subtareas, invocar otros agentes, mantener contexto durante cientos de pasos y generar decisiones encadenadas. Cada una de esas acciones añade llamadas al modelo, lectura de memoria, movimiento de datos y latencia acumulada.

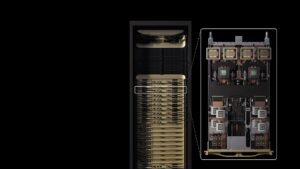

NVIDIA intenta atacar ese problema con la plataforma Vera Rubin y, en especial, con la combinación de Vera Rubin NVL72 y NVIDIA Groq 3 LPX. La propuesta une GPUs Rubin, CPUs Vera, memoria HBM4, interconexión NVLink, el software NVIDIA Dynamo y aceleradores LPU diseñados para baja latencia. La tesis de la compañía es clara: para que los sistemas multiagente sean viables a escala, la infraestructura de IA necesita ser rápida, pero también predecible.

Por qué la IA agéntica rompe el modelo clásico de inferencia

Los centros de datos de IA se han optimizado durante años para entrenamiento masivo y para inferencia de gran volumen. En esos escenarios, los lotes grandes ayudan a amortiguar parte de las variaciones de red y a mantener alto el uso de los aceleradores. La IA agéntica introduce una dinámica distinta. Las sesiones son más largas, los lotes pueden ser más pequeños y el usuario percibe cada retraso como parte de una conversación o de una tarea en marcha.

El problema se agrava con modelos Mixture-of-Experts (MoE), ventanas de contexto muy largas y sistemas que manejan cachés KV crecientes. En una sesión multiagente, cada agente puede acumular historial, instrucciones, herramientas disponibles y memoria de trabajo. Esa información debe moverse entre chips, capas del modelo y expertos especializados. Si la comunicación entre aceleradores introduce variabilidad, la latencia de cola se dispara.

NVIDIA plantea que el viejo enfoque, basado en redes de centro de datos que resuelven contención y flujo en tiempo de ejecución, no basta para estos casos de uso premium. El objetivo ya no es solo que el sistema sea rápido de media, sino que mantenga tiempos de respuesta estables cuando miles de chips coordinan inferencia sobre modelos enormes.

Ahí aparece NVIDIA Groq 3 LPX. La arquitectura LPU C2C busca extender un modelo de ejecución determinista entre muchos LPUs, con enlaces punto a punto de alta radix, movimiento de datos planificado por compilador y temporización plesiosíncrona. En lugar de dejar que la red decida dinámicamente cómo resolver cada transferencia, el compilador programa de antemano cuándo sale cada vector, qué enlace usa y cuándo debe llegar.

LPX: SRAM, determinismo y comunicación programada

El componente más llamativo de Groq 3 LPX es su enfoque basado en SRAM y ejecución determinista. Cada LPU expone 96 enlaces C2C a 112 Gbps, con unos 2,5 TB/s de ancho de banda de escalado por LPU y hasta 640 TB/s a nivel de rack. En la configuración LPX citada por NVIDIA, el sistema escala hasta 256 LPUs, con un pool unificado de 128 GB de SRAM.

La SRAM es mucho más rápida y predecible que la memoria externa, pero también más limitada en capacidad. Por eso el reto está en agrupar muchos chips para que funcionen como una superficie de ejecución común. NVIDIA describe el sistema como algo más cercano a conectar unidades funcionales dentro de un gran procesador que a coordinar chips independientes sobre una red convencional.

La temporización plesiosíncrona ayuda a mantener alineados miles de LPUs aunque cada chip tenga su propio reloj. Al controlar la deriva y conocer las latencias en tiempo de compilación, el sistema puede reducir buffers defensivos y minimizar jitter. Para cargas agénticas, donde cada token puede depender de decisiones previas y de intercambios frecuentes entre componentes, esa previsibilidad puede ser tan importante como el rendimiento bruto.

La propuesta no sustituye a las GPUs Rubin. Las complementa. Vera Rubin NVL72 actúa como motor principal de cómputo y memoria para la inferencia de gran escala. Según NVIDIA, un rack Vera Rubin NVL72 ofrece hasta 3.600 PFLOPS de cómputo NVFP4, 20,7 TB de HBM4 y 1,6 PB/s de ancho de banda de memoria. Esa capacidad encaja mejor con fases de prefill, atención sobre contextos largos y servicio concurrente de alto volumen.

El papel de LPX aparece cuando la latencia se vuelve crítica. NVIDIA Dynamo coordina ambos mundos mediante Attention-FFN Disaggregation. En ese esquema, las GPUs Rubin gestionan la atención y el trabajo asociado a la caché KV, mientras LPX acelera la ejecución FFN en el bucle de decodificación. Las activaciones intermedias se intercambian token a token con transferencias conscientes de la caché KV.

La promesa: 400 tokens por segundo por usuario en modelos enormes

La cifra que NVIDIA usa para explicar el salto es ambiciosa: hasta 400 tokens por segundo por usuario en modelos MoE del orden del billón de parámetros y con contexto de 400.000 tokens. La compañía también afirma que la combinación Vera Rubin + LPX puede ofrecer hasta 35 veces más throughput por megavatio que GB200 NVL72 en este tipo de cargas y desbloquear hasta 10 veces más oportunidad de ingresos para servicios agénticos.

Estas cifras deben leerse como estimaciones del fabricante y dependerán del modelo, tamaño de contexto, patrón de agentes, lote, software, red, consumo real y precio del servicio. Aun así, la dirección técnica es relevante. NVIDIA está reconociendo que la siguiente etapa de la IA no se resolverá solo con GPUs cada vez más grandes. Harán falta arquitecturas heterogéneas, memoria especializada, interconexiones más predecibles y software capaz de partir el trabajo entre motores distintos.

| Componente | Papel dentro de la plataforma |

|---|---|

| Vera Rubin NVL72 | Cómputo principal, HBM4, prefill, atención y alta concurrencia |

| NVIDIA Groq 3 LPX | Baja latencia, ejecución FFN y decodificación sensible al jitter |

| NVIDIA Dynamo | Orquestación del serving y desagregación Attention-FFN |

| LPU C2C | Interconexión determinista entre LPUs |

| NVLink | Escalado de alto ancho de banda en la parte GPU |

| HBM4 y SRAM | Dos memorias con perfiles distintos: capacidad y ancho de banda frente a latencia determinista |

La lectura estratégica es clara. Los modelos agénticos consumen más tokens, mantienen más contexto y ejecutan más pasos por tarea. Si el coste por interacción sube demasiado o la latencia se vuelve imprevisible, muchos servicios no serán rentables ni agradables para el usuario. NVIDIA intenta convertir esa complejidad en una oportunidad para vender una plataforma completa de “AI factory”, no solo chips sueltos.

El movimiento también encaja con una tendencia mayor del mercado: especializar la infraestructura de inferencia. Durante la primera ola de la IA generativa, la GPU se convirtió en el símbolo absoluto del sector. En la siguiente fase, la pregunta será qué combinación de GPU, ASIC, memoria, red y software sirve mejor cada parte del modelo. LPX es una respuesta a esa pregunta: usar aceleradores de ejecución determinista donde la latencia manda y dejar a Rubin las fases donde pesan más el ancho de banda y la capacidad de memoria.

Queda por ver cómo se trasladan estas promesas a despliegues reales. Los clientes tendrán que evaluar coste total, consumo, disponibilidad, compatibilidad de software, madurez de Dynamo y facilidad para adaptar modelos MoE a esta división de trabajo. También habrá que comprobar si la ventaja se mantiene más allá de los escenarios descritos por NVIDIA.

Lo importante es que el debate de la IA ya se está moviendo. La escala no solo significa más GPUs. Significa coordinar miles de chips con menos variabilidad, mover contexto sin ahogar el sistema y producir tokens con una economía que permita servicios agénticos de pago. En esa batalla, la latencia deja de ser un detalle técnico y pasa a ser una variable de negocio.

Preguntas frecuentes

¿Qué es NVIDIA Vera Rubin?

NVIDIA Vera Rubin es una plataforma de próxima generación para infraestructura de IA que combina GPUs Rubin, CPUs Vera, NVLink, HBM4 y software de orquestación para cargas avanzadas de entrenamiento e inferencia.

¿Qué aporta Groq 3 LPX?

Groq 3 LPX es un acelerador de baja latencia basado en LPUs y SRAM. Está diseñado para ejecutar partes sensibles al jitter en cargas de inferencia agéntica, especialmente en modelos MoE grandes y con contexto largo.

¿Qué es NVIDIA Dynamo?

NVIDIA Dynamo es la capa de software que orquesta el serving de inferencia. En este enfoque coordina GPUs Vera Rubin y LPX mediante desagregación de atención y FFN para repartir mejor el trabajo.

¿Por qué la IA agéntica necesita redes más predecibles?

Porque una sesión agéntica puede generar cientos de llamadas al modelo, herramientas y subagentes. Si cada paso añade variabilidad, la latencia final crece y empeora la experiencia del usuario.

vía: developer.nvidia