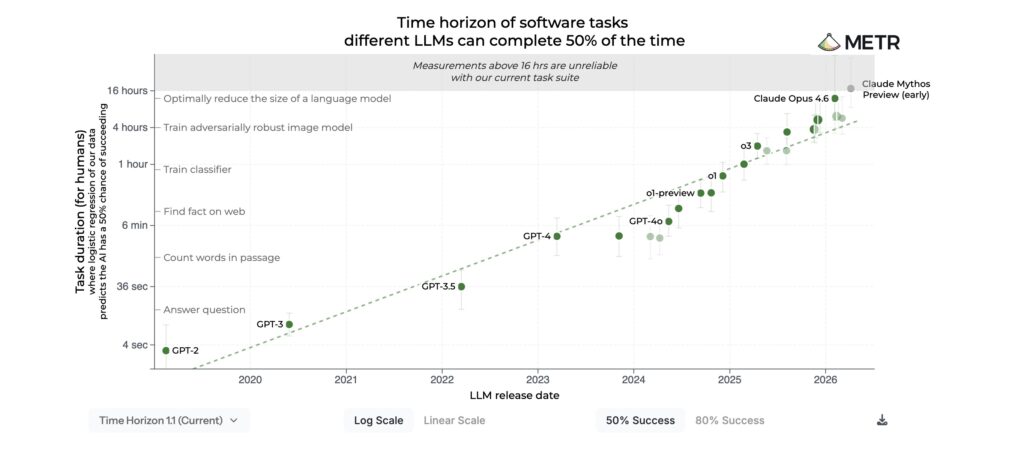

La última actualización de METR ha vuelto a mover la conversación sobre los modelos de Inteligencia Artificial desde el terreno de los benchmarks abstractos hacia una pregunta mucho más incómoda: cuánto trabajo técnico real pueden completar ya los agentes actuales. El 8 de mayo de 2026, la organización añadió a su medición de “horizonte temporal” una versión temprana de Claude Mythos Preview, el modelo de Anthropic que no está disponible de forma general y que ya se ha convertido en una de las referencias más vigiladas por investigadores de seguridad, desarrolladores y empresas tecnológicas.

La cifra que más llama la atención es que Mythos se sitúa en el borde de lo que METR puede medir con su conjunto actual de tareas. En la visualización pública, el modelo aparece con un horizonte de alrededor de tres horas en el criterio del 80 %, es decir, tareas de software que un humano experto tardaría unas tres horas en completar y que el agente podría resolver correctamente en ocho de cada diez intentos. En el criterio del 50 %, la estimación se mueve en torno a las 16 horas o más, aunque METR advierte de forma expresa que las mediciones por encima de 16 horas ya no son fiables con su batería actual de pruebas.

Qué mide METR cuando habla de “horizonte temporal”

El concepto puede prestarse a confusión. METR no mide cuánto tiempo está funcionando un agente de Inteligencia Artificial de forma autónoma, sino la duración humana estimada de las tareas que ese agente puede completar con cierta probabilidad de éxito. Una tarea de “dos horas”, en este marco, no significa que el modelo trabaje dos horas seguidas, sino que se enfrenta a un problema que a un profesional humano, con poca información previa del contexto, le llevaría aproximadamente ese tiempo.

La metodología combina tareas de software, aprendizaje automático y ciberseguridad. Primero se estima cuánto tarda una persona con experiencia en resolver cada tarea. Después se ejecutan los modelos con un andamiaje de agente, herramientas y bucles de interacción. Con esos resultados, METR ajusta una curva logística para calcular en qué duración de tarea el agente alcanza, por ejemplo, un 50 % o un 80 % de éxito.

La investigación original de METR ya apuntaba a una tendencia fuerte: el horizonte temporal al 50 % de éxito se ha ido duplicando aproximadamente cada siete meses desde 2019 en este tipo de tareas, con un avance atribuido a mayor fiabilidad, mejor uso de herramientas, más capacidad para corregir errores y mejor razonamiento lógico. El artículo académico asociado también subraya que modelos como o3 alcanzaban un horizonte de unas 110 minutos en su batería inicial, antes de esta nueva actualización con modelos más recientes.

La diferencia ahora es que Claude Mythos Preview parece presionar el techo del método. Cuando una evaluación avisa de que sus mediciones empiezan a ser poco fiables por encima de 16 horas, el mensaje no es solo que un modelo ha obtenido una buena puntuación. También indica que el instrumento de medida necesita tareas más largas, más variadas y más difíciles para seguir distinguiendo entre modelos de frontera.

El salto no significa automatización total, pero sí cambia el listón

Conviene leer estos resultados con prudencia. METR insiste en que sus tareas están diseñadas para ser autocontenidas, bien especificadas y con criterios claros de evaluación automática. Eso las hace más comparables y medibles, pero también más limpias que buena parte del trabajo real en una empresa, donde pesan el contexto acumulado, las decisiones ambiguas, la coordinación con otras personas, las prioridades cambiantes y los criterios de calidad que no siempre se pueden convertir en una prueba automática.

La propia organización advierte de que un horizonte de ocho horas no significa que una Inteligencia Artificial pueda automatizar todos los empleos ni reemplazar una jornada completa de un profesional con experiencia en su propio proyecto. La medición se parece más a lo que podría hacer una persona cualificada pero con poco contexto, como un nuevo fichaje o un contratista externo, no necesariamente un responsable técnico que conoce desde hace años una base de código.

Aun así, el cambio es relevante. Hasta hace poco, muchos modelos eran útiles para fragmentos de código, pequeñas funciones, depuración sencilla o tareas de documentación. Un horizonte de varias horas con alta fiabilidad apunta a otra clase de uso: agentes capaces de encadenar pasos, probar hipótesis, modificar archivos, interpretar errores, consultar información y completar trabajos técnicos que ya no son simples ejercicios de prompt.

Para equipos de desarrollo, esto encaja con la evolución hacia flujos de trabajo más estructurados: especificaciones vivas, agentes que ejecutan tareas ordenadas, revisiones automáticas, pruebas generadas desde requisitos y controles de seguridad integrados en el ciclo de desarrollo. La Inteligencia Artificial empieza a dejar de ser solo un asistente que sugiere código y se acerca a un colaborador técnico que puede encargarse de unidades de trabajo completas, aunque todavía necesite supervisión humana.

Por qué Claude Mythos preocupa especialmente en ciberseguridad

El interés por Claude Mythos Preview no viene solo de su rendimiento en tareas de software. Anthropic ha presentado el modelo dentro de Project Glasswing, una iniciativa con socios como Amazon Web Services, Apple, Cisco, CrowdStrike, Google, Microsoft, NVIDIA, JPMorganChase, la Linux Foundation y Palo Alto Networks para aplicar estas capacidades a la defensa de software crítico. Según Anthropic, Mythos Preview es un modelo generalista no publicado que ha mostrado capacidad para encontrar y explotar vulnerabilidades por encima de la mayoría de humanos, salvo perfiles muy especializados. La compañía afirma que no prevé hacerlo disponible de forma general por ahora.

Anthropic sostiene que el modelo ya ha identificado miles de vulnerabilidades de día cero, incluidas algunas en sistemas operativos y navegadores principales. También ha comprometido hasta 100 millones de dólares en créditos de uso para Project Glasswing y donaciones adicionales a organizaciones de seguridad open source. Son afirmaciones de la propia compañía y deben leerse como parte de su comunicación pública, pero explican por qué Mythos ha despertado tanta atención en el sector.

El AI Security Institute británico también ha evaluado sus capacidades en ciberseguridad. En pruebas controladas, observó mejoras en retos CTF y en simulaciones de ataques multietapa. En un entorno llamado “The Last Ones”, una simulación de 32 pasos de ataque a una red corporativa que AISI estima en unas 20 horas de trabajo humano, Claude Mythos Preview fue el primer modelo capaz de completarla de principio a fin en 3 de 10 intentos. La misma evaluación avisa de que estos entornos no equivalen a redes bien defendidas, ya que carecen de elementos como defensores activos y herramientas de detección.

Esa doble lectura es la que marca el momento actual. Para los defensores, modelos así pueden ayudar a encontrar fallos antes de que los exploten terceros, revisar grandes bases de código y acelerar la corrección de vulnerabilidades. Para los atacantes, capacidades similares podrían reducir el nivel de experiencia necesario para encadenar exploits y probar vectores de ataque con más rapidez. La ventaja dependerá menos del modelo en abstracto y más de quién tenga acceso, bajo qué controles y con qué capacidad de respuesta por parte de fabricantes, mantenedores y equipos de seguridad.

La conclusión más razonable no es que Mythos pueda hacerlo todo, ni que los benchmarks resuelvan la discusión sobre la autonomía de la Inteligencia Artificial. Lo que muestran los datos de METR es que la unidad mínima de trabajo delegable está creciendo muy deprisa. Cuando un agente empieza a resolver de forma fiable tareas que ya se miden en horas humanas, el debate deja de girar solo alrededor de la productividad individual y entra de lleno en la organización del desarrollo, la seguridad del software y la gobernanza de los modelos de frontera.

Preguntas frecuentes

¿Qué es el “horizonte temporal” de METR?

Es una medida que estima la duración de las tareas, calculada en tiempo humano experto, que un agente de Inteligencia Artificial puede completar con una probabilidad concreta de éxito.

¿Claude Mythos Preview puede trabajar de forma autónoma durante 16 horas?

No exactamente. La cifra no mide el tiempo de ejecución del modelo, sino la dificultad de tareas que a un humano experto le llevarían ese tiempo aproximado.

¿Por qué METR dice que las mediciones por encima de 16 horas son poco fiables?

Porque su conjunto actual de tareas no tiene suficiente cobertura para medir con precisión horizontes más largos. El modelo llega al límite de la evaluación disponible.

¿Claude Mythos Preview está disponible para cualquier usuario?

No. Anthropic lo presenta como un modelo no publicado de acceso limitado, vinculado a Project Glasswing y a socios seleccionados para trabajos defensivos de ciberseguridad.